6 лучших Deepfake приложений и инструментов в 2021 году

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

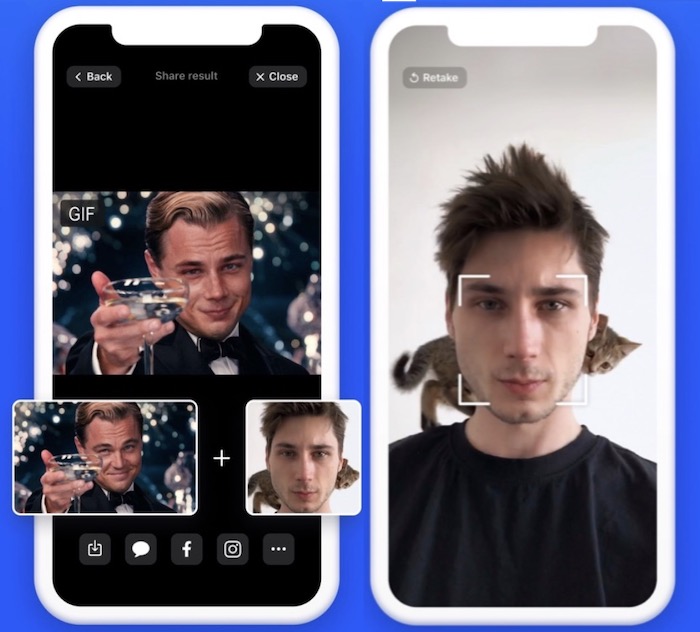

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

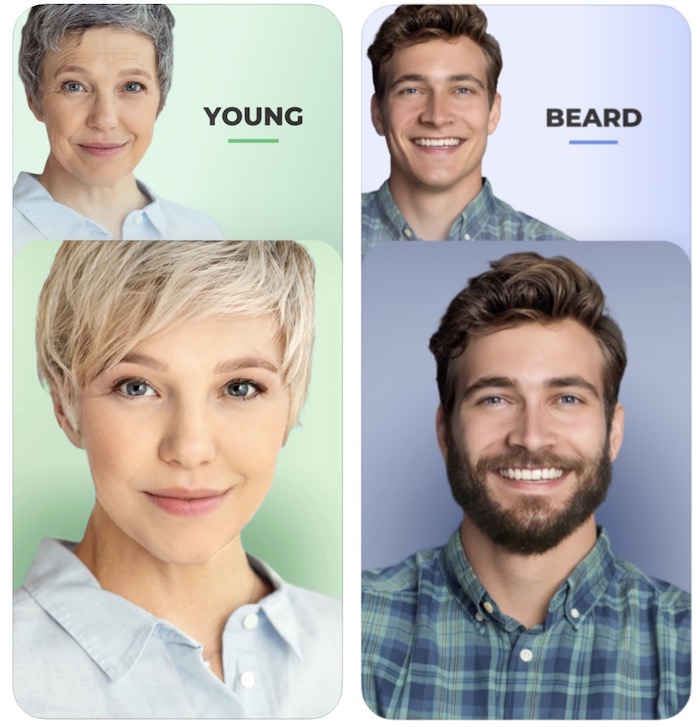

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

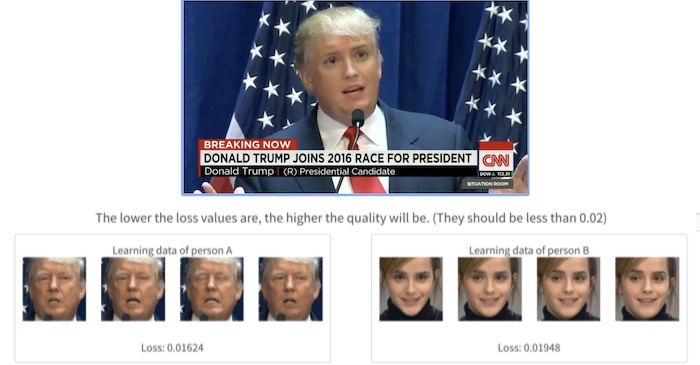

4. Deepfakes web β

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений «потерь»: чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем «workspace», которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

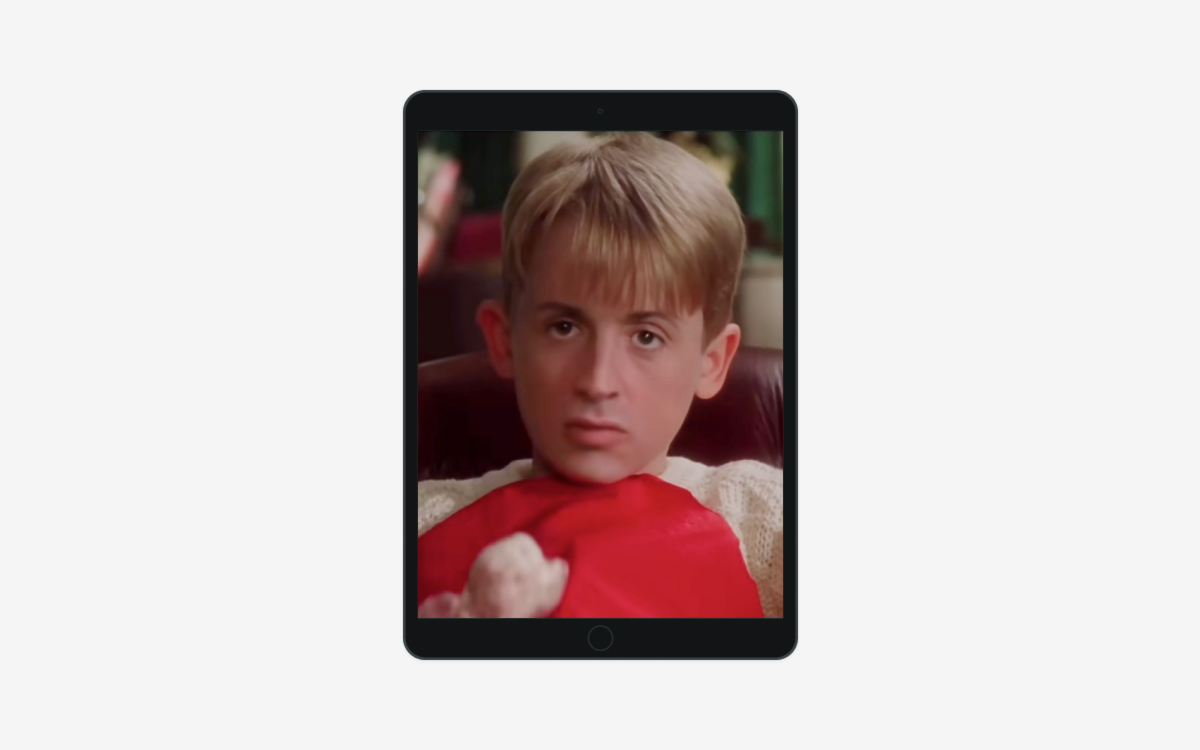

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Дипфейки и другие поддельные видео – как защитить себя?

Дипфейки: новые технологии обмана

Слово дипфейк (Deepfake) является составным и происходит от deep learning (глубинное обучение) и fake (фейк, подделка). Глубинное обучение – это сложный метод на базе искусственного интеллекта, который использует многоуровневые алгоритмы машинного обучения для извлечения все более сложных характеристик из необработанных входных данных. При этом ИИ способен обучаться на неструктурированных данных – таких как изображения лиц. Например, ИИ может собрать данные о движениях вашего тела.

Затем эти данные могут быть обработаны для создания дипфейк-видео при помощи так называемой генеративно-состязательной сети (Generative Adversarial Network, или GAN). Это еще одна специализированная система машинного обучения. В ней задействовано две нейросети, которые состязаются друг с другом, изучая характеристики учебных наборов данных (например, фотографий лиц) и создавая новые данные на базе этих характеристик (то есть новые «фотографии»).

Поскольку такая сеть постоянно сверяет создаваемые образцы с исходным учебным набором, поддельные изображения выглядят все более и более правдоподобно. Именно поэтому угроза, которую представляют дипфейки, постоянно растет. Кроме того, сети GAN могут создавать и другие поддельные данные помимо фотографий и видео. Например, дипфейк-технологии могут использоваться для имитации голоса.

Примеры дипфейков

Качественные дипфейки с участием знаменитостей найти несложно. Один из примеров – фейковое видео, выложенное актером Джорданом Пилом. Он записал небольшую речь голосом Барака Обамы, которая затем была совмещена с видеосъемкой реального выступления этого политика. Затем Пил продемонстрировал, как выглядят обе составляющие этого видео, и призвал своих зрителей критически относиться ко всему, что они видят.

Видео с руководителем Facebook Марком Цукербергом, в котором тот якобы говорит о том, как Facebook «управляет будущим» с помощью украденных данных пользователей, появилось в Instagram. На оригинальном видео запечатлена его речь в связи со скандалом о «русском следе» в выборах президента США – для создания фейка оказалось достаточно фрагмента длиной всего в 21 секунду. Однако голос Цукерберга был сымитирован не так хорошо, как в пародии Джордана Пила на Обаму, и фальшивку было легко распознать.

Впрочем, даже менее качественные подделки могут вызвать живой отклик. Видео с «пьяной» Нэнси Пелоси, спикером Палаты представителей США, набрало миллионы просмотров на YouTube – а это был всего лишь фейк, сделанный с помощью замедления реального видео, чтобы создать видимость невнятной речи. Кроме того, немало известных женщин внезапно обнаружили себя в роли порнозвезд – их лица были вмонтированы в порнографические ролики и изображения.

Мошенничество и шантаж с использованием дипфейков

Дипфейк-видео неоднократно использовались в политических целях, а также как способ мести. Однако сейчас к этим технологиям все чаще стали прибегать для шантажа и проворачивания крупных афер.

У генерального директора британской энергетической компании мошенники смогли выманить 220 000 евро с помощью дипфейковой имитации голоса руководителя головной компании, якобы запросившего срочно перевести указанную сумму. Подмена была настолько натуралистичной, что обманутый директор не стал перепроверять информацию, хотя средства переводились не в головной офис, а на сторонний счет. Только когда «босс» запросил еще один трансфер, его собеседник заподозрил неладное, но переведенные деньги уже бесследно исчезли.

Во Франции недавно прогремела афера, в которой, правда, технология дипфейков не использовалась, – мошенник по имени Жильбер Шикли выдавал себя за министра иностранных дел Франции Жана-Ива Ле Дриана, с большой точностью воссоздав не только его внешность, но и обстановку рабочего кабинета. Аферист от имени министра обращался к состоятельным частным лицам и руководителям компаний с просьбой выделить средства на выкуп французских граждан, оказавшихся в заложниках террористов в Сирии. Таким образом ему удалось выманить несколько миллионов евро. Сейчас это дело рассматривается в суде.

Авторы дипфейков могут шантажировать руководителей крупных компаний, угрожая опубликовать фейковое видео, способное подорвать их репутацию, если те не заплатят отступные. Также мошенники могут, например, проникнуть в вашу сеть, сымитировав звонок от IT-директора и обманом заставив сотрудников предоставить пароли и привилегии доступа, после чего ваши конфиденциальные данные окажутся в полном распоряжении хакеров.

Фейковые порноролики уже использовались с целью шантажа женщин-репортеров и журналисток, как, например, произошло в Индии с Раной Айюб, которая занималась разоблачением злоупотреблений властью. Технологии производства дипфейков дешевеют, так что можно прогнозировать рост их использования в целях шантажа и мошенничества.

h2>Как защититься от дипфейков?

Проблему дипфейков уже пытаются начать решать на законодательном уровне. Так, в штате Калифорния в прошлом году было принято два закона, ограничивающих использование дипфейков: законопроект AB-602 запретил использование технологий синтеза изображений человека для изготовления порнографического контента без согласия изображаемых, а AB-730 – подделку изображений кандидатов на государственные посты в течение 60 дней перед выборами.

Но окажутся ли эти меры достаточными? К счастью, компании в сфере безопасности постоянно разрабатывают все более совершенные алгоритмы распознавания. Они анализируют видеоизображения и замечают незначительные искажения, возникающие в процессе создания фальшивки. Например, современные генераторы дипфейков моделируют двумерное лицо, а затем искажают его для встраивания в трехмерную перспективу видеоролика. По тому, куда направлен нос, легко распознать подделку.

Пока что технологии создания дипфейков еще недостаточно совершенны, и признаки подделки зачастую видны невооруженным глазом. Обращайте внимание на следующие характерные признаки:

Однако по мере совершенствования технологий ваши глаза все реже будут распознавать обман – а вот хорошее защитное решение обмануть будет куда сложнее.

Уникальные антифейковые технологии

Некоторые развивающиеся технологии уже помогают создателям видеоконтента защищать его аутентичность. С помощью специального шифровального алгоритма в видеопоток с определенными интервалами встраиваются хеши; если видео будет изменено, хеши также изменятся. Создавать цифровые сигнатуры для видео также можно, используя ИИ и блокчейн. Это похоже на защиту документов водяными знаками; в случае с видео, правда, трудности заключаются в том, что хеши должны оставаться неизменными при сжатии видеопотока различными кодеками.

Еще один способ борьбы с дипфейками – использовать программу, вставляющую в видеоконтент специальные цифровые артефакты, маскирующие группы пикселей, по которым ориентируются программы для распознавания лиц. Этот прием замедляет работу дипфейк-алгоритмов, и в результате качество подделки будет более низким, что, в свою очередь, снизит вероятность успешного использования дипфейка.

Лучшая защита – соблюдение правил безопасности

Технологии – не единственный способ защититься от дипфейк-видео. В борьбе с ними весьма эффективны даже базовые правила безопасности.

Так, например, встраивание автоматических проверок во все процессы, связанные с перечислением денежных средств, позволило бы предотвратить множество мошеннических действий, в том числе и с использованием дипфейков. Также вы можете:

Помните, что, если хакеры начнут активно использовать дипфейки для проникновения в домашние и корпоративные сети, соблюдение базовых правил кибербезопасности станет важнейшим фактором в минимизации рисков:

Как будут развиваться дипфейки?

Дипфейки эволюционируют угрожающими темпами. Еще два года назад подделки легко было отличить по низкому качеству передачи движения; кроме того, люди в таких видео практически никогда не моргали. Однако технологии не стоят на месте, и дипфейки последнего поколения выполнены заметно более качественно.

По приблизительным оценкам, сейчас по Сети гуляет более 15 000 дипфейк-видео. Некоторые из них шуточные, но есть и такие, которые создавались для манипуляций общественным сознанием. Сейчас изготовление нового дипфейка занимает от силы пару дней, так что вскоре их может стать намного больше.

Дипфейки: как трансформируется авторское право на контент

Массовый дипфейк: тренд на синтетический контент

Технологии дипфейков развиваются быстрее, чем технологии их обнаружения и законодательная база для регулирования их создания. ИИ скоро достигнет точки, когда будет практически невозможно отличить аудио и видео людей, говорящих то, что они никогда не говорили.

Дипфейк (из двух английских слов «deep learning — глубокое обучение» и «fake — подделка») — это синтетический контент, в котором человек в существующем фото, аудио или видео заменяется на другого. Дипфейки могут использовать любой формат — ваше фото, видео или ваш голос. Дипфейки наиболее часто используют в рекламе, порнофильмах, порномести, фейковых новостях и для финансового мошенничества.

Технология дипфейков — это не абсолютное зло, она может революционно изменить, например, киноиндустрию. С помощью нее можно искусственно омолодить или состарить актеров, придать дублерам большее сходство с актерами, синхронизировать движения губ при дубляже перевода или даже доснять фильм с изображением внезапно умершего или переставшего участвовать в съемках актера. Как правило, применение таких технологий юридически невозможно без согласия актеров, чьи изображения будут использованы в конечном материале, либо их наследников, если человек уже умер.

«В мире уже много проектов коммерческого использования дипфейков (Synthesia, WPP, Rosebud, Rephrase.ai, Canny AI). Технология дипфейков открывает возможность создавать полностью синтетические личности — изображения и голоса людей, которых никогда не существовало. Использование таких изображений практически полностью снимает зависимость бизнеса от моделей и актеров, в том числе от необходимости «очистки» авторских и смежных прав и подписания различных релизов», — считает Вадим Перевалов, старший юрист международной юридической фирмы Baker McKenzie.

Аудиофейки: есть ли авторское право на голос?

Голосовые дипфейки представляют собой самую большую проблему, потому что на голос человека не распространяется право собственности ни в одной стране мира — если только имя человека не зарегистрировано как коммерческий бренд.

Однако в 2020 году был создан прецедент. YouTube-канал Vocal Synthesis делает юмористические дипфейки с использованием голосов политиков и знаменитостей. Команда канала в юмористической манере разместила несколько сгенерированных записей начитки текстов американской рэп-звезды Jay-Z без коммерческой выгоды, четко обозначив все видео как синтез речи.

Тем не менее, концертная компания RocNation, которая принадлежит Jay-Z, подала иск о нарушении авторских прав. Организация выдвинула требование удалить видео, где, по их мнению, незаконно использован ИИ для имитации голоса музыканта.

Только два из четырех видео Jay-Z были удалены — было признано, что полученный в результате звуковой продукт является производной работой, не имеющей ничего общего ни с одной из песен рэпера. В США не каждый случай коммерческого использования чужого голоса является нарушением закона.

«Перспективное направление дипфейков — использование изображений или голосов знаменитостей для производства контента без их участия. Например, в России использование чужой речи для создания «похожего» голоса в явном виде не запрещено законодательством. Имитация голоса, например, телефонными пранкерами, тоже не является нарушением и, скорее, зависит от содержания шутки, которая может попасть под уголовную ответственность. А использование технологий дипфейка в рекламе не должно вводить потребителей в заблуждение — например, о том, что известная личность якобы рекомендует какой-либо товар. Помимо этого, остается дискуссионным вопрос, не нарушит ли создание такого «голосового слепка» авторские и смежные права на фонограммы и актерское исполнение», — поделился мнением Вадим Перевалов.

В марте 2019 года в Великобритании произошел инцидент с аудиофейком — ПО на основе искусственного интеллекта было использовано, чтобы сымитировать голос исполнительного директора британской энергетической компании и дать сотруднику этого предприятия поручение о переводе третьим лицам €220 тыс. Работник подумал, что разговаривает по телефону со своим боссом, и отправил деньги мошенникам. Следователи так и не установили подозреваемых.

Защита авторского права исходников дипфейков

Основная проблема в отношении дипфейков — еще ни в одной стране мира не создано законодательной практики, которая могла бы повлиять как на создателей дипфейков, так и на процедуру по их удалению. Закон об авторском праве может действовать как эффективное средство регулирования дипфейков, но для этого его надо доработать. Вопрос защиты прав умерших (например, киноактеров) в отношении использования их голоса и образа остается также открытым.

Вероятно, в российском законодательстве дипфейки стоит рассматривать через призму производного произведения, при котором использование исходного произведения без согласия его правообладателя будет незаконно.

«Исключительное право на результат интеллектуальной деятельности возникает изначально у автора (соавторов), а потом может быть передано автором другому лицу по договору (ст. 1228 ГК РФ). Российское законодательство также предусматривает, что для возникновения, осуществления и защиты авторских прав не требуется регистрации или соблюдения каких-либо формальностей. Это главный подход для современной международной системы охраны авторских прав, предусматривающей также возможность подтверждения авторства с помощью презумпции авторства (статья 15 Бернской конвенции об охране литературных и художественных произведений), » — утверждает Дмитрий Игнатенко, руководитель юридической службы компании Rubytech.

Если рассматривать право авторства на дипфейк как результат интеллектуальной деятельности, созданной программой, то по российскому законодательству автором может быть только гражданин, творческим трудом которого создан этот результат (ст. 1228 ГК РФ). А правообладателем может быть лишь человек или юридическое лицо, обладающие исключительным правом на результат интеллектуальной деятельности или на средство индивидуализации (ст. 1229 ГК РФ). Так что за любой машиной должно стоять физическое или юридическое лицо, в противном случае не будет создан объект авторского права.

Технологии совершенствования дипфейков развиваются быстрее, чем законы в этой области. Американские Twitter, Facebook и китайский TikTok попытались самостоятельно отрегулировать распространение дипфейков разными способами

Twitter ввел правила по дипфейкам и манипулированию СМИ, которые в основном предусматривают пометку твитов и предупреждение пользователей об измененных новостях, а не их удаление. По заявлению компании, твиты, содержащие фальсифицированные или недостоверные материалы, будут удаляться только в том случае, если они могут причинить вред. В определение вреда также включены любые угрозы конфиденциальности или праву человека или группы лиц свободно выражать свое мнение. Это означает, что политика распространяется на преследование, навязчивое внимание, подавление или запугивание избирателей, а также на контент, содержащий фразы, предназначенные для того, чтобы заставить кого-то замолчать.

Facebook в начале 2020 года анонсировал политику для удаления дипфейков. Сообщения будут удалены, если они соответствуют таким критериям:

TikTok. Новая политика TikTok запрещает любой синтетический или манипулирующий контент, который вводит пользователей в заблуждение, искажая правду о событиях, и который влечет причинение вреда. Политика не столько запрещает конкретную технологию, основанную на ИИ, сколько призвана в большей степени предупредить использование любого вида обманного видео для очернения политических оппонентов в интернете.

Основной проблемой для соцсетей являлось отсутствие технологии обнаружения дипфейков. В 2019 году Facebook вместе с Microsoft и другими партнерами запустили конкурс для решения проблемы обнаружения The Deepfake Detection Challenge. Самой успешной стала модель белорусского разработчика Селима Сефербекова. Она достигла точности 65,18% на тестовых дата-сетах. На третьем месте — модель российской компании NTechLab.

Технологические лидеры — «Яндекс», TikTok, Microsoft, IBM, Kaspersky Lab, Reface, FaceApp, Ntechlab, и др. отказались комментировать РБК тренды дипфейков и авторского права.

Подписывайтесь также на Telegram-канал РБК Тренды и будьте в курсе актуальных тенденций и прогнозов о будущем технологий, эко-номики, образования и инноваций.