Ilo интерфейс что это

Всем привет сегодня хочу рассказать как настроить ILO порт на HP dl380 g7 через ESXI 5.5, напомню, что ILO можно настроить на этапе загрузки сервера через утилиту BIOS ILO.

Integrated Lights-Out — механизм управления серверами в условиях отсутствия физического доступа к ним. Применяется фирмой Hewlett Packard для всех своих серверов (кроме серверов 100 серии до марта 2009 года (до G6)

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-00

Логинимся на ваш ESXI 5.5 через SSH, и для начала сохраним конфиг ILO в файл. Делать мы это будем, через утилиту hponcfg. Если вы ранее устанавливали ваш ESXI из специально ISO образа компании HP, то утилита у вас уже стоит, если нет, то ее нужно hponcfg-04-00.10. Далее вы этот файл копируете на ESXI в папку tmp. После чего вводите команду.

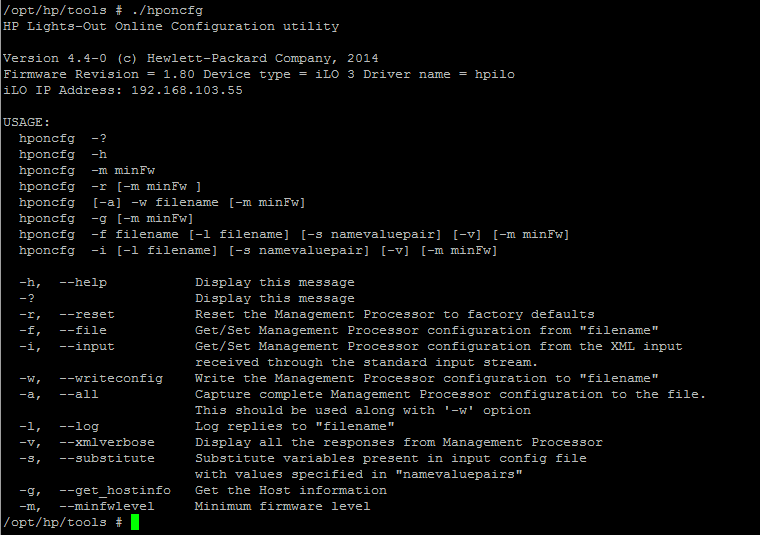

Посмотреть все параметры утилиты hponcfg можно командой

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-01

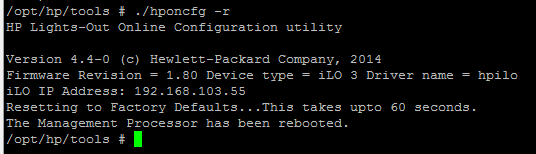

Сбросить настройки ILO порта можно командой

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-02

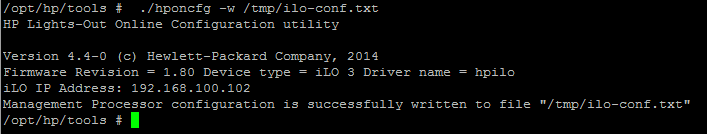

Теперь давайте экспортируем файл с настройками ILO, этот файл нам пригодится. Для этого переходим в каталог /opt/hp/tools с помощью /opt/hp/tool команды

Теперь выполним экспорт

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-03

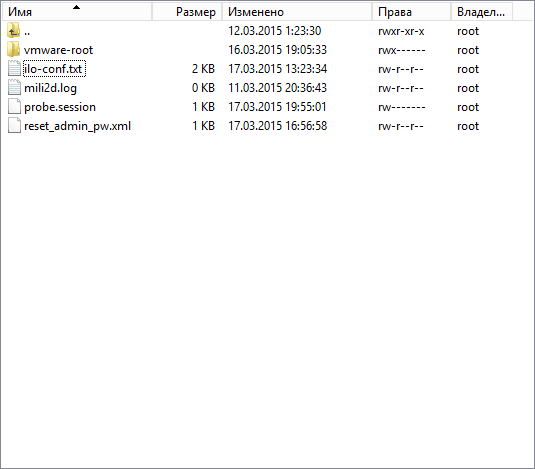

Теперь настроим статический ip адрес, шлюз и dns сервера.

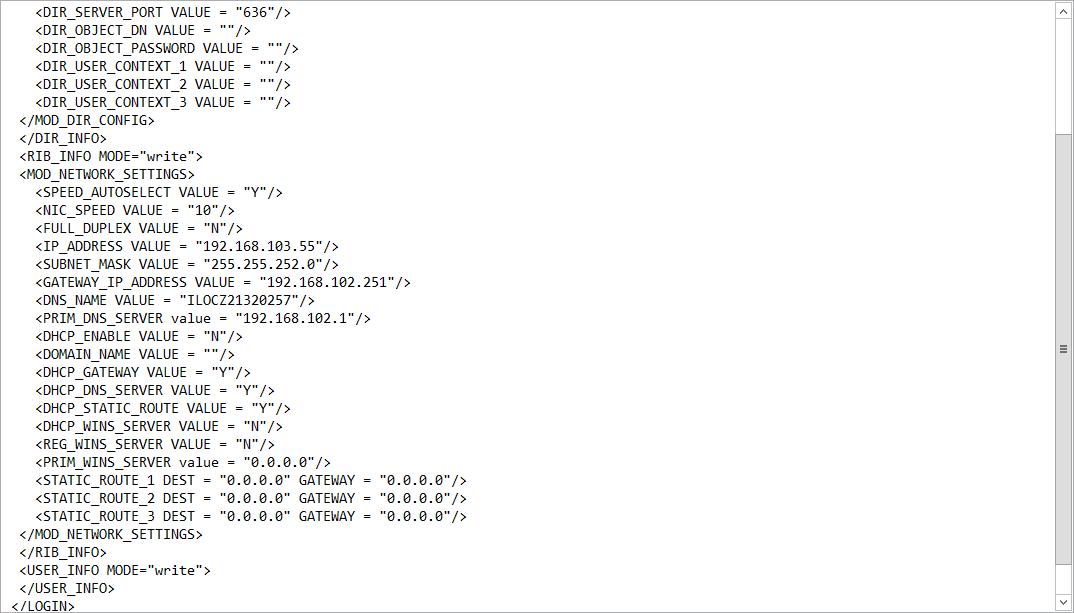

Заходим в папку tmp и открываем наш файл и заменяем данные строки на свои.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-04

DHCP_ENABLE VALUE отключает DHCP.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-05

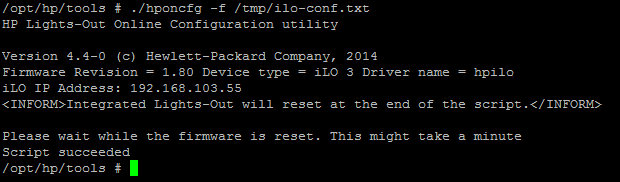

Сохраняем наш файл и давайте его применим с помощью команды

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-06

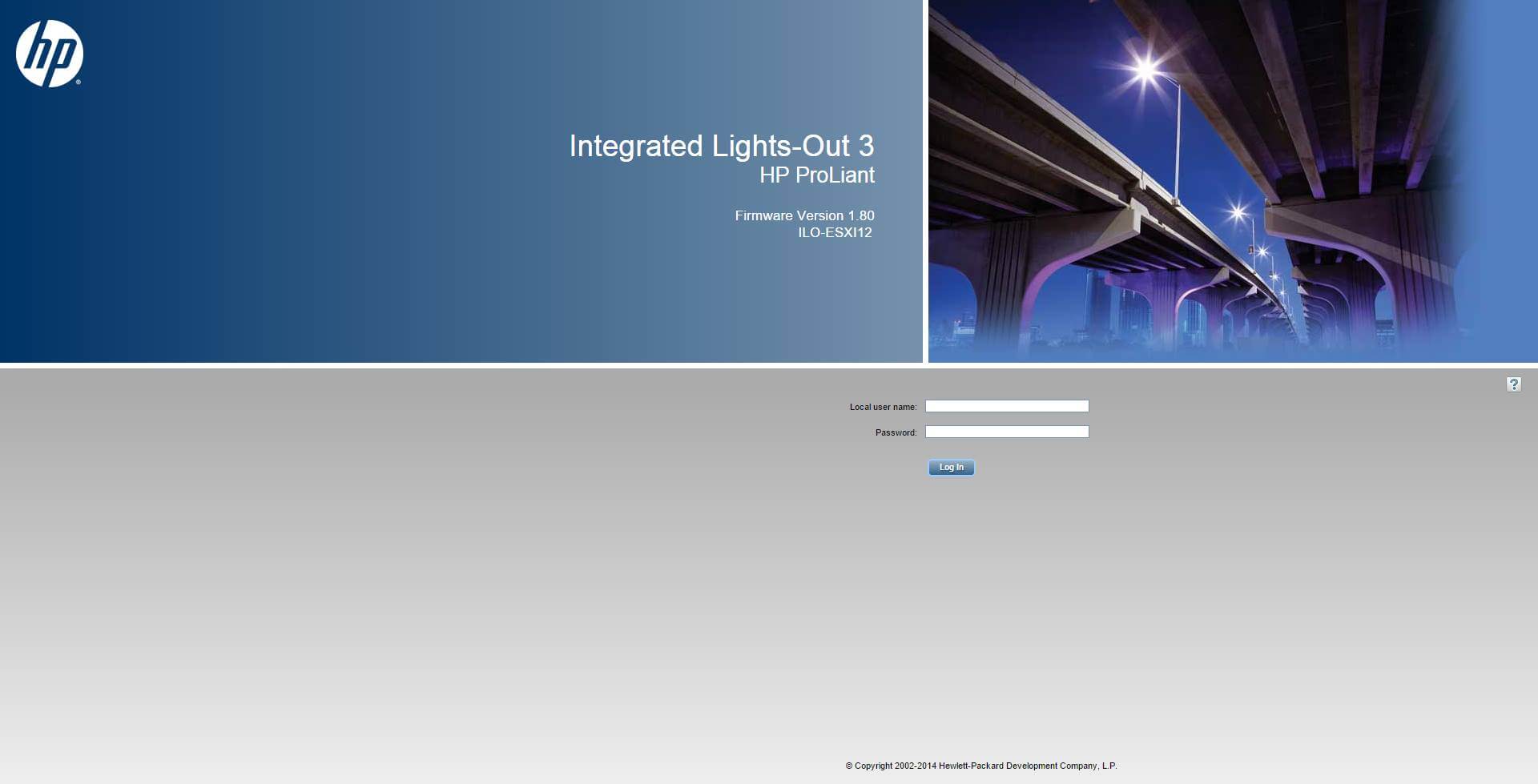

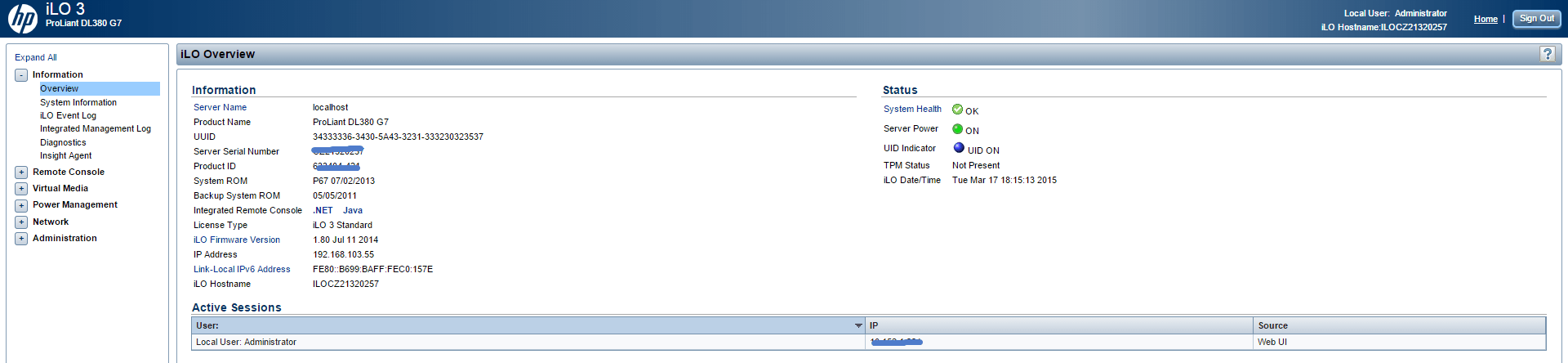

Все теперь можно отрывать браузер и вводить в него ваш ip адрес. https://192.168.103.55/ Вы должны увидеть форму для авторизации.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-07

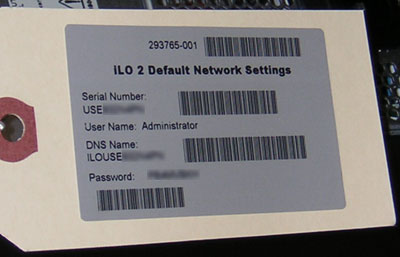

По умолчанию на вход в ILO логин Administrator а пароль написан на вкладыше в сервере, его можно найти на лицевой стороне, выглядит он приблизительно так.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-08

Если вы вдруг не нашли пароль, то его можно сбросить с помощью все той же программы ORCA при загрузке сервера, смотрите ссылку выше. Либо можно через сам ESXI с помощью все той же утилиты hponcfg

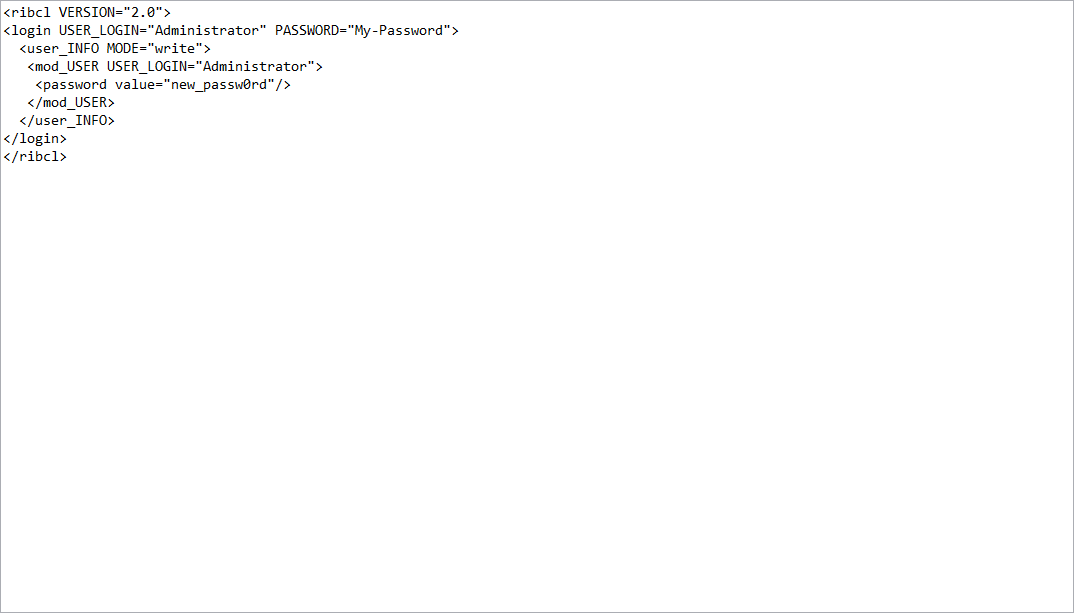

Для сброса пароля администратора создать xml файл(например reset_pw.xml) следующего содержания:

После выполнения пароль будет new_passw0rd.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-09

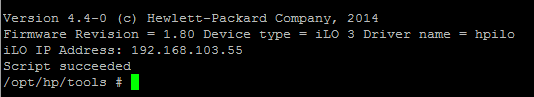

Вводим команду для сброса пароля.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-10

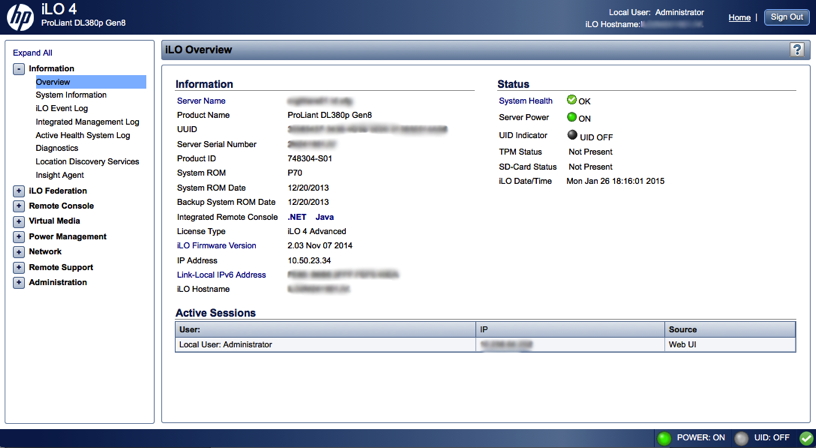

Все тепрь снова заходите в браузер и смело логиньтесь под новым паролем. И попадаем в веб интерфейс ILO.

Как настроить ILO порт на HP dl380 g7 через ESXI 5.5-11

Вот так вот просто настроить ILO порт на HP dl380 g7 через ESXI 5.5. Советую дальше почитать как настроить Active Directory аутентификацию ILO на HP dl380 g7.

Популярные Похожие записи:

One Response to Как настроить ILO порт на HP dl380 g7 через ESXI 5.5

Добрый день.

Сложилась как-то почти такая же проблема: (изначально порт iLO вообще не был подключен к сети), и образ ESXi был не фирменный (без утилиты hponcfg). Адреса раздает DHCP-сервер. Собственно, для обнаружения нужного адреса воспользовалась Advanced IP-Scaner (подсеть, которая раздается известна). Нужный адрес был найден, ну а дальше — вход через Веб-интерфейс.

Может, еще кому поможет)))

Управление серверами HP ProLiant через открытые REST API или «iLO на стероидах»

Вступление от HP: эта публикация написана одним из наших заказчиков, который по долгу службы пожелал остаться анонимным. Все совпадения имён и айпишников считать случайными. Попробовать сделать то же самое можно в любое время в нашем демо-центре в Москве — желающих просим писать в комментарии.

Приветствую. Меня зовут Эдуард, и я системный администратор в небольшой компании, которая аутсорсит администрирование ИТ-инфраструктуры. Кхм… Уже похоже на клуб анонимных кого-то с проблемами? Ну да ладно, одна интересная проблема у нас действительно была, а сегодня мы расскажем, как мы с ней столкнулись, и как случайно её решили.

Для начала немного предыстории. Все же помнят, как весело было админить удалённое железо раньше, лет 5-8 назад? Пишем заявку инженерам в ДЦ, ждём, когда они подключат KVM, настраиваем BIOS/CMOS, выставляем загрузку по сети, ставим систему (это хорошо, если кто-то добрый уже написал генератор preseed/kickstart-файлов, и в ДЦ есть DHCP/PXE сервер). А потом у нас на всех серверах появился ipmi (ну со временем). Ох, как мы радовались первое время!

И сервер уже вроде бы ставит ОС. Остаётся только наблюдать за этим в консоли, если скучно. Огорчало только то, что BIOS всё равно приходилось обновлять руками и настраивать (ну там HT/VT-d включить, хотя бы). В итоге все серверы были настроены по-разному, в зависимости от того, в каком квартале их ставили. Ну вы же понимаете, что серверы всегда ставил самый младший админ.

Когда мы находили что-то критичное – мы шли и руками переключали настройки. Бардак, да и только. Но вообще всё это нас устраивало до того, как с нами случилась история, о которой я сегодня и буду рассказывать.

Стоит упомянуть, что часть клиентов мы размещаем прямо на своём железе (точнее на виртуалках на этом железе, которое рулится через ). Ну чтобы вам было легче представить – наша система сильно похожа на OpenStack. И вот, в один прекрасный день, к нам пришел заказчик и попросил «на его железе сделать систему для управления виртуальными машинами в приватном облаке». Мы обрадовались, начали ему показывать своё решение (уже после подписания контракта и ТЗ), ему всё понравилось. Всё понравилось, менеджеры уже открывают шампанское (а надо сказать, что контракт по нашим меркам был очень неплохой). И тут клиент показывает пальцем в пункт ТЗ и спрашивает – «а с этим как?». Сидят админы и недоуменно смотрят в этот пункт – «новые серверы должны автоматически добавляться в облако после инвентаризации, установки в стойку и подключения сети-питания». Мы начали показывать – вот смотрите, мы записываем сервер сюда (1c), добавляем его mac-адрес вот сюда (самописная web-морда для управления dhcp-сервером и pxe), запускаем скрипт, сервер загружается по сети, система ставится (мы с облегчением выдохнули, поняв, что хотя бы система ставится сама), потом мы ловим сервер при перезагрузке, усиленно жмем клавишу Del… В общем, представитель клиента посмотрел на это, почесал затылок, походил по переговорке, собрался с мыслями и произнес: «Да где ж тут автоматически? Вот давайте выкинем всё, кроме 1С, всё равно туда бухгалтеры сервер вносить будут, а не я, и того места, куда вы mac-адрес записывали». Ну и вскоре после этого ушел, добавив, что надеется на то, что задачу мы всё же решим.

Потом мы, как обычно, ТЗ решили прочитать. Нашли там всякие интересные пункты, которые мы (ну те, кто делал задачу, а не те, кто ТЗ подписывал и пересказывал его нам) увидели впервые. Например, мониторинг температуры в обход ОС, мониторинг потребления электричества, автоматическая настройка BIOS… Начали размышлять. Сначала склонялись к мысли, что ipmitool всё это может. Потом представили, как всё это будет выглядеть. Подумали про то, как обновлять настройки, про мониторинг датчиков… В общем, разошлись на выходные с задачей «изучить весь гугл на предмет альтернатив ipmi, которые могут».

Приходим в понедельник, все грустные, злые. А один админ сидит и улыбается. Логичным было пристать к нему с расспросами на тему того, зачем он читает ithappens, когда у нас такая беда. Как оказалось, радовался он по поводу того, что читал не ithappens, а Redfish server management spec v 1.0 (читать здесь). Почитали все вместе вслух, злиться перестали. Redfish оказался именно тем, что нам нужно. Взяли менеджера, заставили его обзванивать всех производителей серверов, чтобы найти железку, в которой Redfish реализован. Приходят через час и смеется, показывает пальцем на коробку у входа и говорит «всё, я нашел». Собственно, коробка оказалась коробкой от HP Proliant Gen9. Сервер мы нашли, вернули в лабораторию (и кто вообще догадался новенький неизученный сервер сразу в ДЦ везти…) и приступили к знакомству с HP REST API (которая и является реализацией Redfish в серверах HP).

Так как мы админы (это потом уже нам дали питониста и он нам всё написал и сделал красивый web-интерфейс), то первым делом мы сели писать sh-ники, которые будут делать то, что нам нужно. Конечно, мы бы не советовали ходить в Rest API консольным curl-ом и генерировать JSON через echo (ну или хотя бы потом не показывайте никому это), но вот поделиться примерами взаимодействия с HP ProLiant REST API будем рады (тем более, что сами представители HP нас об этом и попросили).

Возможностей там полно на самом деле, в документации 2 сотни страниц списка объектов и краткого их описания. Мы первым делом пытались выполнить свои основные задачи, как proof-of-concept. Конечно, часть из них можно делать и через IPMI, но мы решили использовать один инструмент, именно API.

Первым делом (ну хорошо, вторым, после подключения сервера в стойке и после того, как HP iLO получит IP-адрес), прописываем все настройки BIOS:

Научимся управлять питанием. Ребут «по кнопке»:

«Выдёргиваем кабель из розетки»:

Отправляем инженера «нажать кнопку питания»:

Спросим у сервера, кто он такой:

PATCH-запросом в эту же ручку можно изменить информацию о сервере внутри iLo.

Спросим MAC-адреса у сервера (да, в итоге мы пошли дальше и DHCP-сервер сам проводил инвентаризацию новых серверов, если находил незнакомый iLO в отдельном VLAN-е – для iLO мы выдавали динамические адрес, а потом уже заводили записи о статических адресах для сетевых карт сервера и интерфейса iLo):

Из предыдущего JSON-а мы вытаскивали также и количество памяти с моделью CPU, потом разработчики сделали интеграцию с 1С, сервер отправлял данные о себе и туда. Здесь же мы определяли и версию BIOS, чтобы ругаться об устаревших (или просто отличающихся по кластеру) версиях.

Ещё через REST API можно снять показания метрик питания (к сожалению, не во всех «уровнях» лицензии iLO):

Ещё мы нашли какую-то жуткую ручку, которая описывает состояние сервера – обороты вентилятора, температуру, состояние разных железок внутри сервера.

А ещё нашли объект, который говорит о состоянии сервера в целом (ОК/fail) и чем он сейчас занимается (в нашем примере он загружался):

В общем, sh-ник мы в итоге написали и отдали его разработчику. Он над нами посмеялся, мы его за это поругали, пригрозили рута отобрать… Но зато он потом написал модуль в наше облачко, который умеет добавлять и управлять серверами через Redfish (и HP REST API, соответственно). Ну а заказ мы в итоге выполнили.

Наверное, пора закругляться. Расскажем про тех, кто играл главные роли во всей это истории.

Инструмент удаленного управления HP iLO

При помощи iLO сокращается время необходимое на решение возникших проблем, благодаря функциям удаленного доступа и устранения неполадок. Внешнее управление в свою очередь позволяет выполнять обслуживание и поддержку серверного оборудования независимо от его расположения.

Обновление версий программного продукта HP iLO происходит каждые несколько лет, на сегодня актуальной в моделях серверного оборудования 10 поколения является версия iLO 5.

Серверы HP ProLiant G2, G3, G4, G6 в моделях серии 300 и ниже

Серверы HP ProLiant G5 и G6, в моделях серии 300 и выше

Серверы HP ProLiant G7

Серверы HP ProLiant Gen8 и Gen9

Серверы HP ProLiant Gen10

Стандартная лицензия Essentials бесплатна и является доступной по умолчанию, для начала работы не нужно производить установку или настройку чего-либо. Также доступно обновление до расширенной лицензии iLO Advanced, которая обладает расширенным функционалом.

Краткий список основных возможностей которые включает в себя iLO:

Быстрый старт

Пользовательский интерфейс является удобным и понятным, с навигационным древовидным меню, расположенным в левой части страницы.

В статье рассмотрены возможности iLO 4 c расширенной лицензией Advanced.

Меню состоит из таких разделов:

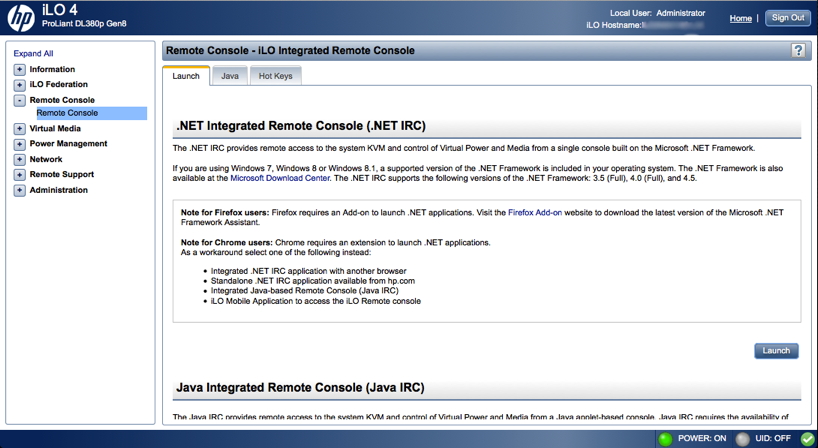

Удаленная консоль:

.NET предоставляет доступ к системной клавиатуре, видео и мыши (или KVM) и позволяет управлять виртуальной мощностью и виртуальными носителями с единой консоли через браузер на клиенте Windows. Поддерживается захват консоли, общую консоль, виртуальную папку и носители со сценариями (помимо стандартных функций).

Java также предоставляет доступ к системному KVM, позволяющему управлять Virtual Power и Virtual Media из консоли на основе Java, и включает в себя инструмент для создания образа диска iLO и Scripted Media.

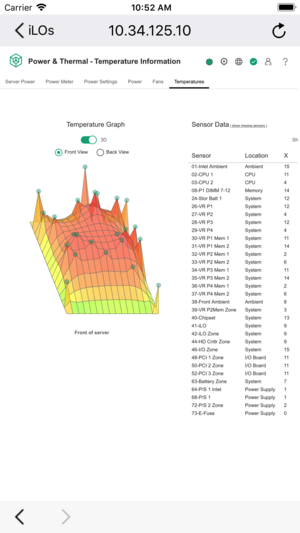

Для смартфонов с iOS и Android доступно мобильное приложение iLO. Оно обеспечивает доступ к удаленной консоли с вашего смартфона или планшета, что делает контроль и отслеживание параметров сервера ещё более мобильным и доступным.

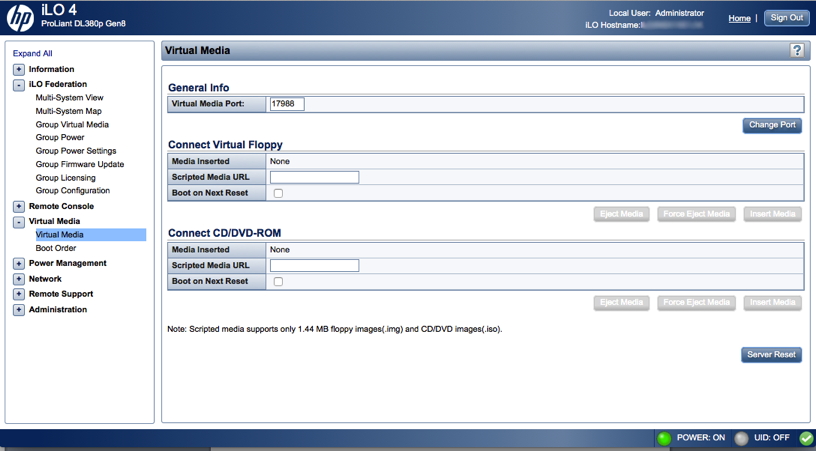

Virtual media:

С возможностью удаленной консоли тесно связано управление виртуальными носителями для монтирования образов дисков. Хотя функция Virtual Media поддерживает ISO-образы объемом до 8 ТБ, максимальный размер файла также зависит от других элементов, включая ограничение единого размера файла для файловой системы, в которой хранится ISO-образ, и команд SCSI, поддерживаемых ОС сервера.

При первом использовании iLO операционная система может предложить пользователю выполнить мастер установки нового оборудования.

Также в этом разделе можно настроить порядок загрузки системы.

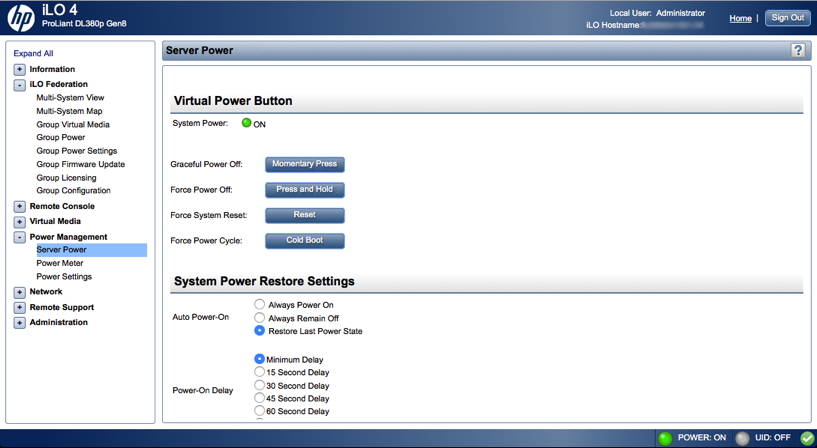

Управление питанием:

Возможность прямого управления питанием системы может иметь решающее значение для восстановления системы, в которой произошел сбой ОС, или для восстановления после определенных проблем с оборудованием.

Расширенные настройки

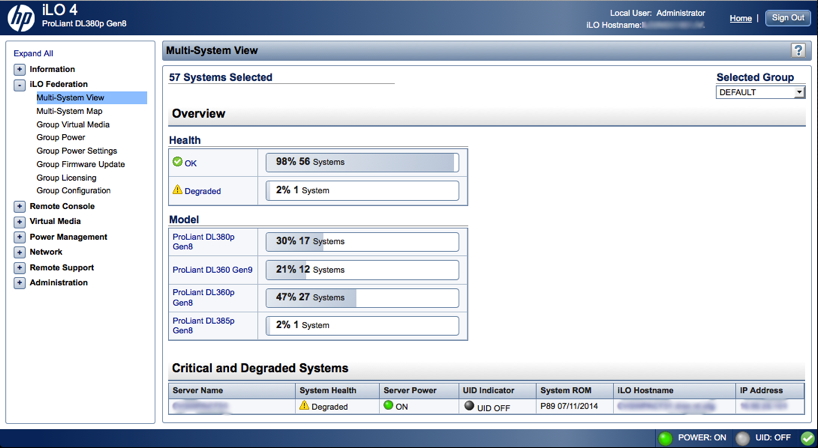

iLOFederation

Технология iLO Federation позволяет обнаружить другие серверы HP, и осуществлять мониторинг и управление ими. iLO Federation обладает отличными возможностями масштабируемости. Возможно объединение как нескольких устройств, так и большого ЦОД. Система по умолчанию будет находить другие устройства в общей сети (в зависимости от конфигурации сети.)

Это позволяет получить групповой обзор систем и их состояния. На приведенном ниже рисунке показан пример группы обнаруженных серверов и указано, что в одном из них в настоящее время найдены проблемы в работе. Также есть возможность напрямую перейти в панель iLO, той системы, в которой произошел сбой.

Вот список функций в iLO Federation. Для некоторых из этих функций требуется расширенная лицензия Advanced.

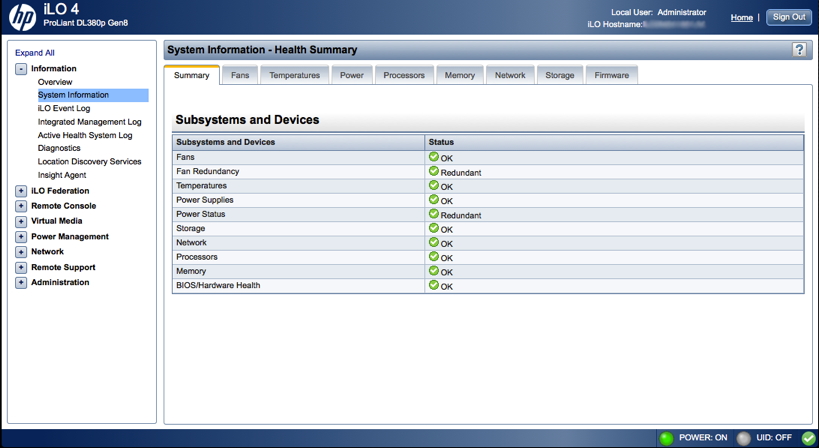

Мониторинг состояния системы

Информация о компонентах сервера и их работоспособности, нуждается в детальном отслеживании и контроле. Подменю «System information» отображает данные о том, какие аппаратные устройства установлены в системе, отслеживает их статус и работоспобность.

На вкладке «Summary» отображается состояние отслеживаемых подсистем и устройств, которые ипользуются в сервере.

Если сервер выключен, будет отображаться информация о состоянии системы, актуальная на момент последнего отключения питания. Кроме того, информация о работоспособности обновляется только после включения сервера и завершения процедуры POST.

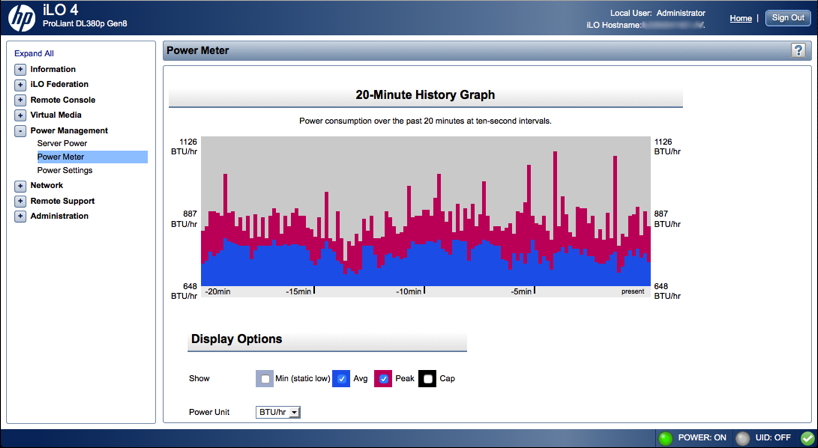

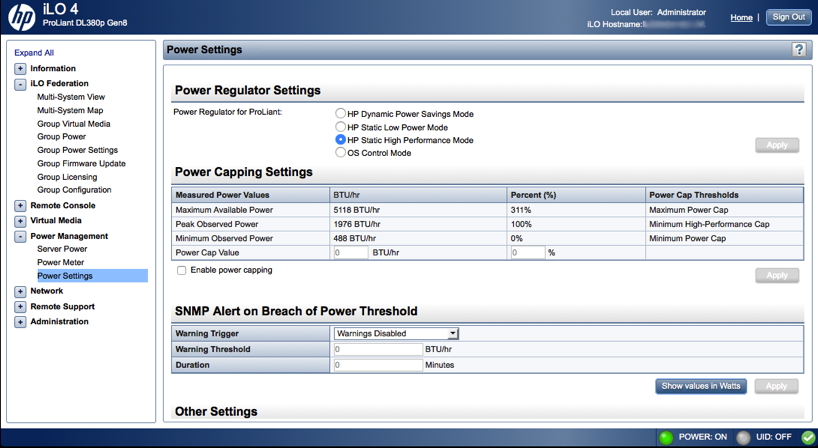

Управление энергопотреблением:

При помощи различных настроек в этом меню можно управлять настройками питания. Также здесь отображается энергопотребление в текущее время и за различные временные промежутки в виде графика. В меню «Управление питанием» есть три доступных параметра: «Питание сервера», «Power Meter» и «Настройка питания».

На странице «Питание сервера» раздел «Кнопка виртуального питания» показывает пользователям текущее состояние питания сервера, а также доступные параметры для удаленного управления питанием сервера.

На странице «Power Meter» отображается энергопотребление сервера за конкретное время. Графики, к которым пользователи могут получить доступ, включают 24-часовой график, который показывает энергопотребление сервера за предыдущие 24 часа и 20-минутный график, который показывает энергопотребление сервера за предыдущие 20 минут. Также доступна опция Power History, которая отображает показания мощности (средняя, максимальная и минимальная мощность) за три периода времени: 5 минут, 20 минут и 24 часа.

Управление питанием позволяет пользователям контролировать и просматривать функции управления питанием сервера, которые различаются в зависимости от конфигурации сервера.

Другие дополнительные функции

Интеграция каталогов/доменов позволяет использовать существующий каталог (например, Active Directory) для обработки аутентификации и авторизации для пользователей iLO. Данная функция позволяет централизованно управлять паролями, что делает управление многими системами с поддержкой iLO более масштабируемым. Осуществить это можно настроив конфигурацию Kerberos для автоматической аутентификации на основе того, что пользовательская система вошла в домен, не запрашивая снова доступ iLO.

Резюме

HP iLO является мощной технологией управления, а также центральным компонентом комплексного решения для мониторинга. Возможности управления намного превосходят возможности большинства решений KVM и тесно интегрируются с другими продуктами HP и инфраструктурой клиентов.

Технология iLO делает управление сервером очень простым, не только в масштабных системах. Даже небольшие организации могут воспользоваться преимуществами базовой лицензии Essentials, которая предлагает администраторам некоторые ключевые функции.

Хотя для покупателей небольшого количества серверов, функция удаленного управления не является решающей в выборе оборудования, возможно им стоит обратить большее внимание на этот аспект.

Bloggik.net

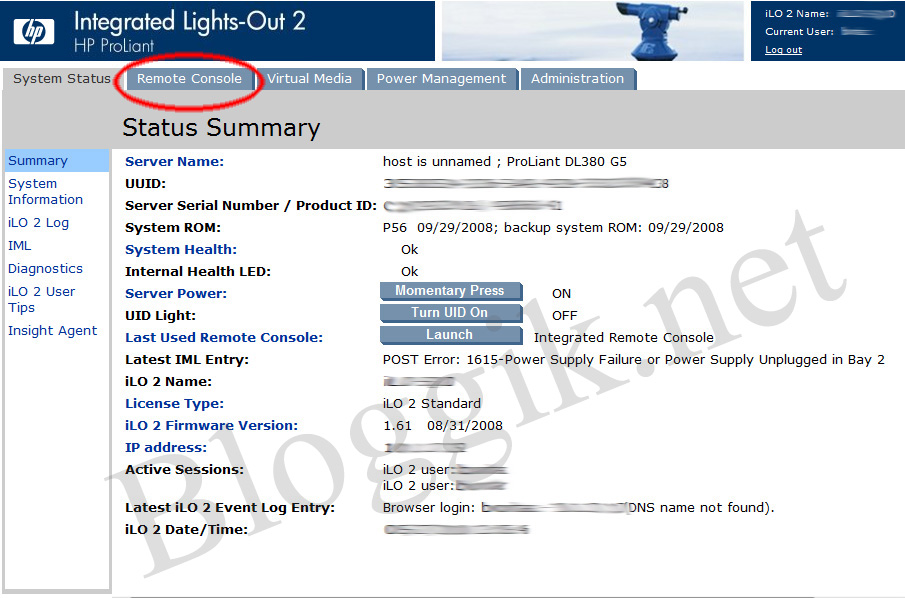

На всех современных серверах HP, например таких как HP ProLiant DL380 G5, используется технология iLO.

iLO (Integrated Lights-Out) — это механизм управления серверами в условиях отсутствия физического доступа к ним. Основными полезными для меня функциями iLO является: возможность удалённо по сети управлять питанием сервера (включать, выключать, перезагружать) и возможность подключиться к виртуальному последовательному порту (т.е. можно попасть в консоль установленной на сервер ОС, если последняя перестала быть доступной по сети). Можно ещё использовать iLO как IP KVM (т.е. по сети, в web браузере получить доступ к рабочему столу или консоли установленной на сервер системы), но для этого нужна дополнительная лицензия. Я же раскажу как настроить Linux (CentOS 5.4) для того, чтобы к нему можно было подключиться через виртуальный COM-порт. Для этого:

Чтобы найти устройства, доступные на компьютере, выполните:

должно появиться что-то типа:

Из выведенного можно определить, что имеется один последовательный интерфейс (/dev/ttyS0). Возможно на вашем компьютере будет более одного интерфейса. Здесь будем считать, что мы используем первое устройство (ttyS0). Если вы используете второе устройство, вам нужно заменить ttyS0 на ttyS1.

Открываем в редакторе файл /etc/iniitab и добавляем туда строчку:

Если хотим логиниться сразу с рутовым паролем, то необходимо добавить в файл /etc/securetty строчку:

Теперь необходимо чтобы процесс init перечитал свой конфиг, для этого выполните:

На этом этапе Linux готов принять подключение по COM-порту.

Теперь открываем браузер и заходим в iLO:

переходим на вкладку Remote Console:

и нажимаем на ссылку Remote Serial Console:

Мониторинг состояния серверов HP Proliant в nagios/icinga. Плагины check_hpasm и check_ilo2_health.pl

Плагинов для систем мониторинга существует огромное количество. Можно посмотреть и найти нужное в каталогах exchange.nagios и monitoringexchange. При поисках нужного плагина проверять лучше в обоих репозиториях — несмотря на кажущуюся идентичность, их содержимое различается.

Другое дело, что качество и функционал плагинов, даже сходных между собой, сильно разнятся — есть быстро слепленные на коленке хаки, работающие в строго определенных условиях и решающих узкую задачу. После написания автор плагина не стал выбрасывать его в /dev/null, а решил поведать о нём миру. Другие плагины представляют собой добротно сделанные продукты, работающие с целыми семействами устройств и предоставляющих обширную информацию о целевых системах.

Вот о последних и хотелось бы поговорить, тем более, что за время работы с nagios/icinga обнаружилось, что русскоязычной информации по плагинам для систем мониторинга крайне мало.

Данная статья посвящена мониторингу серверов HP Proliant, и автор искренне надеется, что она поможет в работе тем, кто имеет оборудование HP, и хотел бы более полно отслеживать его параметры.

Управление серверами HP Proliant в разных видах исполнения (iLO).

В настоящий момент существует iLO четырех версий. Просто iLO, иногда именуемое iLO1, ставившееся на сервера Proliant поколений G1-G4, iLO2 (G5-G6)и iLO3 ставившееся на G7. С поколения G8, которое теперь называется gen8, на сервера ставится iLO4. Если интересно, что делается внутри iLO4, то на хабре есть хорошая статья по этому поводу Проливая свет на HP ProLiant iLO Management Engine.

У всех iLO свой независимый сетевой интерфейс подключения. Он активен, даже если сервер находится в состоянии power down, главное, чтобы Proliant был физически включен в розетку. На iLO назначается свой адрес, сам интерфейс обычно включают в отдельный коммутатор управления с отдельным VLAN и своей подсетью.

На блейдовых вариантах серверов Proliant также установлены управляющие интерфейсы iLO; у каждого лезвия – свой собственный. Отдельный интерфейс управления (Onboard Administrator) есть и у блейдовой стойки c3000/c7000. Помимо информации о общем состоянии блоков питания, датчиков температуры в стойке, из интерфейса Onboard Administrator есть доступ к каждому iLO лезвия. На самих лезвиях ставились, минимум, iLO2 даже на поколениях G1. Последние поколения лезвий (gen8) также оснащены iLO4.

Версии Integrity iLO (Integrity iLO-iLO3) также ставятся на серверах Integrity и блейдах Superdome 2 — такие сервера встречаются не часто, так что рассматривать их не будем.

В некоторые системы, ныне уже устаревшие, но еще работающие (DL760 G2 — кто ж такого 8-процессорного коня выбросит?), которые изначально не были оснащены iLO можно установить карту RILOE II (полноразмерный PCI) с отдельным физическим LAN интерфейсом RJ45. RILOE II – (Remote Insight Lights-Out Edition II) достаточно забавная штука – у неё есть KVM-интерфейс (keyboard/vga/mouse) – для управления со стойки, RJ45 для подключения к сети и удаленного управления, а также… адаптер для внешнего питания.

Существует также усеченная версия iLO — LO100i, она ставилась на поколения G6 и G7 некоторых моделей начального уровня, например DL160,DL180,DL320, а также недорогих серий ML. В поколениях gen8 серверов даже начальной линейки, LO100i уже не будет (по крайней мере так было сказано на конференции HP). LO100i работает по одному из двух сетевых интерфейсов Proliant, причем может делать это как в выделенном (dedicated) так и в разделяемом (shared) режиме. В выделенном режиме один из сетевых интерфейсов сервера полностью занят под LO100i, в разделяемом – общая полоса делится между данными и управлением. Управление занимает небольшую полосу и практически не влияет на данные. У LO100i также есть свой отдельный сетевой адрес, который независим от основного адреса сервера. В некоторых моделях начального уровня (например ML110/ML150 G2), управляющий интерфейс отсутствует, но при необходимости, его можно организовать посредством установки специальной карты управления RMP (Remote Management Processor). Карта не слотовая – крепится на разъемы материнской платы (piggyback), и поставить ее на другие модели Proliant нельзя.

В реальной жизни с LO100i, при работе в разделяемом режиме, не всё хорошо складывается (в выделенном режиме всё хорошо). LO100i прекрасно работает, если два сетевых интерфейса Proliant у нас либо работают независимо, либо сконфигурированы в Network Fault Tolerance (NFT) или Transmit Load Balancing (TLB) with hot spare. При попытке объединения линков в LACP (а это самый эффективный режим использования нескольких сетевых интерфейсов), LO100i становится недоступен, хотя сами данные по интерфейсам ходят на ура. Причем, недоступен ни с внешней сети – с рабочей станции находящейся в том же VLAN на том же коммутаторе, ни с системной консоли. Поскольку документация утверждает обратное, по данному поводу заведен кейс в HP, причем еще в конце ноября прошлого года. На настоящий момент проблема потихоньку доэскалировалась до L1 (разработчики), но каких-то определенных рекомендаций HP (или хотя бы информации о понимании причин) так и не выдал, хотя если судить по трекеру инженеры что-то делают. Проблема, конечно, есть, но на задачу мониторинга она влияет лишь косвенно, хотя и не даёт возможности оперативно управлять сервером.

На сайте exchange.nagios.org есть достаточно большое количество плагинов, которые работают непосредственно с ilo делая запросы через http посредством XML. Но они хорошо работают только с iLO2 и более новыми версиями. iLO1 через XML очень неразговорчив и сообщает мало полезной информации, а ведь сервера с iLO1 до сих пор живы и здоровы, и понимать, что происходит у них внутри — надо.

Плагин check_ilo2_health.pl

Для проверки iLO наиболее эффективным показался check_ilo2_health.pl. Качать здесь. На exchange.nagios.org лежит более старая версия, которая не понимает iLO4.

Инсталляция скрипта не требует большого труда. Скрипт копируется в каталог, где лежат прочие скрипты nagios/icinga, затем в конфигураторе прописывается команда проверки и назначается на хосты.

Для работы скрипта потребуется инсталляция пакетов Perl (ставятся через CPAN): Nagios::Plugin (обязательно прочитайте UPDATE в конце!), IO::Socket::SSL и XML::Simple.

Опции:

-e — плагин игнорирует сообщения “syntax error” в выводе XML. Может быть полезно для старых фирмварей.

-n — без индикаторов температуры

-d — температурные данные совместимы с PerfParse

-v — выводить полностью XML сообщение (для отладки)

-3 — поддержка iLO3 и iLO4

-a — проверка отказоустойчивости вентиляторов (если поддерживается оборудованием)

-b — проверка отсеков HDD (если поддерживается оборудованием)

-o — проверка отказоустойчивости блоков питания (если поддерживается оборудованием)

Помимо возвращаемой информации, скрипт нужен для проверки физической доступности iLO извне. Обычного ping тут может оказаться недостаточно.

HP Server Insight Manager

Было бы ошибкой думать, что компания HP ничего не может предложить администратору. HP Server Insight Manager (HP SIM) – решение, ориентированное на управление и мониторинг платформы Proliant и что важно – для продуктов HP его использование бесплатно (качаем здесь). Поддержка – за деньги. Дополнения для мониторинга некоторых сторонних систем тоже платные. Для его полноценной работы на управляемых серверах необходима установка драйверов.

Возникает хороший вопрос: Можно ли добавить информационность HP SIM к возможностям icinga/nagios для сбора информации в одном приложении мониторинга? И ведь что удивительно: нашелся человек, который сумел решить эту задачу.

Плагин check_hpasm

Плагин check_hpasm создан в компании ConSol labs. Его автор Герхард Лауссер (Gerhard Lausser). Плагин предназначен для сбора информации со следующих систем Proliant:

• Linux, где установлен HP System Health Application and Insight Management Agent (HPASM)

• Windows 2003/2008/2008 R2/2012 – с установленными драйверами HP SIM.

• Блейдовые стойки HP (c7000/c3000) с Onboard Administrator.

Во всех трех случаях должен быть поднят и настроен SNMP.

На чём это проверялось. Система мониторинга Icinga 1.8.4 (полностью совместима с Nagios) установлена на FreeBSD 9.0, так что если у вас другая система мониторинга или ОС делайте поправку на зависимости и пути. В системе установлен Perl, со всеми необходимыми дополнениями.

Инсталляция check_hpasm.

Качаем свежую версию. Идём на страницу плагина и ищем check_hpasm, ссылку на него. Она находится внизу страницы. На момент написания статьи была доступна версия 4.6.3.

Ключи для configure:

(место, где лежат скрипты вида check_*. у меня оно притулилось по старинке на нагиосовское место, хотя есть и /usr/local/libexec/icinga)

(имя пользователя под которым запускается система мониторинга, для nagios будет nagios)

(имя группы, в которую входит пользователь, из под которого запускается система мониторинга, для icinga=icinga для nagios=nagios)

(выводить или нет информацию для сбора статистики – ДА, по умолчанию = нет)

(выводить или нет расширенную информацию – ДА, по умолчанию = нет)

Итоговая строка для конфигурации будет иметь вид:

смотрим на вывод configure, убеждаемся, что нас всё устраивает.

Потом делаем make install

Проверить работоспособность плагина можно запустив в командной строке:

После чего скрипт выдаст подробную информацию о состоянии удалённой системы. Например, запрос для блейдовой стойки c7000 в nagios/icinga будет выглядеть так:

Если обнаружится неисправный компонент, то плагин вернёт WARNING и укажет причину. Например,

так выглядит сообщение о проблемной батарее в акселераторе:

Кстати, через имеющийся на сервере ILO1 эту информацию другими плагинами собрать нельзя. Чем чревата мёртвая батарея акселератора дискового контроллера? Скорость на запись падает почти в два раза.

Получить еще более детальную информацию можно, добавив в командную строку ключ –vv, а если надо совсем длинную простынь для диагностики то используем –vvv

Прописываем в командах проверки nagios:

Вместо public должно стоять ваше SNMP комьюнити. Назначаем команду проверки хостам и сервисам.

Плагин опирается в своей работе на возвращаемые драйверами данные. Иногда (обычно это ошибки в фирмвари) они могут возвращать некорректные значения – наличие физически отсутствующих компонентов, неверные параметры температуры (99 градусов, как это было с iLO4 у gen8) и т.д. Для этого существует обширный набор ключей, которыми можно исключить некоторые датчики или подсистемы целиком. Описание ключей большое и полностью приведено на странице плагина в разделе Blacklisting.

Для работы под Windows 2003/2008/2012 на Proliant надо установить:

1. SNMP службу (по умолчанию не установлена, лежит в системных компонентах)и правильно её сконфигурировать (указать коммьюнити/ прописать адрес nagios/icinga-сервера в качестве SNMP-сервера / прописать адрес для отправки SNMP-трапов). WBEM провайдеры/SIM драйверы зависят от SNMP службы. WBEM — Web-based Enterprise Management.

2. Последние версию драйверов iLO, HP System Insight Manager и WBEM провайдеров под нужную версию системы.

Для Linux HPASM ставится аналогично – также требуется настройка SNMP и драйверов. Подробно описано в HOWTO

Инсталляция драйверов с SPP в разы удобнее, уже потому что можно делать массовую установку на несколько серверов сразу. Этим занимается HP SUM — Smart Update Manager. Для этого потребуются реквизиты администратора домена или локального администратора сервера. Кроме того перед установкой драйверов категорически рекомендуется проапгрейдить все доступные фирмвари.

Замеченные проблемы:

1. На десяток-другой серверов может ставиться оооооочень долго, почему – не ясно.

2. HP SUM не рекомендуется запускать на машине с продуктивным ПО, потому что он имеет свойство грузить процессор до 90%

3. Некоторые сервера не поддаются автоматической установке, особенно если система голая — WBEM/SIM драйвера ранее не стояли. Придётся ставить руками.

4. Иногда на целевых серверах HP SUM не даёт выбирать WBEM/SIM драйверы – их тоже придётся ставить руками, особенно это касается серверов с LO100i. Замечено на DL180G6 и DL160G6.

5. Драйвера WBEM/SIM не ставятся, если стоит Windows 2008 R2 на официально неподдерживаемой архитектуре (типа устаревших DL360G4 или DL380G4). В блоге http://kf.livejournal.com есть следующее решение:.

Замеченные ошибки и недостатки check_hpasm

На момент версии 4.6.3 замечена следующая ошибка: При запуске на FreeBSD плагин выводит сообщение:

На работу собственно плагина и выдаваемую им информацию влияния не замечено. В новых версиях исправлена.

Было высказано предположение об отсутствии утилиты lc, но инсталляция утилиты ничего не дала. Ошибка осталась. Автору плагина сообщено.

К недостаткам следует отнести вывод в юниксовом формате (от начала эпохи) даты строк из IML, что делает их плохо воспринимаемыми:

Можно пересчитать на онлайновом калькуляторе. Например, здесь.

О замеченных ошибках можно отписать автору плагина (plain english). Г.Лауссер человек занятой, но на сообщениях о проблемах или неправильном поведении check_hpasm всегда старается ответить.

Польза от плагина

C помощью данного плагина были оперативно обнаружены

• Неисправные батареи на акселераторах дисковых контроллеров в DL360G4, что приводило к падению скорости на запись на присоединенные массивы MSA20.

• Обнаружен заклинивший вентилятор в одном из Proliant. Вентилятор заменен.

• Обнаружен умерший резервный блок питания на одном из серверов. БП заменен.

Конечно, если каждый день дозором обходить все iLO-интерфейсы и внимательно просматривать логи IML, то подобные ошибки можно заметить, но возникает вопрос – а когда работать? Данный плагин в сочетании с nagios/icinga позволяет упростить процесс администрирования и полностью охватить инфраструктуру серверов HP Proliant.

Некоторые полезные руководства

P.S. Будут ли интересны статьи по другим аспектам мониторинга — конфигураторам, практическим наработкам, интересным плагинам, аддонам, нетривиальным железякам? Материалу накопилось много — хоть книжку пиши.

UPDATE 2015:

В 2015 году пришлось вернуться к задачам, связанным с мониторингом серверов HP и обнаружилось, что статья немного устарела.

в частности выяснилось, что при работе с iLO2 появляется ошибка:

ILO2_HEALTH UNKNOWN — ERROR: Failed to establish SSL connection with :443.

iLO3 и iLO4 отрабатывают нормально.

Изучение вопроса показало, что источником является широкоизвестная проблема с SSL. Наше окружение надо обновить.

1. Апгрейдим наш скрипт до версии минимум 1.60

(скрипт лежит на nagios.exchange. вот здесь )

2.Апгрейдим фирмвари у iLO2 до последней версии. (1.94 или 1.96, доступны с июля 2015)

Команду проверки надо изменить:

добавился ключик sslopts, с помощью которого включается TLSv1 и отключается проверка по SSL.

UPDATE 2016:

Касательно всех скриптов на перле использующих Nagios::Plugin (check_ilo2_health.pl,check_ilo2_health.pl):

Исключительно из-за копирайтов и торговых марок (а Nagios — зарегистрированная торговая марка) cpan более не индексирует Nagios::Plugin, соответственно нормально установить и использовать его больше нельзя.

Вместо этого используется Monitoring::Plugin, выполняющий идентичные функции, по тексту скриптов надо заменить Nagios на Monitoring

установить Monitoring::Plugin можно при помощи:

UPDATE 2020:

В iLO5 теперь есть свой собственный агент SNMP. Его надо правильно настроить и он будет давать возможность плагину check_hpasm собирать информацию.

Для серверов поколения Gen 10 и выше драйвера для OS устанавливать не требуется.