Современные типы видеопамяти

↑ следующая новость | предыдущая новость ↓

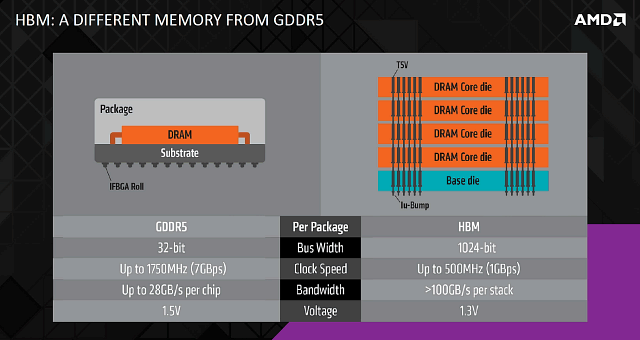

Видеокарты всегда оснащались самой продвинутой с технологической точки зрения, а потому и самой быстрой памятью. Начиная с 2009 года наиболее быстрой графической памятью была GDDR5, впервые появившаяся в видеокартах AMD Radeon HD 4800. Но время идет, и современным картам пропускной способности GDDR5 уже не хватает. В старших моделях видеокарт стала появляться видеопамять GDDR5X, HBM и HBM2. Сравним эти микросхемы памяти.

| Тип памяти | GDDR5 | GDDR5X | HBM | HBM2 |

| Производители | Samsung, Hynix, Micron | Micron | Hynix, Samsung | Samsung, Hynix |

| Формат чипа | Квадратный/прямоугольный чип | Квадратный/прямоугольный чип | Куб/прямоугольный параллелепипед | Куб/прямоугольный параллелепипед |

| Максимальный объем | 8 ГБ на чип | 16 ГБ на чип | 1 ГБ на стек | 4/8 ГБ на стек |

| Максимальная пропускная способность | 8 Гбит/с | 10-14 Гбит/с Планируется переход на 16 Гбит/с | 1 Гбит/с | 2 Гбит/с |

| Ширина шины | 32 бит на чип | 64 бит на чип | 1024 бит на стек | 1024 бит на стек или больше |

| Энергопотребление | Низкое | Ниже, чем у GDDR5 | Ниже, чем у GDDR5X | Ниже, чем у HBM |

| Применение | Большинство видеокарт от бюджетных до High-End, например, GT740, GTX 1060, RX480 | GeForce GTX 1080, Nvidia Titan X (Pascal) | Radeon R9 Fury X, Radeon Pro Duo | Nvidia Tesla P100, Nvidia Quadro GP100 |

GDDR5

GDDR5X

Так же GDDR5X потребляет меньше энергии по сравнению с GDDR5. Чипы памяти GDDR5X доступны в объемах 4 ГБ, 6 ГБ, 8 ГБ и 16 ГБ. Самые популярные графические карты, использующие память данного типа включают в себя GeForce GTX 1080 и Nvidia TITAN X (Pascal). Высокопроизводительные графические карты для рабочих станций, такие как Nvidia Quadro P5000 и Quadro P6000, также используют высокоскоростную память GDDR5X. Samsung планирует запустить память GDDR6 в 2018 году, которая станет настоящим преемником памяти GDDR5. Он будет иметь скорость до 16 Гбит/с и иметь еще более низкое энергопотребление.

Стоит отметить, что замена памяти с GDDR5 на GDDR5X невозможна, так как чипы имеют разное количество контактов (170 у GDDR5 и 190 у GDDR5X).

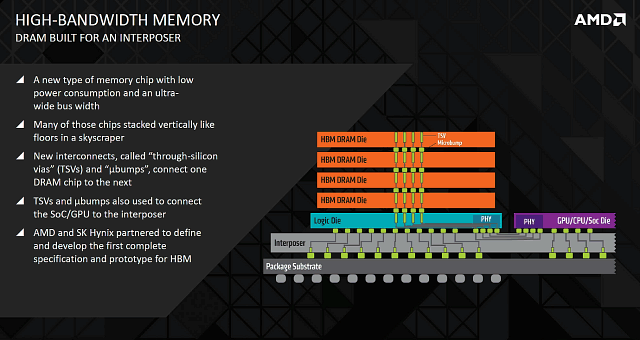

Каждая «стопка» (стек) памяти HBM не зависит от остальных, но они работают вместе. Из-за малого форм-фактора HBM также известна как компактная память или многоуровневая память. Обычный стек памяти HBM состоит из четырех слоев DRAM на базовой матрице и имеет два 128-битовых канала на каждый кристалл DRAM, что в сумме дает 8 каналов, что приводит к 1024 бит на стек стека интерфейса памяти. Таким образом, видеокарта, имеющая четыре стека 4-Hi HBM, имеет ширину шины памяти 4 x 1024 = 4096 бит. Рабочая скорость памяти HBM составляет 1 Гбит/с, но ее пропускная способность памяти намного выше по сравнению с памятью GDDR5. Это связано с гораздо более широкой шиной памяти. Ширина полосы пропускания памяти HBM может достигать 128 Гбайт/с на стек. HBM может иметь емкость 1 ГБ на каждый стек и поддерживает 4 ГБ на каждый пакет.

Память HBM потребляет меньше энергии по сравнению с памятью GDDR5 и GDDR5X. Первой видеокартой, использующей память HBM, стала AMD Radeon R9 Fury X. Она также используется в двух видеокартах с графическим процессором Radeon Pro Duo.

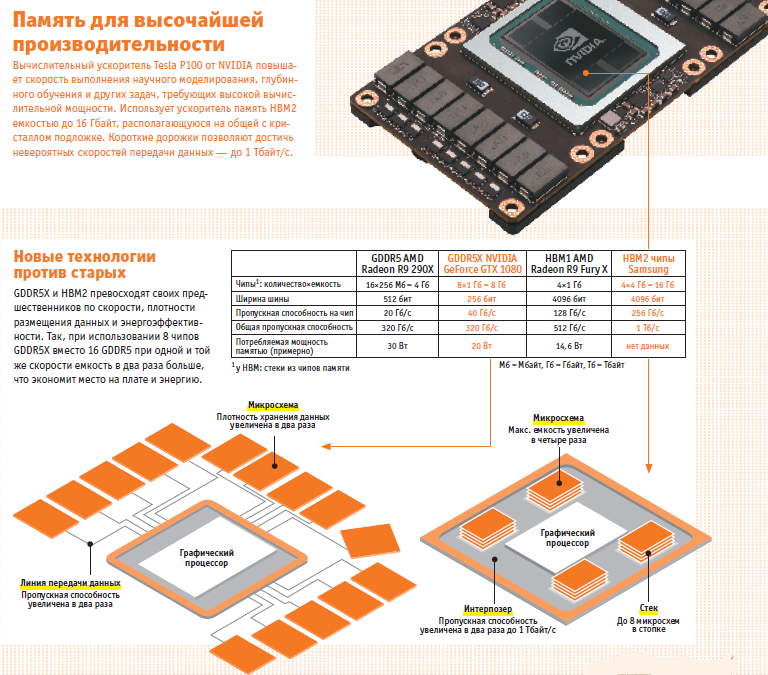

Сравниваем турбо-память для видеокарт: GDDR5X против HBM2

Графическим платам для высокопроизводительных ПК требуется большой объем высокоскоростной памяти. Самые подходящие решения — это новые технологии HBM2 и GDDR5X.

Виртуальная реальность требует графической производительности, в несколько раз превышающей таковую при использовании монитора. Количество ошибок программ по распознаванию речи методами глубинного обучения (deep learning) снижается на 40% при увеличении объемов анализируемых выборок в десять раз. И виртуальная реальность, и искусственный интеллект задействуют ресурсы графических процессоров, отлично подходящих для решения задач, хорошо поддающихся распараллеливанию, что, в свою очередь, требует памяти очень большой емкости и очень высокой скорости для обработки постоянно растущих объемов данных.

Компьютерные игры, которые становятся все более реалистичными, тоже жаждут быстрой видеопамяти. «Обычная» память типа DDR для ПК всегда была в лучшем случае слабым решением для требований видеокарт. Специально для использования в графических картах была разработана память GDDR (Graphics DDR), в настоящее время уже выросшая до пятого поколения. Однако из-за требований разрешения 4K, виртуальной реальности и ИИ даже она доходит до пределов своих возможностей. Новые технологии GDDR5X и HBM2 должны решить эту проблему.

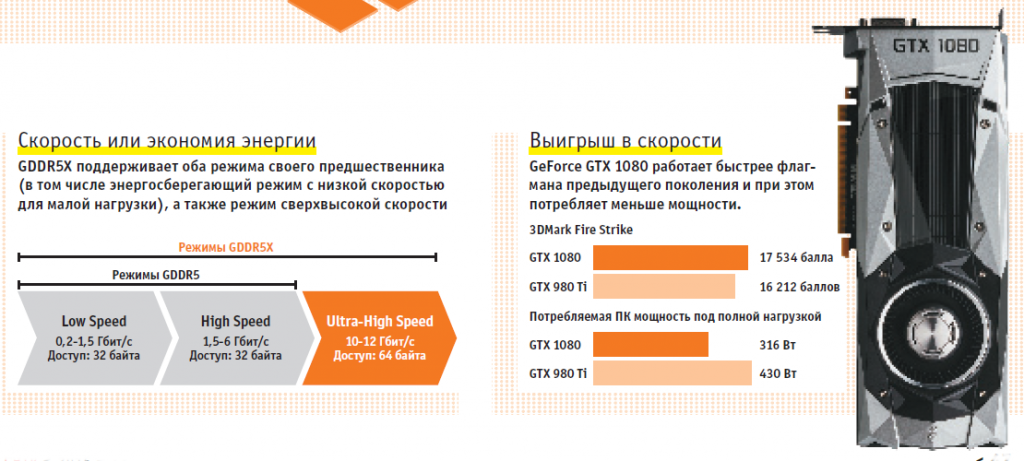

Эволюция: GDDR5X

Новая спецификация GDDR5X была утверждена в январе этого года, а нынешним летом в продажу поступила первая видеокарта NVIDIA GeForce GTX 1080, оснащенная такой памятью.

В GDDR5X традиционная структура памяти, представленная отдельными микросхемами, соединенными с ГП линиями передачи данных, адаптирована под новые требования. При этом основная структура карты изменилась мало. Обновился техпроцесс, и в итоге все это вместе держит в узде цены на память GDDR5X. По сравнению с предыдущей, вышедшей еще в 2008 году памятью GDDR5, новая технология обладает следующими преимуществами.

Предвыборка данных (prefetch) увеличилась с 8n до 16n. Теперь благодаря оптимизации внутренних линий передачи данных за один цикл доступа к памяти контроллер может выбирать не 32, а все 64 байта на чип, в результате чего пропускная способность памяти увеличивается вдвое без необходимости повышения тактовой частоты. Благодаря улучшенному техпроцессу повысилась энергоэффективность: рабочее напряжение с 1,5 В снизилось до 1,35 В, что, в свою очередь, уменьшает тепловыделение.

Емкость отдельно взятой микросхемы новой памяти составляет 4, 8 или 16 Гбит (у GDDR5, для сравнения, — от 512 Мбит до 8 Гбит). Вместе с тем, помимо степеней двойки, спецификация включает два новых промежуточных объема — 6 и 12 Гбит, что позволяет более гибко варьировать общий объем наборной памяти, прежде всего в мобильных устройствах.

Революция: HBM2

В то время как производители GDDR пошли по пути совершенствования памяти предыдущего поколения, разработчики появившейся в 2013 году технологии HBM (High Bandwidth Memory — память с высокой пропускной способностью) используют совсем другой подход. Эта память подразумевает объединение микросхем в стек. Стеки располагаются на промежуточном слое — интерпозере. Задача интерпозера заключается в соединении дорожек между памятью и видеочипом. Благодаря коротким дорожкам (чипы памяти расположены на подложке GPU) достигается невероятная скорость и энергоэффективность. Однако, поскольку плотность хранения отдельно взятого стека в первом поколении ограничена гигабайтом, а размер интерпозера – четырьмя стеками, в сумме на GPU приходится только четыре гигабайта, а этого для поддержки игры в 4K, виртуальной реальности или высокопроизводительных вычислений слишком мало.

HBM2 — память будущего

GDDR5X позволяет выпускать доступные карты с быстрой памятью большого объема

Вторая модификация HBM2, которая вышла в начале 2016 года, решает данную проблему. Возможным это становится благодаря повышению плотности размещения данных на микросхему, увеличению тактовой частоты с 500 МГц до 2 ГГц и использованию режима псевдоканалов, который разбивает один аппаратный канал памяти на два виртуальных, что, подобно гиперпоточности ЦП, приводит к более эффективному задействованию ресурсов. Samsung запустила серийное производство чипов с четырьмя стеками, а SK Hynix планирует начать его в этом квартале. Спецификация теперь позволяет использовать до восьми микросхем в стопке. Исходя из этого, оба производителя намерены еще в этом году увеличить емкость стека до восьми гигабайт.

Первые устройства, которые фактически используют память HBM2, — это ускорители NVIDIA Tesla P100 для серверов и рабочих станций. Пропускная способность видеокарт на архитектуре Pascal с 16 Гбайт памяти достигает 720 Гбайт/с — это в три раза больше, чем пропускная способность предыдущих топовых карточек поколения NVIDIA Maxwell. AMD же планирует выпустить первые видеокарты на HBM2 в розничную продажу в начале 2017 года.

И лавры достаются…

И лавры достаются…

… с технической точки зрения памяти HBM2. Размещение нескольких слоев в трехмерной конфигурации уже сейчас позволяет достичь большей по сравнению с GDDR5X производительности, а в перспективе — получить намного более широкие возможности. Но цена тому соответствует, отчего HBM2 останется прежде всего достоянием дорогих быстрых карт для серверов и игр.

GDDR5X — это вершина обычной двумерной технологии памяти. Зато видеокарты с такой технологией общедоступны. Так что память GDDR5X для современных графических плат среднего уровня достаточно быстра и энергоэффективна. Будем ждать появления недорогих видеокарт на ее основе, поддерживающих виртуальную реальность.

Чем отличаются поколения видеопамяти

Содержание

Содержание

Память, будь то оперативная память или видеопамять, является неотъемлемой частью современного компьютера. Сегодня вкратце узнаем, как все начиналось, как работает, почему диагностические программы показывают неверные частоты, в чем измеряется производительность памяти, как рассчитывается пропускная способность памяти и почему «МГц» для памяти — некорректное выражение.

До 2000-ых годов использовалась оперативная память стандарта SDR.

Потом ей на смену пришел новый стандарт памяти — DDR, который имел удвоенную пропускную способность памяти за счет передачи данных как по восходящим, так и по нисходящим фронтам тактового сигнала. Первоначально память такого типа, как и SDR, применялась в видеоплатах, но позднее появилась поддержка со стороны чипсетов.

DDR (Double Data Rate) расшифровывается как «удвоенная скорость передачи данных».

Таким образом, за один такт передается вдвое больше информации. Увеличилось количество передаваемой информации, реальная частота памяти осталась неизменной. Вместе с этим появилось такие понятия как эффективная частота, которая стала в два раза больше реальной.

Именно с приходом стандарта DDR появилась путаница с реальной и эффективной частотой работы памяти.

Реальная частота — частота шины модуля памяти. Эффективная частота — удвоенная частота шины модуля.

Как можно видеть, реальная частота памяти составляет 1900 МГц, в то время как эффективная в 2 раза больше — 3800 МГц, потому что за один такт теперь поступает вдвое больше данных.

Для того чтобы информация передавалась с удвоенной скоростью, она должна поступать из массива памяти вдвое быстрее. Реализовали это с помощью удвоения внутренней ширины модуля памяти. Благодаря чему за одну команду чтения мы стали получать сразу 2n единицы данных. Для стандарта DDR n = 1. Такая архитектура была названа n-prefetch (предвыборка). У памяти стандарта DDR, одной командой, при чтении, передается от ядра к буферу ввода-вывода две единицы данных.

Вместе с ростом производительности уменьшилось рабочее напряжение с 3.3V у SDR до 2.5V у DDR. Это позволило снизить энергопотребление и температуру, что дало возможность повысить рабочие частоты. На самом деле, потребление и, как следствие, нагрев, — это одна из самых больших проблем оперативной памяти того времени. При полном чтении всего модуля объемом 2 Гбайта память потребляет до 25 Ватт.

Оперативная память стандарта DDR2 пришла на смену стандарту DDR в 2003 году, правда, поддерживающие ее чипсеты появились годом позже. Основное отличие DDR2 от DDR заключается в увеличенной вдвое частоте работы внутренней шины, по которой данные поступают в буфер «ввод-вывод». Передача на внутреннюю шину теперь осуществляется по технологии (4n-Prefetch), одной командой из массива памяти к буферу поступает 4 единицы данных.

Таким способом удалось поднять пропускную способность в два раза, не увеличивая частоту работы чипов памяти. Это выгодно с точки зрения энергоэффективности, да и количество годных чипов, способных работать на меньшей частоте, всегда больше. Однако у данного способа увеличения производительности есть и минусы: при одинаковой частоте работы DDR2 и DDR временные задержки у DDR2 будут значительно выше, компенсировать которые можно только на более высоких частотах работы.

Рабочее напряжение понизилось почти на 30% до 1.8V.

На основе стандарта DDR для видеокарт в 2000 году был разработан новый стандарт памяти GDDR.

Технически GDDR и DDR похожи, только GDDR разработан для видеокарт и предназначен для передачи очень больших объемов данных.

GDDR (Graphics Double Data Rate) расшифровывается как двойная скорость передачи графических данных.

Несмотря на то, что они используются в разных устройствах, принципы работы и технологии для них очень похожи.

Главным отличием GDDR от DDR является более высокая пропускная способность, а также другие требования к рабочему напряжению.

Разработкой стандарта видеопамяти GDDR2 занималась компания NVIDIA. Впервые она была опробована на видеокарте GeForce FX 5800 Ultra.

GDDR2 это что-то среднее между DDR и DDR2. Память GDDR2 работает при напряжении 2.5V, как и DDR, однако обладает более высокими частотами, что вызывает достаточно сильный нагрев. Это и стало настоящей проблемой GDDR2. Долго данный стандарт на рынке не задержался.

Буквально чуть позже компания ATI представила GDDR3, в которой использовались все наработки DDR2. В GDDR3, как и DDR2, реализована технология 4n-Prefetch при операции записи данных. Память работала при напряжении 2V, что позволило решить проблему перегрева, и обладала примерно на 50% большей пропускной способностью, чем GDDR2. Несмотря на то, что разработкой стандарта занималась ATI, впервые его применила NVIDIA на обновленной видеокарте GeForce FX 5700 Ultra. Это дало возможность уменьшить общее энергопотребление видеокарты примерно на 15% по сравнению с GeForce FX 5700 Ultra с использованием памяти GDDR2.

Современные типы видеопамяти

На сегодняшний день наиболее распространенными типами видеопамяти являются GDDR5 и GDDR6, однако до сих пор в бюджетных решениях можно встретить память типа GDDR3-GDDR4 и даже DDR3.

GDDR3

GDDR4

Стандарт GDDR5 появился в 2008 году и пришел на смену стандарту GDDR4, который просуществовал совсем недолго, так и не получив широкое распространение вследствие не лучшего соотношения цена/производительность.

GDDR5 спроектирована с использованием наработок памяти DDR3, в ней используется 8-битовый Prefetch. Учитывая архитектурные особенности (используются две тактовые частоты CK и WCK), эффективная частота теперь в четыре раза выше реальной, а не в два, как было раньше. Таким способом удалось повысить эффективную частоту до 8 ГГц, а вместе с ней и пропускную способность в два раза. Рабочее напряжение составило 1.5V.

GDDR5X — улучшенная версия GDDR5, которая обеспечивает на 50% большую скорость передачи данных. Это было достигнуто за счет использования более высокой предварительной выборки. В отличие от GDDR5, GDDR5X использует архитектуру 16n Prefetch.

GDDR5X способна функционировать на эффективной частоте до 11 ГГц. Данная память использовалась только для топовых решений NVIDIA 10 серии GTX1080 и GTX1080Ti.

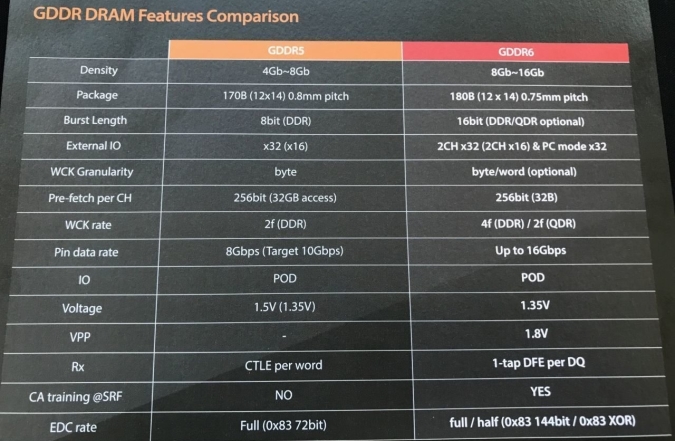

Память стандарт GDDR6 появился в 2018 году. GDDR6, как и GDDR5X, имеет архитектуру 16n Prefetch, но она разделена на два канала. Хотя это не улучшает скорость передачи данных по сравнению GDDR5X, оно позволяет обеспечить большую универсальность.

Сейчас данная память активно используется обоими производителями видеокарт в новой линейке NVIDIA серий GeForce 20 и 16 (кроме некоторых решений: GTX 1660 и GTX 1650, так как в них используется память GDDR5). При покупке нужно внимательно изучить характеристики видеокарты, потому как разница в производительности от типа памяти в данном случаи достигает от 5 до 15%. В то время как разница в цене совершенно несущественна.

GDDR5

GDDR6

Также тип памяти GDDR6 активно используется компанией AMD в видеокартах RX 5000 серии.

На начальном этапе GDDR6 способна функционировать с эффективной частотой 14 ГГц. Это позволяет удвоить пропускную способность относительно GDDR5. В дальнейшем эффективная частота будет увеличена, как это происходило с другими типами памяти.

GDDR6, GDDR5X и HBM2: сравниваем актуальную видеопамять

Быстрая графическая память большого объема является характерным признаком графической карты топового уровня. SK Hynix обещает закончить работу над GDDR6 до конца года, а AMD демонстрирует ускоритель с HBM2. Что же дадут новые стандарты видеопамяти?

Помимо быстрого графического процессора для игр также важен объем видеопамяти и то, насколько быстрой она является. Гигантские текстуры и информация для расчетов должны быстро поступать в распоряжение вычислительных элементов, иначе дело дойдет до «пробок» и снижения скорости смены кадров на экране монитора. Особенно высокие разрешения (более 1080р) с требовательным к вычислительным ресурсам сглаживанием быстро выбирают ресурсы памяти видеокарт среднего класса. В актуальных графических ускорителях, как правило, используются микросхемы стандарта GDDR5, более дорогие модели NVIDIA задействуют более быструю память GDDR5X.

Между тем в готовящихся к выходу на рынок ускорителях Vega от компании AMD будет использоваться высокоскоростная память второго поколения High-Bandwidth Memory (HBM2). Так каковы же главные особенности данных типов памяти?

Актуальная графическая память в сравнении

Скорость передачи данных

Плотность чипа памяти

Вышеприведенная таблица показывает основные характеристики четырех рассматриваемых нами типов памяти. Согласно спецификации, GDDR5X поддерживает пропускную способность на уровне до 12 Гбит/с и 512-битную ширину шины. В конечном продукте это может означать скорость передачи данных в 768 Гбит/с. Однако в графических картах такие показатели, о которых можно только мечтать, не достигаются.

Наибольшая пропускная способность GDDR5X у представленных на рынке моделей достигает 11 Гбит/с. Titan XP от компании NVIDIA хотя и предлагает 12 Гбайт видеопамяти, но использует «всего лишь» 384-разрядную вместо 512-разрядной шину памяти.

GDDR6 против HBM2

Данные о GDDR6, которые компания SK Hynix представила на GTC 2017, особенно интересно сравнить с информацией о другой новой графической памяти года — HBM2. В лучшем случае оба типа памяти обеспечивают примерно одинаковую пропускную способность. Различия заметны в объеме. AMD объявила о готовящейся к выходу на рынок в конце июня 2017 года карты «не для геймеров» с памятью объемом 16 Гбайт. Поскольку конфигурация микросхем GDDR6 должна остаться идентичной конфигурации GDDR5, преодолеть порог в 12 Гбайт на одной карте производители графических ускорителей, скорее всего, не смогут.

HBM2 некоторое время будет иметь ограничение на уровне 16 Гбайт, но у этого стандарта есть возможность поднять планку повыше — причем в прямом смысле этого слова, поскольку до сих пор 3D-память используется в версии только 4 Гбайт на стек («4-Hi Stack»), но располагает возможностью объема стека до 8 Гбайт. Таким образом, объем HBM2-видеопамяти на графических картах может достигать 32 Гбайт.

Когда GDDR6 дойдет до геймеров?

SK Hynix обещает завершить разработку нового типа видеопамяти в четвертом квартале 2017 года. Кроме того, на GTC вовсю циркулировала информация о том, что массовое производство может быть запущено в 2018 году. Официальных партнеров на данный момент пока еще нет. Однако именно компания NVIDIA является наиболее вероятным кандидатом на эту роль.

Появление графических карт с видеопамятью GDDR6 до 2019 года маловероятно. Напомним, что члены ассоциации JEDEC, к числу которых относятся такие производители памяти, как SK Hynix, Micron и Samsung, договорились о спецификациях GDDR5X в 2015 году. Первые графические карты с данным типом памяти вышли на рынок только в 2016-м.

Новый стандарт высокоскоростной памяти High Bandwidth Memory

Содержание

Введение

В скором времени в мире стандартов оперативной памяти грозят произойти несколько важных изменений, и первопроходцами должны стать производители графических процессоров, как самые заинтересованные в получении максимальной пропускной способности и энергоэффективности. У обоих основных производителей GPU есть планы по внедрению нового стандарта скоростной памяти High Bandwidth Memory (HBM), хотя существуют и другие варианты: Wide I/O (Samsung) и HMC, Hybrid Memory Cube (Intel и Micron).

Для чего вообще вдруг понадобились новые типы памяти, почему не обойтись использованием GDDR5 в видеокартах и DDR4 в других системах? Оба указанных типа памяти, универсальной и графической, являются всего лишь эволюционным развитием давно известных стандартов, и хотя они имеют улучшенные характеристики по производительности и энергопотреблению по сравнению с DDR3 и GDDR3/GDDR4, но улучшения эти не столь значительны, как многим хотелось бы.

Основам ныне применяемых стандартов DRAM уже не один десяток лет, и их улучшение позволило повысить пропускную способность далеко не настолько, насколько выросла производительность CPU и GPU за это время. Двадцать лет улучшения стандартов позволили поднять пропускную способность памяти (ПСП) всего лишь примерно в 50 раз, в то время как скорость вычислений за это время выросла много больше. Особенно это касается графических процессоров, скачок в производительности которых за это время произошел весьма существенный. И индустрии требуются новые типы памяти, которые дадут совершенно иные возможности, вроде Wide I/O, HMC и HBM.

Все эти стандарты основываются на так называемой stacked DRAM — размещении чипов памяти слоями, с одновременным доступом к разным микросхемам, что расширяет шину памяти, значительно повышая пропускную способность и немного снижая задержки. Описание разницы между указанными стандартами выходит за рамки данной статьи, но все указанные стандарты имеют множество схожих черт, хотя и с некоторыми особенностями.

Стандарт Hybrid Memory Cube, предлагаемый Intel и Micron, можно назвать наиболее универсальным, он должен позволить получить ПСП до 480 ГБ/с при несколько бо́льших энергопотреблении и себестоимости по сравнению с Wide I/O 2. Появление продукции с использованием HMC ожидается в следующем году. На данный момент стандарт HMC не является стандартом JEDEC, но в консорциум входят такие крупные компании, как Samsung, Micron, Microsoft, Altera, ARM, Intel, HP, Xilinx, SK Hynix и другие, так что поддержка со стороны индустрии у стандарта достаточная. Однако среди поддерживающих HMC нет (пока?) компаний AMD и Nvidia, выпускающих графические процессоры — они выбрали для себя конкурирующий (условно) стандарт компании Hynix — High Bandwidth Memory.

Стандарт HBM не настолько универсальный, как HMC, это специализированная версия Wide I/O 2, которая лучше всего подходит именно для графических процессоров, хотя может применяться и в будущих гибридных процессорах APU компании AMD, например. Хотя компании AMD и Nvidia уже анонсировали применение HBM в будущих поколениях GPU, Nvidia ожидает выхода своего Pascal с поддержкой этой памяти лишь в 2016-м, тогда как AMD планирует выпуск первого графического процессора, оснащенного HBM-памятью, уже в середине текущего года.

Что касается сравнения со стандартами Wide I/O и HMC, то HBM — это среднее решение по цене и производительности, специализированное для применения в связке с высокопроизводительными GPU, которое дороже в производстве, чем Wide I/O, но дешевле HMC. Кроме того, очень похоже, что HBM станет первой из перечисленных технологий stacked DRAM, которая появится на пользовательском рынке в виде графических решений. Применение же технологии Micron HMC пока что будет ограничено серверами и суперкомпьютерами, вроде семейства Knights Landing (Xeon Phi) Intel.

Новые стандарты полностью изменят рынок памяти, предлагая значительно бо́льшую ПСП и серьезное улучшение энергоэффективности. Кроме этого, немного снизятся и задержки доступа, что не так важно для применения в графических задачах, зато будет полезно в гибридных APU. Да и Intel вполне может начать применять stacked-память в своих будущих решениях, предназначенных для рынка настольных ПК, когда это станет экономически целесообразно. Такие типы памяти, как HMC и HBM, откроют гибридным процессорам совершенно новые возможности, и производительность встроенного графического ядра значительно вырастет.

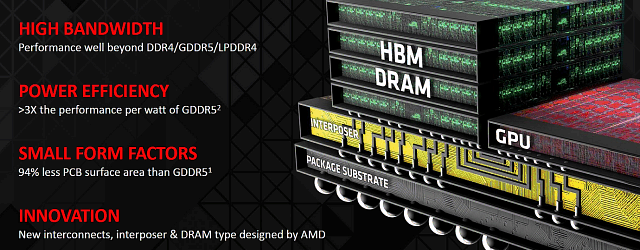

Еще в 2011 году компании AMD и Hynix анонсировали совместные планы по разработке и внедрению нового стандарта памяти — High Bandwidth Memory (HBM). Новый тип памяти должен был стать огромным шагом вперед по сравнению с применяющейся до сих пор GDDR-памятью, и среди главных преимуществ HBM значились серьезное увеличение пропускной способности и увеличение энергетической эффективности (снижение потребления вместе с ростом производительности).

Компания AMD, как и компания ATI в годы своей жизни, в последние несколько лет была лидером по освоению новых типов графической памяти. Хотя продукты с поддержкой GDDR2 и GDDR3 первыми выпустили не они, но именно эта компания первой оснастила свои решения видеопамятью последних двух существующих стандартов (GDDR4 и GDDR5). Соответственно, в 2011 году в партнерстве с Hynix они решили продолжить свои инициативы по приоритетной разработке и внедрению новых стандартов видеопамяти для будущих GPU. И вот, после четырех лет разработки подошло то самое время, когда эти компании наконец-то готовы предложить рынку графический процессор, оснащенный совершенно новым типом графической памяти.

В своем отчете с мероприятия AMD под названием 2015 Financial Analyst Day мы уже рассказывали читателям о том, что компания анонсировала первое в индустрии применение HBM-памяти в своем следующем графическом процессоре, который должен выйти еще в этом квартале (то есть до конца июня).

В то время AMD еще не была готова поведать технические подробности применения HBM-памяти, да и сейчас многие технические характеристики основанного на HBM графического чипа остаются неизвестными, но заинтересованным представителям технической IT-прессы уже рассказали определенные детали. Видимо, в AMD захотели превратить свое первое в индустрии применение HBM-памяти в отдельное событие, заранее раскрыв некоторые карты. Давайте посмотрим, что же мы узнали.

Проблемы существующих типов графической памяти

За четыре поколения GDDR-памяти ее разработчики продолжали увеличивать тактовые частоты, на которой она способна работать, для увеличения пропускной способности. В итоге родилась GDDR5-память с эффективной рабочей частотой более чем 7 ГГц. Но первый графический ускоритель, использующий память GDDR5 (ATI Radeon HD 4870, если кто забыл), был выпущен еще в июне аж 2008 года! С тех пор прошло уже почти семь лет — больше, чем продержались другие типы графической памяти.

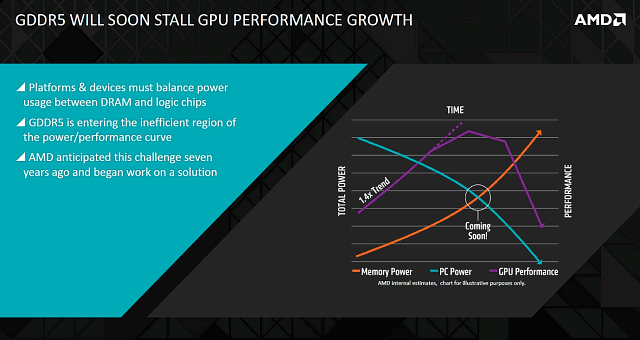

А расти то уже больше особо и некуда — из возможностей GDDR выжато почти все. В стандарте GDDR5 нынешний тип памяти достиг своего предела, и хотя небольшие возможности для роста ПСП еще есть, но они требуют слишком больших усилий и не изменят ситуацию кардинально. Но самое главное — вопрос высокого потребления не решился до сих пор. А ведь энергоэффективность — главный параметр для любого современного чипа. Даже текущие поколения GDDR5-памяти уже потребляют слишком много энергии из-за сложных механизмов тактования и работы на очень высокой частоте, а любые улучшения производительности GDDR5 связаны с дальнейшим повышением частоты и сложности чипов, а значит, и энергопотребления.

Потребление энергии исключительно чипами GDDR5-памяти в современных топовых видеокартах по оценке компании AMD уже сейчас составляет около 15-20% — то есть из 250 Вт потребления видеокарты Radeon R9 290X где-то до 40-50 Вт тратится на обеспечение работы чипов памяти. Такие данные получились даже с учетом того, что в AMD намеренно выбрали более широкую 512-битную шину памяти в GPU и использовали не слишком быструю GDDR5-память, работающую на частоте 5 ГГц — как раз для того, чтобы снизить потребление энергии видеопамятью.

А если представить точно такой же графический процессор, но с GDDR5-памятью, работающей уже на частоте в 7 ГГц? Видеопамять в таком случае будет потреблять еще больше энергии, что лишь усугубит проблему энергоэффективности и оставит GPU без необходимой доли энергии. Компания AMD показывает диаграмму изменения потребления питания GPU и RAM — если ничего не менять, то скоро они сравняются по пожиранию энергии, что приведет к снижению общей производительности.

Мы уже не раз говорили о том, что в настоящее время вопрос энергопотребления стал важнейшим из параметров для любой электроники, так как он напрямую связан с энергоэффективностью и производительностью, и его важность лишь продолжит усиливаться в будущем. Возьмем мобильные устройства, часто работающие в автономном режиме — время их работы полностью зависит от энергоэффективности внутренней начинки, так как объем батарей увеличивать уже просто некуда, ведь на этот параметр накладываются физические ограничения.

Но не только популярные мобильные устройства нуждаются в энергоэффективных решениях. Высокое потребление энергии ограничивает производительность и настольных CPU и GPU, ведь пределы потребления энергии ими неизменны уже несколько лет, расти может лишь производительность (а вместе с ней и энергоэффективность). И основной тренд на рынке сейчас такой, что ему требуются все более энергоэффективные устройства и чипы.

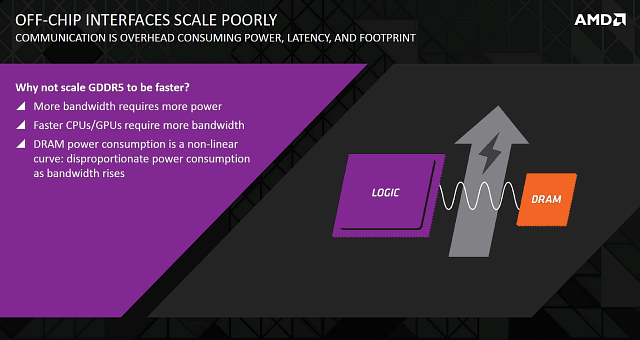

И это еще не все проблемы нынешнего стандарта памяти GDDR5. Также эти чипы занимают слишком много места на плате и требуют применения нескольких каналов памяти, что усложняет сам графический процессор. Особенно если говорить о топовых GPU с 384-битной или даже 512-битной шиной памяти. Не то чтобы сам по себе размер видеокарт имел слишком большое значение для игровых ПК, но ведь в последнее время появляется довольно много компактных корпусов, применять в которых нынешние видеокарты весьма сложно, а минимизация размера платы в этом как раз и поможет.

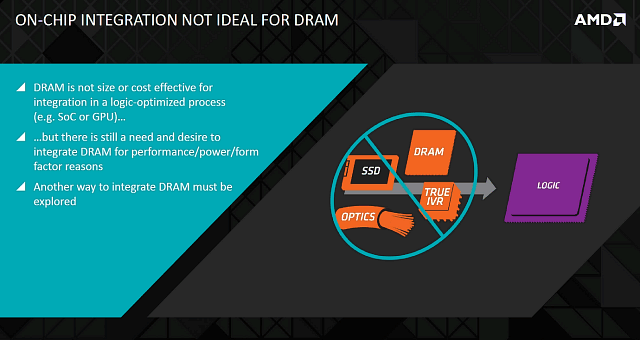

Теоретически, можно было бы встроить DRAM прямо в кристалл видеочипа, но это не будет эффективным решением, так как параметры технологических процессов для производства кристаллов GPU и RAM нужны совсем разные, и интеграция на одном чипе не будет оправданной с точки зрения производства.

То есть такой вариант тоже не подходит, но и с GDDR5 продолжать прогрессировать вскоре будет невозможно из-за снижения энергоэффективности этого типа памяти. Именно поэтому инженеры сразу нескольких компаний несколько лет назад и начали разработку новых поколений стандартов памяти со сверхширокой шиной, в том числе и HBM.

Устройство и специфика HBM

Исходя из сложностей и проблем развития и совершенствования GDDR5-памяти и аналогичных технологий памяти, разработка новых стандартов с широкой шиной в последние годы привела к появлению «широких», но медленных интерфейсов. Это можно представить как переход от быстрой последовательной работы микросхем памяти к медленным параллельным интерфейсам. Если в прошлые годы было проще увеличить тактовую частоту, чем расширить шину памяти, то теперь мы уперлись в скорость передачи данных с каждого чипа и пришло время распараллеливать сам интерфейс. Пусть этот путь и связан с определенными сложностями, но когда-то к нему все равно пришлось бы переходить.

В стандарте HBM и аналогичных ему, вместо массива очень быстрых чипов памяти (7 ГГц и выше), соединенных с графическим процессором по сравнительно узкой шине от 128 до 512 бит, применяются очень медленные чипы памяти (порядка 1 ГГц эффективной частоты), но ширина шины памяти при этом получается шире в несколько раз. Как и в случае с GDDR5, ширина шины для различных GPU будет разной и она зависит как от поколения стандарта HBM (первого или второго на данный момент), так и конкретного воплощения.

Компания AMD говорит о применении четырех стеков (stacks, стопок или пачек) чипов памяти, каждая из которых состоит из четырех микросхем и дает 1024-битный интерфейс памяти. То есть в итоге на GPU получаются просто широченная по меркам GDDR5-памяти шина в 4096 бит. Естественно, что при этом чипам памяти не обязательно работать на таких высоких частотах, как в случае GDDR5 — даже низких частот будет достаточно, чтобы по полосе пропускания памяти (ПСП) заметно обойти привычные доселе интерфейсы.

Конечно, интересующимся технической стороной дела хотелось бы узнать не только цифры ПСП, но и то, каким образом они достигаются. Сама по себе идея сверхширокой шины памяти лежит на поверхности, но одно дело теория, а совсем другое — практика. Именно сложности с практической реализацией присоединения очень широкой шины и не давала воплотить все это ранее.

4096-битная шина памяти требует значительно большее количество соединений, по сравнению с привычной GDDR5, и все они должны поместиться физически, чтобы такая шина работала. Именно эти параллельные соединения и являются главной проблемой в воплощении GPU с HBM-памятью, и для успешного решения задач по их размещению в новом типе памяти применяется несколько новых технологий, о которых мы сейчас и расскажем.

Самым важным вопросом, который встал перед инженерами, является эффективная разводка 4096-битной шины памяти. Ведь даже самые последние технологии производства чипов имеют свои ограничения, и графические процессоры никогда не переходили предел в 512 бит, даже в самых последних топовых графических чипах вроде Hawaii. Организовать еще более широкую шину памяти на больших GPU теоретически можно, но решение этой очень сложной задачи будут ограничивать физические возможности по размещению такого количества соединений и на печатной плате и в самом чипе, не говоря уже о необходимом количестве контактов на корпусах типа BGA.

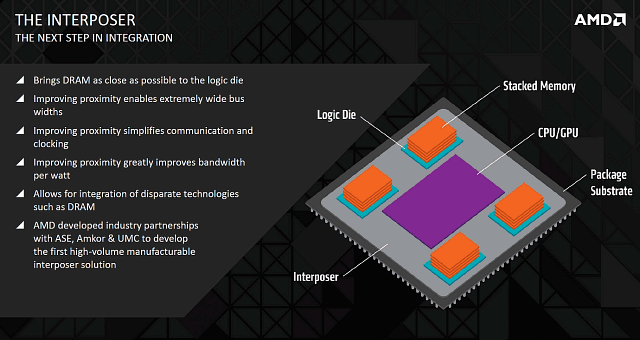

Решением первой части этой задачи стала разработка специального слоя, который способен вместить соединения большой плотности — кремниевой подложки (interposer). Этот слой похож на обычный кремниевый кристалл, в котором вместо некоей внутренней логики размещены исключительно металлические слои для передачи сигналов и питания между различными компонентами — этакий переходник. При производстве interposer используются возможности современных литографических процессов, позволяющих разместить очень тонкие проводники, которые практически невозможно вместить на традиционных печатных платах.

Использование такого слоя-переходника решает часть фундаментальных проблем по размещению широкой шины памяти, а также дает и другие преимущества. Так, вместе с решением проблемы маршрутизации проводников, эта кремниевая подложка позволяет разместить чипы памяти очень близко к GPU, но не прямо на кристалле, как применяется в случаях мобильных систем-на-чипе, например. Ведь подобное решение (package on package, или PoP) попросту невозможно для выделяющих значительное количество тепла графических процессоров.

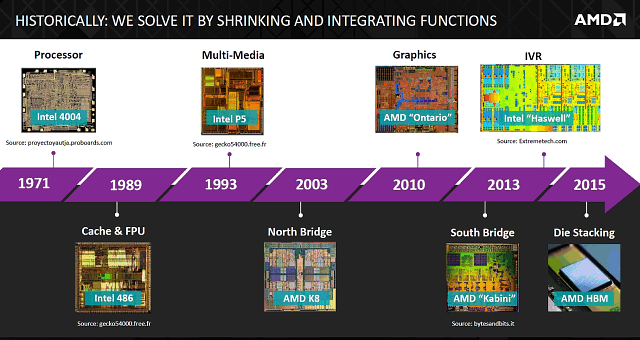

А если поместить микросхемы памяти близко к графическому чипу, то и длинных соединений между ними не требуется, что упрощает конструкцию и предъявляет менее жесткие требования по питанию. Помещение чипов памяти вместе с основной логикой также выигрывает в повышении степени интеграции — большее количество функциональной логики можно собрать в одной упаковке, что уменьшает количество необходимой внешней обвязки. А достижение высокой степени интеграции — давний тренд в индустрии. Все постепенно интегрировалось в кристаллы: сначала кэш-память и FPU, затем чипсетная логика и графические ядра, а теперь вот и память перебирается поближе к вычислительным ядрам.

Конечно, у решения с промежуточным слоем интерпозера есть и свои недостатки — это усложнение конструкции и повышение себестоимости производства. Естественно, что никто из AMD пока что не говорит о стоимости производства первых чипов с HBM, но очевидно, что добавление дополнительного слоя, а также его соединение и тестирование всего продукта, включающего сложнейшую логику, может лишь увеличить его себестоимость, особенно в самом начале его производства. И особенно — по сравнению с давно отработанными технологиями производства традиционных печатных плат и чипов без кучи слоев, соединенных друг с другом.

Ну хотя бы сам по себе слой интерпозера не столь сложен, как сам графический процессор и он не требует столь же сложного и современного производственного процесса. Отработанного годами и весьма недорогого по современным меркам техпроцесса 65 нм здесь более чем достаточно. И все-таки интерпозер явно добавляет некоторую сумму к себестоимости всего продукта с поддержкой HBM, так что абсолютно логичным выглядит первое применение этого типа памяти пока что лишь исключительно в топовых GPU. Про менее дорогие видеокарты и уж тем более гибридные процессоры APU можно говорить пока что лишь теоретически и с большой осторожностью.

Рассматривая весь «бутерброд» в разрезе, можно увидеть, что интерпозер становится новым слоем между традиционной упаковкой и чипами DRAM с дополнительной управляющей логикой, смонтированными прямо на интерпозере. Для связи чипов памяти и логики с интерпозером используются специальные соединения типа microbump и TSV (through-silicon vias), далее интерпозер соединяется с основным кристаллом, а тот уже привычно соединен с печатной платой контактами BGA.

Само по себе присоединение чипа с HBM-памятью к печатной плате несколько упрощается, так как в данном случае на PCB не будет никаких соединительных линий к микросхемам памяти, останутся только линии для передачи данных (по шине PCI Express и т. п.), а также для питания графического процессора и микросхем памяти. Часть этих сложностей переходит на слой интерпозера, поэтому его тестирование при производстве становится одной из самых важных задач.

Еще один важный технологический момент в присоединении чипов HBM-памяти друг к другу заключается в создании соединений типа through-silicon vias (TSV). Если интерпозер решает задачу маршрутизации широкой ширины памяти для GPU, то этот тип соединений позволяет соединить стопку микросхем памяти в единый 1024-битный стек. Причины для такого объединения нескольких чипов просты — облегчение производства и снижение количества отдельных устройств в системе. Главная сложность в том, что традиционные методы соединений, какие используются в упаковке PoP, не способны обеспечить достаточную плотность соединений, их должно быть очень много и они очень маленькие.

Поэтому проблема объединения стопки чипов DRAM была решена при помощи TSV-соединений. Обычные типы соединений позволяют соединить два слоя вместе, а TSV расширяет эти возможности, соединяя и дальнейшие кремниевые слои. С точки зрения производственного процесса, соединения типа TSV сложнее в производстве и объединение чипов DRAM в стеки является непростой технологической задачей. К стопке чипов памяти снизу присоединено еще и логическое ядро, которое отвечает за работу всех чипов DRAM в стеке и управляет шиной HBM между стеком и GPU.

Главным ограничителем для дальнейшего роста производительности сейчас являются возможности по изготовлению слоя интерпозера — в нем нужно сделать много очень маленьких соединений для нескольких слоев памяти. Именно поэтому количество слоев пока что ограничено четырьмя, а размещения восьми слоев придется немного подождать — в HBM второго поколения уже будет восемь слоев (и вдвое больше ПСП при прочих равных условиях, соответственно). В остальном HBM2 будет мало отличаться от HBM1. Разве что еще ожидается поддержка коррекции ошибок ECC, важная для применения в профессиональных решениях.

Преимущества и недостатки нового стандарта памяти

После рассмотрения технических вопросов о том, как именно устроена HBM-память, переходим к характеристикам ее производительности и другим преимуществам HBM. Хотя сходу может показаться, что тут все просто, но кроме банального прироста в полосе пропускания памяти, более низкое потребление и физически меньший размер дают дополнительные плюсы перед GDDR5-памятью.

Но сначала поговорим о чистой производительности. Что даст применение HBM? Ответ не так прост и зависит от того, сколько стеков (стопок) чипов памяти установлено в данном продукте, от количества чипов памяти в стеке и от частоты работы этих чипов. Тут важно отметить разницу между двумя поколениями HBM-памяти. Первое поколение, которое и ожидается к применению в следующем топовом GPU AMD, позволяет использовать 1024-битные стеки из четырех чипов, работающих с частотой до 500 МГц, которая соответствует эффективной частоте в 1 ГГц для DDR-памяти. То есть каждый стек способен обеспечить до 128 ГБ/с полосы пропускания видеопамяти.

В теории, HBM позволяет использовать и восемь стеков на один чип, когда каждый из стеков включает 1 ГБ памяти. Но AMD приводит пример, в котором используется четыре стека, что дает нам итоговую пропускную способность в 512 ГБ/с. Конечно, это больше, чем 320 ГБ/с у Radeon R9 290X и 336 ГБ/с у лучшей карты конкурента Geforce GTX Titan X, но обеспечивает лишь до 60% прироста в ПСП — не слишком много для абсолютно нового типа памяти с такой широкой шиной, ведь чисто теоретически можно предположить появление GPU с 512-битной шиной и применением очень быстрой GDDR5-памяти, которая по ПСП не уступит первому варианту HBM-памяти.

Любопытно, что представитель AMD уверил нас, что и задержки доступа к памяти в случае с HBM получаются чуть ниже — на 15-20% по сравнению с GDDR5. Это не так уж важно для графических задач, но очень важно для CPU и некоторых вычислительных задач на GPU. Кроме того, в будущих продуктах HBM-память можно будет применять в том числе и в качестве кэш-памяти последнего уровня, например, но это скорее вопрос к разработчикам CPU, чем GPU.

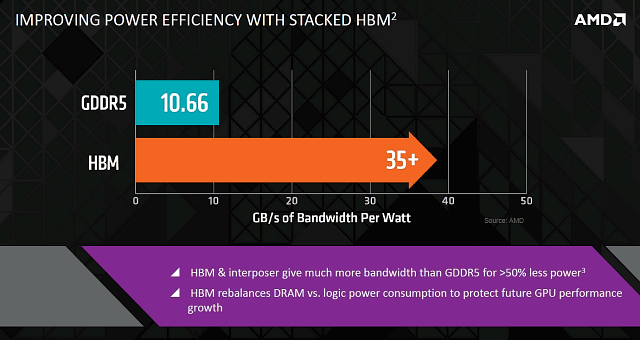

Кроме повышения ПСП и небольшого снижения задержек, применение HBM обеспечивает и снижение потребления энергии всей подсистемой памяти. Мы уже писали выше о том, что в текущем топовом решении Radeon R9 290X до 15-20% из 250 Вт общего потребления энергии, расходуется на питание чипов GDDR5. Если посчитать, то это будет до 37,5-50 Вт в абсолютных цифрах. Хотя из следующей диаграммы AMD следует, что GDDR5 обеспечивает 10,66 ГБ/с ПСП на 1 Вт, то есть по этим расчетам потребление GDDR5-памяти получается несколько ниже — 30 Вт. HBM же память дает более 35 ГБ/с на ватт, то есть обеспечивает более чем втрое лучшую энергоэффективность, по сравнению с GDDR5.

Доля памяти в общем энергопотреблении видеокарт пока что может быть и не слишком велика, но она постоянно растет, и чем дальше — тем будет только хуже. Ведь рост потребления энергии чипами GDDR5 в зависимости от ПСП нелинейный, потребление энергии растет быстрее, чем тактовая частота и обеспечиваемая ПСП, и в будущем такая ситуация начала бы ограничивать общую производительность видеокарт.

Преимущество в энергоэффективности позволяет или улучшить производительность или сэкономить энергию. Последнее важно скорее для мобильных решений, а для ожидаемого топового GPU можно повысить ПСП при отсутствии роста потребления энергии. Так что вряд ли энергопотребление снизится настолько уж сильно. Если взять предполагаемое значение итогового ПСП в 512 ГБ/с при четырех стеках HBM-памяти, то такие чипы будут потреблять около 15 Вт против 30 Вт у 320 ГБ/с GDDR5 в случае Radeon R9 290X.

Это преимущество в 15 или даже 20-25 Вт (с учетом разницы в ПСП) можно потратить на разные вещи, но для топового GPU вероятнее именно увеличение производительности. Ведь та же технология управления питанием PowerTune ограничивает общее потребление видеокартой, и большая доля питания, выделенная для GPU, позволит компании AMD повысить тактовые частоты для следующего топового графического процессора с HBM. Увы, конкретных цифр у нас пока что нет, ни итоговой ПСП конечного продукта, ни тактовых частот, ни цифр энергопотребления. Так что мы можем только гадать, что в итоге получится у AMD.

В любом случае, все графические процессоры в большей или меньшей степени страдают от недостатка в пропускной способности памяти — во многих случаях это негативно влияет на общую производительность 3D-рендеринга. И у нас нет никаких сомнений в том, что резкое увеличение ПСП будет благом, и применение HBM лишь улучшит итоговую производительность.

Но тут есть одна оговорка — даже имея преимущество по ПСП, существующие решения компании AMD зачастую или не быстрее соперничающих видеокарт Nvidia, или даже несколько медленнее их. Так что мы бы хотели предостеречь от слишком больших ожиданий от внедрения HBM-памяти, по крайней мере в игровых задачах. Похоже, что у соперника AMD лучше работают технологии по сжатию информации во фреймбуфере (применяются методы без потерь, разумеется).

Но если новый GPU AMD будет основан на архитектуре GCN 1.2 или более новой, то есть шанс к улучшению ситуации, так как именно в этой версии архитектуры были внедрены новые методы сжатия данных, что должно выправить ситуацию. Так что ожидаемый топовый графический процессор AMD получит высокую ПСП физически, да еще и улучшенную эффективность ее использования, что должно дать некоторое преимущество в условиях ограничения общей скорости рендеринга полосой пропускания — например, в высоких разрешениях.

С точки зрения проектирования самого графического процессора, с применением HBM можно сэкономить и площадь кристалла GPU, которую занимают контроллеры памяти — так как протоколы памяти сильно упрощены, по сравнению с GDDR5. Отсюда же следует некоторая экономия энергии, потребляемой этими контроллерами памяти — есть преимущество по энергоэффективности в том числе и со стороны GPU — видеочип с HBM-памятью также потребляет меньше энергии при прочих равных, а не только сами чипы памяти.

Еще одним преимуществом памяти стандарта HBM, отмечаемым компанией AMD в своих материалах, является компактность в смысле физических размеров всего устройства — GPU вместе с чипами DRAM занимает очень мало места, по сравнению с привычными для нас форм-факторами с большой печатной платой, отдельным GPU и микросхемами памяти, размещенными на ней на некотором отдалении. Естественно, что замена чипов GDDR5-памяти на маленькие HBM-стеки даст итоговое уменьшение размеров всей видеоплаты.

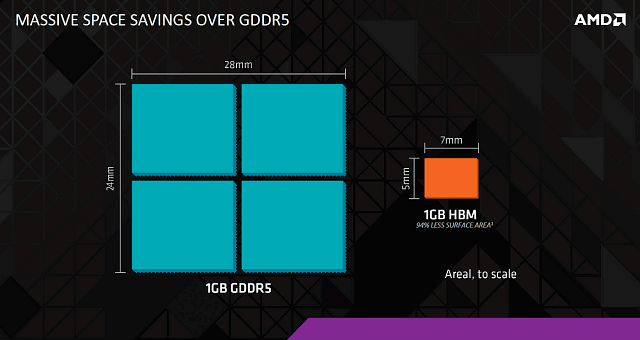

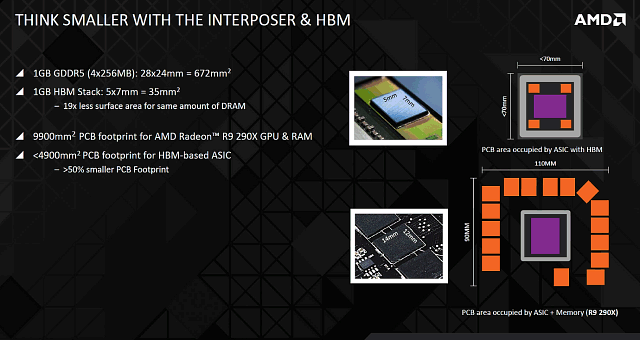

Насколько велика разница в размерах, и важна ли она? Как видно по иллюстрации выше, каждый гигабайт GDDR5-памяти, состоящий из четырех двухгигабитных микросхем, занимает до 672 мм², а такое же количество HBM-памяти в виде HBM-стеке займет лишь 35 мм² — это почти в 20 раз меньше! Даже если пересчитать цифры с применением четырехгигабитных микросхем, то разница по занимаемой площади останется почти на порядок.

Даже если брать площадь, занимаемую на PCB всеми микросхемами, то по расчетам AMD получается, что упаковка GPU с HBM-памятью займет порядка 4900 мм² против 9900 мм² у нынешней видеокарты Radeon R9 290X. Эту дополнительную экономию места можно также использовать в разных целях, особенно учитывая еще и то, что стеки HBM-памяти не нуждаются в отдельной сложной подсистеме питания, поэтому на практике разница будет еще больше.

К слову, конкурент AMD также уже показывал картинки аналогичного решения и рассказывал об экономии места и возможном появлении новых форм-факторов. Хотя экстремальным игровым энтузиастам на ПК не особенно нужно уменьшение физических размеров видеокарт, но для остальных людей уменьшение размеров одного из основных компонентов системы будет только на пользу — можно будет в маленький корпус засунуть мощный GPU с быстрой HBM-памятью. Главное — не забыть хорошо охладить такую систему.

И тут также есть некоторые вопросы, так как в случае подобного решения чипы DRAM и сам GPU будут в одной упаковке, которая наверняка будет накрыта единой теплоотводящей крышкой, покрывающей и HBM-стеки и ядро GPU. Будет ли в таком случае обеспечиваться достаточно эффективное охлаждение для всей системы и не повлияет ли на работу чипов памяти соседство с крайне горячим ядром графического процессора? Остается лишь ждать появления финального продукта AMD.

В этом же контексте интересно утверждение AMD о том, что разгон HBM-памяти будет осуществить даже проще, чем GDDR5, из-за сравнительно простой системы тактирования и меньшего напряжения питания. При этом, разгон HBM принесет большую пользу, так как даже маленькое увеличение частоты работы чипов памяти выльется в серьезное повышение ПСП из-за очень широкой шины памяти. Но это мы тоже сможем проверить лишь когда выйдет соответствующая видеокарта с новым GPU.

Но неужели у HBM-памяти и первого GPU с ее применением нет недостатков? На наш взгляд, главным минусом предполагаемой конфигурации из четырех стеков HBM-памяти станет общий объем видеопамяти — ведь четыре стека по 1 ГБ дают лишь 4 ГБ в целом. Мы до сих пор не уверены в том, что будущий продукт AMD будет включать лишь четыре стека HBM-памяти, но вероятность этого весьма велика. И запуск нового топового графического процессора, имеющего доступ лишь к 4 ГБ памяти, пусть и очень быстрой, потенциально может стать довольно большой проблемой, ведь решения конкурента будут иметь больше видеопамяти, хотя и медленной GDDR5, но с весьма эффективным ее использованием.

Причина этого ограничения в 4 ГБ во многом заключается в том, что в будущем топовом GPU AMD они решили применить HBM-память первого поколения, имеющую некоторые ограничения. Главным из которых является лишь четыре микросхемы DRAM на стек, что дает объем 1 ГБ на стек. И, судя по всему, текущий дизайн AMD позволяет разместить вокруг GPU всего лишь четыре стека, что и ограничивает общий объем четырьмя гигабайтами.

Возможно, дело в том, что размер вскоре выходящего GPU слишком мал для того, чтобы разместить на нем восемь стеков HBM, или дело в снижении себестоимости, так как новый тип памяти очень сложен в производстве, а значит и дорог. Ведь хотя применение HBM и обойдется дешевле, чем аналогичный стандарт stacked-памяти HMC, но такое решение явно дороже, чем подобный же объем GDDR5, что делает использование большего количества стеков еще менее практичным.

С одной стороны, объем видеопамяти в 4 ГБ до сих пор очень часто применяется даже в топовых решениях, и его может быть достаточно во многих условиях. С другой, самые современные игры вроде GTA V уже частенько желают больше памяти, чем 4 ГБ, особенно в самых высоких разрешениях, вроде 4K. И при нехватке видеопамяти под буферы, игровые текстуры будут то загружаться в память, то освобождать ее, что вызовет снижение производительности и неплавность частоты кадров. А ведь сейчас именно 4K и VR являются главными двигателями индустрии, и все они лишь увеличивают требования к объему видеопамяти. Как и многомониторные конфигурации, поддержкой которых славятся решения компании AMD.

Получается, что для игр решение с 4 ГБ HBM-памяти может быть спорным. А что с профессиональным рынком вычислений и рендеринга? Ситуация аналогичная, даже еще хуже — для профессионального рынка поддержка всего лишь 4 ГБ памяти — как насмешка, ведь для сложного рендеринга в реальном времени и множества вычислительных задач лимит в 4 ГБ памяти будет смерти подобен! Тем более, что конкурент предлагает полупрофессиональные и профессиональные решения, имеющие пусть и не столь шуструю память, но зато в три раза большего объема — 12 ГБ у той же Geforce GTX Titan X.

Может быть в AMD решились на применение такой памяти слишком рано и нужно было подождать коммерческой доступности второго поколения HBM-памяти, ведь его главное отличие в том, что будет удвоено число чипов DRAM на стек, а значит возрастет объем до 2 ГБ на стек, что позволит выпустить графический чип с 8 ГБ видеопамяти. Но это будет возможно лишь в будущем году, не раньше, и второе поколение будет доступно не только AMD, а они явно хотят стать первыми.

Заключение

Будущие стандарты памяти серьезно изменят несколько рынков, в том числе и графических процессоров, ведь тот же стандарт HBM предлагает значительно большую ПСП и заметное улучшение энергоэффективности. Такие типы памяти откроют для GPU новые возможности по росту пропускной способности — одного из важнейших препятствий для дальнейшего повышения производительности в графических задачах.

В стандарте памяти HBM используются 128-битные каналы, которые можно стыковать друг с другом до восьми микросхем в стопке, получая 1024-битный или даже 2048-битный интерфейс на каждый стек в итоге. Полная пропускная способность стека при этом будет 128 ГБ/с или 256 ГБ/с в зависимости от количества чипов памяти в нем: четыре или восемь. И будущие графические процессоры с HBM-памятью смогут иметь ПСП от 512 ГБ/с до 1 ТБ/с, тогда как текущий рекорд равен 336 ГБ/с (для Geforce GTX Titan Black и Titan X).

В общем смысле, стандарт stacked-памяти HBM абсолютно точно можно считать благом — он даст как повышенную производительность, так и снижение потребления, а энергоэффективность является самым важным параметром для всех современных решений. Гипотетическому GPU, чтобы достичь 512 ГБ/с, возможных с применением HBM первого поколения, нужно иметь 512-битную шину памяти и GDDR5-память, работающую на эффективной частоте в 8 ГГц. Теоретически, это вполне достижимые показатели, но при этом чипы памяти будут потреблять энергии порядка 50 Вт, в отличие от 15 Вт потребления аналогичной HBM-памятью. А ведь эти 35 Вт разницы можно отдать в пользу GPU, чтобы его исполнительные устройства работали на более высокой частоте, например. А для и так немало потребляющих графических процессоров архитектуры GCN 1.x это довольно важно.

Но вот что касается конкретно применения первого поколения HBM-памяти в будущем топовом графическом процессоре компании AMD, тут есть одно «но» — ограничение по объему видеопамяти с HBM первого поколения довольно жесткое. Как мы предполагаем, на следующую видеокарту AMD смогут установить всего лишь 4 ГБ HBM-памяти, что для продукта из топового сегмента крайне мало. Особенно с учетом популяризации 4K-разрешения, систем виртуальной реальности и распространения многомониторных конфигураций. И уж тем более — в требовательных играх, которые вполне могут использовать 5-6 ГБ и даже больше.

Еще один момент — да, у памяти стандарта HBM даже в первом поколении есть явное преимущество по энергоэффективности, которое можно потратить или в сторону повышения ПСП или снижения потребления (для мобильных GPU, например) — это надо решать в каждом конкретном случае отдельно. Но вот стоит ли овчинка выделки в первом поколении при не столь уж существенной разнице по ПСП для топовых решений? Ведь проблем при производстве добавляется очень много, да и себестоимость растет.

Что касается использования stacked-памяти в общем, то AMD не станет компанией, первой выпустившей на рынок продукт с использованием многослойной памяти, так как Samsung и Hynix уже выпускают модули DDR4 высокой плотности, использующие подобное решение и соединения типа TSV, но AMD точно станет первой на рынке с графическим процессором, поддерживающим HBM-память.

Хотя у первого поколения HBM есть явные недостатки, но новый стандарт абсолютно точно станет будущим общепринятым стандартом для видеопамяти по крайней мере для топовых GPU. Новая память даже первого поколения имеет значительное преимущество по производительности в плане пропускной способности, а также энергоэффективности.

Более того, компания AMD будет не просто первым производителем графического процессора с памятью стандарта HBM, но единственным производителем, кто освоит HBM память первого поколения. Ведь стандартом, одобренным комитетом JEDEC, станет лишь второе поколение — HBM2, а HBM первого поколения будет использоваться исключительно совместно AMD и Hynix. И до появления продуктов, использующих уже второе поколение HBM (HBM2), у AMD есть примерно с год форы по применению этой технологии, за это время только в их GPU мы увидим такую память. Вполне возможно, кстати, что и второе поколение они освоят быстрее конкурента — ведь опыт по работе с HBM-стеками то у них уже будет.

Но компания AMD постарается получить преимущество и в первом же графическом процессоре с поддержкой HBM. Хотя AMD пока что не разглашает подробных данных о производительности подсистемы памяти будущего графического процессора, зато о планах на использование HBM-памяти даже в будущих APU они рассказывают охотно, хотя это пока что является лишь теоретической возможностью.

Но когда применение HBM станет сравнительно недорогим, от AMD можно ожидать выпуска как бюджетных GPU с такой памятью, так и даже гибридных чипов APU с подобным типом памяти, так как нынешние поколения APU сильно страдают в том числе из-за малой ПСП их 128-битных интерфейсов памяти и применения DDR3-памяти. Представьте себе APU с несколькими CPU-ядрами нового поколения, относительно мощным GPU-ядром и общей HBM-памятью с огромной ПСП — это мечта многих разработчиков, и особенно хорошо такой чип подойдет для игровых консолей. Но для начала давайте дождемся топового GPU с памятью HBM — благо, ждать осталось совсем недолго.

И лавры достаются…

И лавры достаются…