Что такое GPU и в чём разница между видеокартой

Для проведения вычислительных операций в каждом современном компьютере предусмотрен не только центральный, но ещё и графический процессор (GPU). Последний преимущественно используется для отрисовки графики.

В этой статье разберёмся, какие бывают графические процессоры, чем они отличаются GPU от видеокарт, а также как узнать, какой именно GPU установлен в ПК или ноутбуке.

Что такое GPU

Что такое GPU в компьютере и для чего он используется

GPU это вспомогательный микрочип, который берёт часть вычислительных операций на себя вместо процессора. И за счёт специализированной архитектуры, GPU лучше подходит для проведения расчётов с плавающей точкой, тогда как CPU больше ориентирован на работу в многопоточном режиме.

То есть видеокарта GPU способна быстро проводить расчёты, где используется одна или схожая формула (например, вычисление точки затенения графики при попадании тени на текстуру). Центральный процессор же ориентирован на проведение расчётов сразу в несколько потоков, когда пользователь работает одновременно с большим количеством приложений.

Графический процессор и видеокарта одно и то же

Многие считают, что графический процессор (GPU) и видеокарта — это синонимы. Но это — ошибочное мнение. Графический процессор (GPU) — это микрочип, который представляет собой кремниевый кристалл. Визуально схож на CPU. Но архитектура GPU кардинально отличается от той, что используется в обычном центральном процессоре. В видео это объясняется простым языком

Видеокарта — это плата, которая включает в себя графический процессор, оперативную память, линию питания, шлюз для обмена информации (по линии PCI Express), а также набор видеовыходов для подключения мониторов.

То есть GPU — это часть видеокарты. С технической стороны, видеоадаптер — это мини-компьютер. Ведь у него есть собственный процессор (графический), ОЗУ, шина данных.

Что такое интегрированный графический процессор

Видеокарты вплоть до 2005 года выпускались в форме отдельной платы, подключаемой к материнской плате компьютера или ноутбука. Но затем графические процессоры (GPU) начали интегрировать в CPU, такие кристаллы принято обозначать как iGPU.

У них нет собственной оперативной памяти или кэша. Соответственно, при отрисовке графики они резервируют часть имеющейся в компьютере ОЗУ.

Также интегрированные GPU менее производительные. И за счет этого — потребляют в десятки раз меньше электроэнергии. Именно поэтому их чаще всего и используют в производстве недорогих ноутбуков, портативной техники.

Что такое графический процессор(GPU), интегрированный в CPU с технической точки зрения? Это отдельный кремниевый микрочип, который находится на одной плате («подложке») с центральным процессором. То есть он работает отдельно, хоть и использует ту же самую линию питания, что и CPU.

Как узнать какой GPU в компьютере

Узнать, какой графический чип установлен в ПК, дискретный или интегрированный можно двумя способами:

Есть нюанс: во многих современных ноутбуках устанавливается одновременно и интегрированная, и дискретная видеокарта. По умолчанию используется iGPU. А дискретный GPU задействуется в тех ситуациях, когда производительности iGPU недостаточно (например, при запуске видеоигры, приложения для видеомонтажа).

Графический процессор GPU при выполнении расчётов довольно сильно нагревается. Это специфика кремниевых кристаллов.

Температура свыше 100 градусов существенно ускоряет деградацию кремниевого кристалла. И именно перегрев — одна из самых распространённых причин выхода из строя видеокарт.

А для тестирования можно воспользоваться бесплатной утилитой Furmark.

Что делать, если температура в нагрузке CPU слишком высокая? Подробно описано здесь

Что такое дискретный графический процессор

Дискретный графический процессор — это тот, который устанавливается отдельно от CPU. Поставляется в форме платы, чаще всего — с портом PCI Express для подключения к материнской плате.

Недостатки встроенного GPU в компьютере

Ключевые недостатки интегрированных графических процессоров (iGPU):

Но есть у iGPU и весомое преимущество. Это малое энергопотребление.

Для сравнения, видеокарта GPU Nvidia Geforce последнего поколения потребляет порядка 300 Вт в нагрузке. Интегрированный графический процессор — порядка 3 – 10 Вт (в зависимости от модели видеокарты). Также следует упомянуть, что в игровых приставках последних поколений (XBOX, PlayStation), а также в портативной игровой консоли Steam Deck используются именно iGPU.

Аналитики вообще считают, что в ближайшие 10 – 20 лет дискретные видеокарты вообще станут невостребованными и их производство вовсе прекратят.

Итого, в каждом ПК или ноутбуке устанавливается два процессора, один из которых — графический( GPU). Интегрированные iGPU отлично подходят для «офисных» ПК, тогда как с дискретными GPU — для игровых компьютеров или так называемых «графических станций». А какая видеокарта установлена в вашем ПК или ноутбуке? Расскажите об этом в комментариях.

NVIDIA представила новую функцию пространственного масштабирования в играх как альтернативу DLSS для карт без RTX

Вместе с новой версией графического драйвера GeForce Game Ready 496.76 WHQL компания NVIDIA обновила алгоритм технологии Spatial Scaling или пространственного масштабирования (апскелинга) изображения в играх, а также выпустила более удобные инструменты управления функцией. Кроме того, данная технология стала открытой (open source). Производитель также сообщил об обновлении более передовой технологии интеллектуального масштабирования DLSS до версии 2.3.

Источник изображений: NVIDIA

У NVIDIA и AMD есть свои технологии масштабирования изображения в играх, позволяющие добиться более высокой частоты кадров при высоком разрешении картинки. Обе трансформируют изображение с более низким разрешением в изображение с более высоким разрешением, фактически дорисовывая недостающие пиксели. Принципиальная же разница между AMD FidelityFX Super Resolution (FSR) и NVIDIA Deep Learning Super Sampling (DLSS) заключается в том, что DLSS использует для этого машинное обучение и тензорные ядра видеокарт серий GeForce RTX. В свою очередь FSR опирается на более простую технологию пространственного апскейлинга.

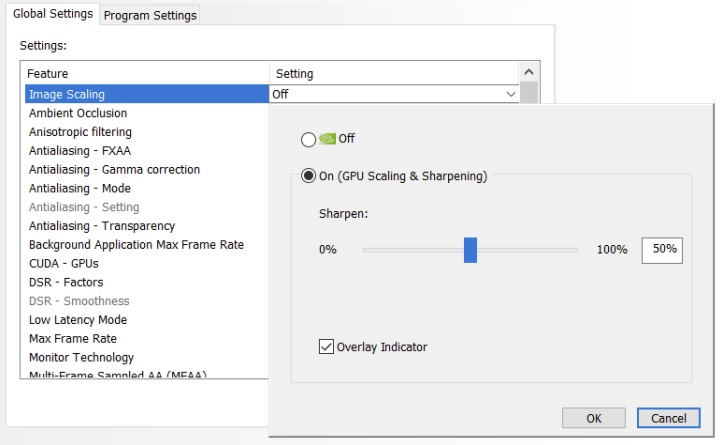

Однако видеокарты NVIDIA тоже поддерживают пространственный апскейлинг. При этом, в отличие от FSR, технология NVIDIA работает со всеми играми. Функция называется «Масштабирования изображения» (Image Scaling) и давно является частью драйвера NVIDIA. Она работает с видеокартами серии Maxwell и новее. Сегодня компания обновила алгоритмы масштабирования и повышения резкости изображения, а также добавила для неё более удобные инструменты управления.

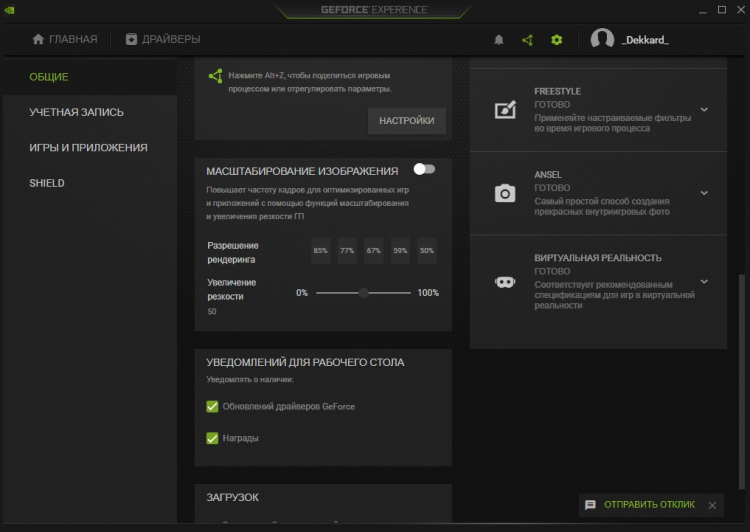

Теперь работать с функцией пространственного апскейлинга NVIDIA можно через приложение GeForce Experience. Ранее настройки были доступны только через «Панель управления NVIDIA». Сейчас в настройках GeForce Experience можно выбрать уровни разрешения рендеринга (значения от 50 до 85 %) и увеличения резкости (0–100 %).

Для этого необходимо открыть вкладку управления настройками резкости изображения, активировать ползунок Image Scaling и выбрать нужные показатели разрешения рендера. Функцией повышения резкости изображения, являющейся частью инструментов пространственного апскейлинга NVIDIA, можно управлять непосредственно в уже запущенной игре. Для этого необходимо нажать сочетание клавиш Alt+F3 и с помощью ползунка выбрать нужный уровень резкости в появившемся меню управления фильтрами.

Для подтверждения работы функции можно использовать оверлей программы GeForce Experience. Зелёный цвет индикатора NIS будет говорить о том, что функция Image Scaling и фильтр резкости работают. Индикатор можно включить в настройках «Панели управления NVIDIA».

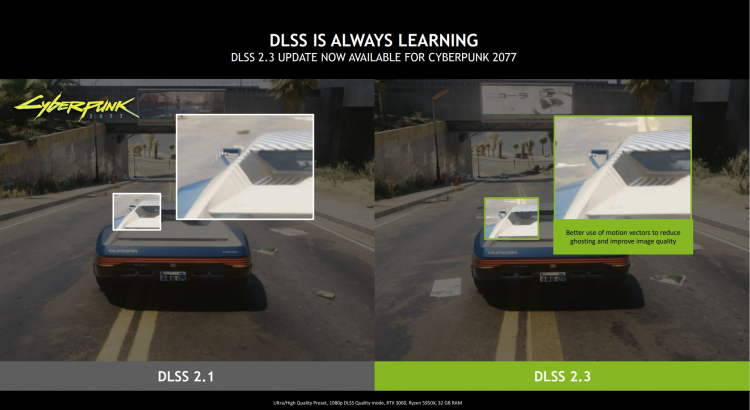

В NVIDIA отмечают, что эффективность технологии пространственного апскелинга гораздо ниже, чем у технологии DLSS, в чём можно убедиться, если взглянуть на изображения ниже. DLSS не только значительно улучшает изображение, но также повышает производительность игры. Однако поддержка DLSS должна быть реализована разработчиками в игре, тогда как апскейлинг работает везде, в любой игре. А за счёт того, что технология перешла в разряд Open Source, разработчики игр с помощью выпущенного NVIDIA набора инструментов Image Scaling SDK могут обеспечить поддержку апскейлинга в своих играх на GPU сторонних производителей, включая AMD и Intel. К слову, технология однопроходная и работает на шейдерах, она должна выдавать одинаковый результат на GPU разных производителей.

В то же время компания указывает, что более эффективную технологию интеллектуального масштабирования DLSS и функциональность настроек резкости изображения технологии Image Scaling можно использовать одновременно. Для этого Image Scaling необходимо активировать в «Панели управления NVIDIA» и запустить игру с поддержкой DLSS. Если в настройках игры не выбирать разрешение игры ниже родного разрешения экрана, то Image Scaling не будет пытаться масштабировать изображение, а только задействует фильтр резкости, что на выходе даст более качественное изображение. Синий цвет индикатора NIS в оверлее программы GeForce Experience будет говорить о том, что Image Scaling использует фильтр резкости, но не масштабирует изображение.

Что касается новой версии DLSS 2.3, то здесь NVIDIA поработала над векторами движения, которые используются для перепроектирования предыдущего кадра игры и наилучшего вычисления того, как должно выглядеть выходное изображение.

За счёт этого улучшается детализация и снижается эффекты двоения изображения и мерцания движущихся частиц.

Ускорение вычислений и экономия на ресурсах: когда нужны графические процессоры

Когда графические процессоры (GPU) только появились, никто и не думал, что со временем их станут так широко применять. Сегодня их применяют при исследовании КТ-снимков, производстве мультфильмов и поиске новых лекарств.

Изначально графические процессоры использовали для отрисовки пикселей в графике, а их основным преимуществом была энергоэффективность. Никто не пытался использовать GPU для вычислений: они не способны обеспечить такую же точность, как центральные процессоры (CPU).

Но затем оказалось, что точность вычислений на графических процессорах вполне приемлема для машинного обучения. При этом GPU способны быстро обрабатывать большие объемы данных. Так что сегодня их применяют в разных сферах, о самых интересных рассказываем в статье.

В подготовке статьи нам помогли эксперты Академии больших данных MADE от Mail.ru Group. Кстати, сейчас у них открыт набор на бесплатное обучение, где в том числе учат работать с GPU.

Графический процессор (GPU) — разновидность микропроцессора. В отличие от центрального процессора (CPU), в нем не десятки, а тысячи ядер. Из-за такой архитектуры у графических процессоров есть несколько особенностей:

Посмотрим на основные сферы применения технологии.

Графические процессоры применяют на всех этапах машинного обучения — при подготовке данных, тренировке моделей машинного обучения и их промышленной эксплуатации.

Последние поколения графических процессоров от NVIDIA содержат тензорные ядра — новый тип вычислительных ядер. По сравнению с классическими GPU они выполняют меньше операций за единицу времени, но еще более энергоэффективны. Это важно для крупных компаний с собственными дата-центрами.

Сегодня машинное обучение используют в различных отраслях, например в медицине. Решения на базе ИИ проверяют КТ- и МРТ-снимки и находят на них патологические изменения. В итоге врачи тратят меньше времени на работу со снимками, а риск человеческой ошибки снижается.

«Цельс» — ИИ-платформа для анализа медицинских изображений, она обрабатывает поступающие из больниц снимки. Например, на КТ-снимках легких система способна распознать злокачественные новообразования и COVID-19. Обработка одного исследования занимает 60 секунд, точность выявления патологии — 95%.

Машинное обучение лежит в основе и компьютерного зрения — нейросети, которая умеет распознавать людей и объекты на фотографиях и видео.

Например, компьютерное зрение внедрили в «Инвитро» для решения проблемы очередей. Сотруднику регистратуры требуется время на поиск карточки пациента в базе данных — пока он ищет, очередь увеличивается. Чтобы сократить время ожидания, на входе в клинику пациента снимает камера видеонаблюдения. Она передает изображение в систему, где компьютерное зрение распознает его личность и заранее открывает для регистратора нужную карточку. В итоге пациенты меньше ждут в очередях, а их лояльность возрастает.

Подобные технологии лежат и в основе Valossa AI. Компания предоставляет различные ИИ-решения для работы с изображениями и видео. В частности, нейросети способны обнаруживать в видео нежелательный контент, чтобы его удалить, или распознавать эмоции людей.

Функцию распознавания эмоций, например, использовали в шоу финской телекомпании Yle. По правилам, его участники слушали шутки, стараясь сохранить нейтральное выражение лица. ИИ оценивал, насколько им это удалось.

GPU изначально разрабатывали для работы с графикой. Так что сегодня их используют в системах, которые обрабатывают большие массивы изображений, например снимки из космоса.

Такие снимки в том числе используют, чтобы следить за состоянием лесов или развитием половодья. Но в исходном виде в снимках невозможно разобраться, поэтому их предварительно обрабатывают: убирают все лишнее и наносят определенную разметку — GPU помогают ускорить этот процесс.

«Банк базовых продуктов» Роскосмоса предоставляет другим ведомствам и ученым снимки с космических аппаратов. Используя их, оценивают качество поверхностных вод, состояние лесов, следят за пожарной обстановкой и паводками. Чтобы на снимках можно было легко найти нужную информацию, система предварительно их обрабатывает.

С каждым годом фильмы и мультфильмы, созданные с помощью компьютерной графики, выглядят все реалистичнее. Это достигается с помощью рендеринга — процесса визуализации.

Чтобы компьютерная графика выглядела на экране естественно, современные программы для рендеринга учитывают множество деталей — например, как падает свет и выглядят тени. Это требует больших вычислительных мощностей, так что крупные студии, как правило, используют графические процессоры.

Для мультфильма «Город героев» в Walt Disney использовали Hyperion — симулятор глобального освещения, который создавали около двух лет. Он производит сложные вычисления, чтобы рассчитать, как будет выглядеть непрямой свет, многократно отраженный от всех поверхностей. Для отрисовки «Города героев» расчеты проводились с помощью кластера, состоящего из 55 000 вычислительных ядер.

Еще графические процессоры применяют в KVM — специальных программах для геймеров, например, к ним относится Playkey. Они позволяют запускать игры с хорошей графикой на маломощных компьютерах за счет переноса нагрузки в облако. Так что мощный компьютер не требуется.

Тяжелыми называют вычисления, в которых задействованы сложные алгоритмы, из-за чего они потребляют большое количество ресурсов. Пример таких вычислений — докинг. Это метод молекулярного моделирования, он позволяет подобрать молекулу, которая лучше всего взаимодействует с нужным белком.

Это трудоемкая и дорогая работа, например, в США на разработку одного нового лекарства уходит в среднем 985 млн долларов. Используя графические процессоры, фармкомпании экономят на вычислительных мощностях, ускоряют разработку и за счет этого тратят меньше денег.

Например, в начале пандемии ученые из Московского государственного университета стали искать вещества, которые могут оказаться полезными для лечения коронавируса. Чтобы найти лекарство, они подобрали перспективный белок, проанализировали его структуру и создали модели для докинга. Молекулярное моделирование запустили на суперкомпьютере «Ломоносов».

Другой пример тяжелых вычислений — анализ большого количества разнородных данных. Например, он требуется при обработке сейсмографических данных.

В регионах, где давно добывают нефть, стандартные методы сейсморазведки уже не справляются с поиском залежей в нужных объемах. Так, например, случилось в Башкортостане, где первая скважина появилась еще в 1930-х годах.

Поэтому для разведки нефтяных запасов в ООО НПЦ «Геостра» использовали облачные решения. Расчеты велись на платформе Mail.ru Cloud Solutions. Для сложных расчетов использовали графические процессоры NVIDIA Tesla V100. Пилотный проект оказался успешным: удалось спрогнозировать эффективность будущих скважин и определить места для бурения.

На промышленных предприятиях умные датчики собирают данные о работе оборудования и передают их в аналитическую систему. Используя эту информацию, компании могут следить за работой оборудования, предсказывать поломки, планировать профилактические работы и думать над оптимизацией производства. Для того чтобы данные обрабатывались быстрее, используют графические процессоры.

Например, WaveAccess на базе Mail.ru IoT Platform разработала решения для Единой платформы сбора и анализа данных, с помощью которой государство контролирует природопользование. Всего решений четыре: система мониторинга воздуха, дистанционного надзора за объектами культурного наследия, незаконной вырубкой лесов и зарастания сельхозземель. Платформа собирает данные с помощью датчиков IoT и выявляет инциденты в режиме реального времени. На основании этих данных государственные органы проводят проверки.

Еще решения в области интернета вещей используют для создания цифровых двойников — виртуальных копий станков или целых заводов. В таком случае система не просто анализирует данные с умных датчиков, а строит на их основе трехмерную модель оборудования. Фактически инженеры на компьютере видят, как работает тот или иной станок.

На передачу и обработку данных требуется время. Поэтому на предприятиях, которым важно узнавать о неполадках в режиме реального времени, для ускорения работы используют графические процессоры.

Например, благодаря цифровому двойнику Московской ТЭЦ-20 удалось повысить эффективность работы предприятия на 4%. Другой пример — виртуальный прототип завода КАМАЗ, где оцифровали почти 50 станков, а также манипуляторы, производственные роботы и другое оборудования. Благодаря этому на предприятии могут контролировать все этапы сборки автомобилей.

На заводе Siemens в Амберге выпускают 12 млн программируемых логических контроллеров в год, то есть одно изделие в секунду. На предприятии объединили виртуальное и реальное производство: на изделия нанесены коды, которые передают оборудованию его маршрут и требования к каждой операции — за процессом следят специальные программы.

В итоге новые заказы на заводе выполняются за сутки, 99,99885% выпускаемой продукции полностью соответствует стандартам качества, а себестоимость снизилась на 25%.

Чтобы повысить скорость вычислений, необязательно закупать графические процессоры — мощности можно арендовать у облачного провайдера. У GPU в облаке есть несколько особенностей:

На платформе Mail.ru Cloud Solutions к виртуальным машинам можно подключить графические процессоры NVIDIA Tesla V100. Это одно из последних поколений GPU, в каждом процессоре 640 тензорных ядер. К нужной виртуальной машине графические процессоры подключают по запросу, для этого нужно обратиться в техподдержку.

На платформе есть и другие решения для машинного обучения и работы с большими данными. Используя их, можно построить в облаке собственную аналитическую систему или решение для тренировки нейросетей.

vGPU — использовать нельзя игнорировать

За июнь-июль к нам обратилось почти два десятка компаний, интересовавшихся возможностями виртуальных GPU. «Графикой» от Cloud4Y уже пользуется одна из крупных «дочек» Сбербанка, но в целом услуга не слишком популярная. Так что подобная активность нас весьма порадовала. Видя рост интереса к технологии, мы решили чуть подробнее рассказать про vGPU.

«Озёра данных», полученные в результате научных экспериментов и исследований, Deep Learning и другие направления работы с ИИ, моделирование крупных и сложных объектов — всё это требует высокопроизводительного «железа». Хорошо, если оно есть и позволяет быстро решать текущие задачи. Вот только из-за возрастающей вычислительной сложности задач (в первую очередь касается для бизнес-аналитики, рендеринга, DL-алгоритмов и фреймворков) аппаратные мощности настольных и даже серверных CPU всё чаще становятся бесполезны.

Выход был найден в использовании вычислений на GPU. Эта технология ускорения графики обеспечивает разделение ресурсов одного графического процессора между несколькими виртуальными компьютерами. GPU изначально проектировался для работы с графикой, потому состоит из тысячи мелких ядер, используемых для эффективной обработки параллельных задач. При этом на GPU выполняется часть самых ресурсоемких вычислений, остальное берёт на себя CPU.

Вычисления с помощью GPU придумала компания Nvidia ещё в 2007 году. Сегодня эта технология вышла на новый уровень и применяется в ЦОДах крупнейших предприятий и научных лабораторий. Однако у традиционного подхода есть один весомый недостаток: закупка физического оборудования обходится весьма недёшево. А если вспомнить скорость устаревания «железа», то становится ещё грустнее.

Проблему призвана решить технология виртуальных графических процессоров: vGPU. С её помощью пользователи могут удалённо запускать тяжёлые приложения вроде AutoCAD, 3DS Max, Maya, Sony Vegas Pro. Виртуализация быстро отвоевала свою долю рынка. Ведь какой русский data-scientist не любит быстрых вычислений на видеокартах NVidia Tesla?

Здесь стоит отметить, что до появления vGPU использовались другие методы ускорения обработки графики: Virtual Shared Graphics Acceleration (vSGA) и Virtual Dedicated Graphics Acceleration (vDGA). Решение vGPU объединило лучшее из обеих технологий. Как и в случае vSGA, в среде vGPU предполагается совместное использование GPU и RAM несколькими виртуальными рабочими столами, но при этом каждая ВМ передаёт команды напрямую к GPU, как в случае с vDGA.

Зачем вообще нужны vGPU

Облачные вычисления с использованием vGPU позволяют компаниям справляться с задачами, которые раньше невозможно было решить. Или возможно, но для этого требовалось нереально много ресурсов. 1 современный GPU-сервер способен заменить до 100 обычных CPU. Есть и другие, ещё более внушительные цифры. Это не шутки: решения Nvidia обрабатывают петабайты данных в несколько раз быстрее классических CPU-серверов. А тот же Google Cloud предлагает виртуальные машины с GPU, выдающие до 960 терафлопс.

Многие специалисты нуждаются в мощных устройствах, способных выполнять параллельные вычисления. Архитекторы и инженеры используют технологию vGPU в системах проектирования (тот же Autodesk, к примеру). Дизайнеры работают с цифровым фото- и видеоконтентом (Photoshop, CorelDraw). Виртуальные машины с графическими процессорами требуются и медицинским учреждениям, которые аккумулируют и анализируют данных о пациентах и заболеваниях. Работает с GPU и «Яндекс».

При всём при этом решения на базе vGPU пока что не получили широкого распространения в мире. Так, в 2018 году NetApp провёл опрос среди компаний, использующих в работе графические процессоры. Результаты показали, что 60% организаций по-прежнему работают на собственной ИТ-инфраструктуре. «Облаком» же пользуются лишь 23%. В России проникновение технологии облачных вычислений имеет меньшее значение. Но благодаря новым аппаратным и программным решениям число компаний, использующих виртуальные машины с GPU, постоянно растёт.

Решения для vGPU

Разработкой технологий виртуализации графических ускорителей занимается много компаний, но среди них есть безусловные лидеры.

Один из наиболее авторитетных разработчиков решений в сфере облачных решений, компания VMware предлагает компаниям гипервизор ESXi, под которым скорость работы виртуальных графических процессоров сопоставима с реализациями на голом железе. В недавнем обновлении разработчик отключил балансировщик нагрузки vMotion и добавил поддержку технологии DirectPath I/O, которая связывает драйвер CUDA с ВМ в обход гипервизора и ускоряет передачу данных.

Nvidia тоже старается соответствовать ожиданиям рынка, и для этого выпустила opensource-платформу Rapids. Решение объединяет несколько библиотек для работы с архитектурой CUDA, что упрощает работу с данными во время тренировки нейросетей и позволяет автоматизировать работу с Python-кодом. Использование Rapids с алгоритмом машинного обучения XGBoost даёт 50-кратное увеличение производительности по сравнению с системами на базе CPU.

Своя технология есть и у AMD. Платформа называется ROCm. Она использует технологию SR-IOV, которая делит аппаратные возможности физического устройства между несколькими виртуальными машинами. Ресурсы одного ускорителя можно разделить между шестнадцатью пользователями, поддерживая равную производительность для каждого из них. Таким образом ускоряется передача данных между облачными CPU и GPU. Также используется специальный диалект C++ под названием HIP, который упрощает выполнение математических операций на GPU.

Intel строит свою технологию базе кросс-платформенного гипервизора Citrix XenServer 7, который в 2017 году получил сертификат соответствия ФСТЭК. Решение объединяет работу стандартного GPU-драйвера и виртуальной машины. То есть «виртуалка» может поддерживать работу тяжёлых приложений на устройствах большого (несколько сотен) количества пользователей.

Рыночные перспективы

Независимые аналитики считают, что объём продаж решений для HPC-систем достигнет 45 млрд долларов к 2022 году. Разработчики платформ также ожидают увеличения спроса на высокопроизводительные системы. Это ожидание подкрепляется популярностью Big Data и часто возникающей необходимостью обрабатывать крупные объёмы данных.

Также рост спроса на vGPU может стимулировать развитие гибридных технологий, объединяющих GPU и CPU в одном устройстве. В таких интегрированных решениях два вида ядер используют общий кэш, что ускоряет перенос данных между графическими и традиционными процессорами.

Гибриды в корне изменили подход к виртуализации и распределению виртуальных ресурсов в рамках дата-центров. А решения с открытым исходным кодом наподобие ROCm и Rapids позволяют операторам ЦОД эффективнее использовать вычислительные ресурсы, повышая производительность оборудования.

Есть и другое мнение. Например, что виртуальные GPU будут вытеснены оптическими чипами с фотонным кодированием данных. Такие решения уже существуют и используются для машинного обучения. Более того, они кажутся производительнее обычного GPU. Но технология ещё сыровата.

Какой можно сделать вывод? Несмотря на возможное появление аналогов, vGPU — вполне перспективное направление, способное решать большое количество задач. Но подходит оно не всем. Так что запятую в заголовке можете поставить сами.