GPT-3 в картинках: краткий обзор

Технологический мир охватил новый хайп — GPT-3.

Огромные языковые модели (вроде GPT-3) все больше удивляют нас своими возможностями. И хотя пока доверие к ним со стороны бизнеса недостаточно для того, чтобы представить их своим клиентам, эти модели демонстрируют те зачатки разума, которые позволят ускорить развитие автоматизации и возможностей «умных» компьютерных систем. Давайте снимем ауру таинственности с GPT-3 и узнаем, как она обучается и как работает.

Обученная языковая модель генерирует текст. Мы можем также отправить на вход модели какой-то текст и посмотреть, как изменится выход. Последний генерируется из того, что модель «выучила» во время периода обучения путем анализа больших объемов текста.

Обучение – это процесс передачи модели большого количества текста. Для GPT-3 этот процесс завершен и все эксперименты, которые вы сможете увидеть, проводятся на уже обученной модели. Было подсчитано, что обучение должно было занять 355 GPU-лет (355 лет обучения на одной видеокарте) и стоить 4.6 миллиона долларов.

Для генерации примеров для обучения модели был использован набор данных размером в 300 миллиардов текстовых токенов. Например, так выглядят три обучающих примера, полученных из одного предложения, изображенного сверху.

На изображении видно, как мы можем получить множество примеров, просто проходя окном по имеющемуся тексту.

На ввод модели мы подаем один пример (отображаем только признаки) и просим ее предсказать следующее слово предложения.

Поначалу предсказания модели будут ошибочны. Мы подсчитываем ошибку в предсказании и обновляем модель до тех пор, пока предсказания не улучшатся.

И так несколько миллионов раз.

Теперь давайте рассмотрим эти этапы обучения чуть более подробно.

GPT-3 генерирует выход по одному токену за раз (условимся пока, что токен – это одно слово).

Стоит отметить, что эта статья — лишь описание работы GPT-3, а не обсуждение того, что нового эта модель предложила миру (по сути все сводится к до смешного огромным размерам). В основе архитектуры – модель декодирующего Трансформера, описанная в статье.

GPT-3 поистине ОГРОМНА. Она кодирует то, чему выучивается, в 175 миллиардов чисел (называемых параметрами). Эти числа используются для подсчета генерируемого за один прогон токена.

Необученная модель инициализирует параметры случайным образом, а затем в ходе обучения подбирает такие значения, которые помогут получить наилучшие предсказания.

Эти значения – часть сотен матриц внутри модели, а предсказания – главным образом, результат множества матричных перемножений.

В видео «Введение в ИИ на Youtube» показана простая модель машинного обучения с одним параметром – отличное начало для разбора этого 175-миллиардного монстра.

Чтобы пролить свет на то, как эти параметры распределяются и используются, нам нужно открыть модель и посмотреть на нее изнутри.

Ширина GPT-3 составляет 2048 токенов – это её «контекстное окно», что означает наличие 2048 траекторий, по которым продвигаются токены во время их обработки.

Давайте пройдем по фиолетовой траектории. Как система обрабатывает слово «robotics» и генерирует «A»?

Высокоуровнево шаги выглядят так:

Важные вычисления GPT-3 происходят внутри стека из 96 слоев декодера Трансформера.

Видите все эти слои? Это и есть та самая «глубина» «глубокого обучения» (deep learning).

У каждого слоя есть свои 1.8 миллиардов параметров для вычислений. Здесь и происходит вся «магия». Верхнеуровнево этот процесс можно изобразить следующим образом:

Вы можете увидеть детальное описание всего, что происходит внутри декодера, в статье GTP-2 в картинках.

Отличие GPT-3 состоит в изменении плотных (dense) и разреженных (sparse) слоев внутреннего внимания (self-attention).

Рассмотрим подробнее пример ввода предложения и вывода ответа «Okay human» внутри GPT-3. Обратите внимание, как каждый токен проходит через все слои стека. Нам не важен выход для первых слов: он начинает иметь значение, только когда ввод окончен. Далее мы отправляем слова выхода обратно в модель.

В примере генерации React кода на вход подается описание (выделено зеленым), по всей видимости, в дополнение к нескольким примерам вида описание => код. Затем код React генерируется точно так же, как и розовые токены здесь, один за другим.

Можно предположить, что начальные примеры и описания были добавлены на вход модели вместе со специальными токенами, отделяющими примеры от результата.

То, как это работает, впечатляет. Вам просто нужно подождать, пока завершится тонкая настройка (fine-tuning) GPT-3. И возможности буду еще более потрясающими.

Тонкая настройка просто обновляет веса модели для того, чтобы улучшить ее результат для конкретной задачи.

Нейросеть GPT-3 от OpenAI пишет стихи, музыку и код. Почему она пока далека от настоящего ИИ, но способна поменять мир Статьи редакции

Алгоритм выдаёт текст, который лишь кажется осмысленным, и на самом деле просто связывает уже созданные людьми данные.

В мае 2020 года OpenAI представила третью версию языковой модели GPT, которая позволяет генерировать текст, который не всегда можно отличить от того, что написал бы человек. В июле доступ к нейросети начали выдавать отдельным желающим, которых одобрили в компании, а разработчики в соцсетях начали восторгаться возможностям системы.

TJ рассказывает, в чём отличия GPT-3, на что способна нейросеть и почему пока далека от настоящего ИИ, но уже может всерьёз изменить жизнь людей.

На момент написания этого материала GPT-3 представляла собой самую сложную языковую модель. Среди других подобных алгоритмов её выделяет «натренированность»: система обучена на 1,5 триллионах слов, а её самая крупная версия занимает около 700 гигабайт.

GPT-3 генерирует текст на основе 175 миллиардов параметров — это значение отражает её вычислительную мощность. В зависимости от количества параметров система лучше или хуже оценивает данные и придаёт каким-то из них большее значение, а каким-то меньшее.

Суть работы нового алгоритма по сравнению с прошлой версией не изменилась. Нейросеть анализирует огромные массивы данных из интернета и на их основе пытается предсказать текст слово за словом, но ей всё равно нужна точка отсчёта — какой-то запрос, с которым можно работать.

Причём, чем больше входных данных дать системе и чем больше у неё будет попыток, тем убедительнее может получиться текст. Например, если дать ей начало известной поэмы в стиле одного автора, она сможет продолжить её в стиле другого.

GPT-3 продолжает подход OpenAI, заложенный в GPT и GPT-2. Обе первые версии системы были адаптацией Transformer — алгоритма Google, который впервые применили в 2017 году. Его ключевой функцией было «внимание» — возможность вычислять вероятность появления того или иного слова среди других слов.

OpenAI развивала свои модели вокруг этой функции, постоянно наращивая количество параметров. В 2019 году GPT-2 уже работала с 1,5 миллиардами параметров и угодила в скандал. Тогда алгоритм научили генерировать фейковые новости и не стали сразу выпускать в открытый доступ, опасаясь вреда, который он может нанести.

В GPT-3 параметров стало в сто раз больше, а для обучения авторы использовали вдвое больше данных, чем в GPT-2. В OpenAI утверждают, что это позволило добиться «мета-обучения»: например, нейросети не нужно каждый раз переобучаться, чтобы закончить предложение — если дать ей пример, она продолжит завершать все незаконченные предложения.

GPT-3 нельзя свободно использовать: пока OpenAI даёт доступ только отдельным разработчикам и исследователям в рамках закрытого бета-теста — для этого нужно заполнить объёмную заявку и дождаться её рассмотрения. Но даже после окончания тестирования нейросеть не выпустят в открытый доступ — её планируют продавать для бизнеса по подписке.

Хотя доступ к системе получили лишь немногие желающие, меньше чем за месяц алгоритм успели протестировать в самых разных сценариях: от написания песен, до создания кода и музыкальных аранжировок. По словам одного из испытавших систему разработчиков, в большинстве случаев система выдаёт убедительный результат если не с первой, то со второй или третьей попытки.

В основном, с помощью GPT-3 генерировали обычный текст: истории, песни, пресс-релизы и техническую документацию. Но один из разработчиков пошёл дальше и попросил нейросеть написать текст о самой себе — получилась статья с заголовком «GPT-3 от OpenAI может стать величайшим явлением после Bitcoin».

В материале автор рассказывал, что обучил нейросеть на собственных постах с форума bitcointalk, а потом публиковал записи, сгенерированные алгоритмом, и этого никто не заметил. Но в конце разработчик признался, что история выдумана и её написала GPT-3, хоть и не с первой попытки.

Другие разработчики обнаружили, что GPT-3 может генерировать любой вид текстовой информации, в том числе табулатуры для гитары и компьютерный код. Так разработчик Шариф Шамим показал, что система может работать с HTML-разметкой вместо естественного языка и создавать вёрстку по текстовым запросам. Например, можно сказать, какая кнопка и оформление должны быть у сайта — и нейросеть их визуализирует.

This is mind blowing.

With GPT-3, I built a layout generator where you just describe any layout you want, and it generates the JSX code for you.

Помимо этого, с помощью GPT-3 Шамим создал простой генератор приложений на основе React. Достаточно написать, что должна делать программа: алгоритм сам переведёт запрос в несложный код.

I built a todo list app simply by describing it to GPT-3.

It generated the React code for a fully functioning app within seconds.

I’m becoming more impressed and aware of its capabilities every single day. https://t.co/QGrClar03s

Другой разработчик создал плагин для Figma на основе GPT-3, который позволяет создавать дизайн, просто давая нейросети текстовое описание.

This changes everything. 🤯

With GPT-3, I built a Figma plugin to design for you.

Некоторые спрашивали у GPT-3 сложные технические вопросы, и получали корректные пояснения. Так один из разработчиков задал вопрос на медицинскую тематику, указал нейросети на корректный ответ и получил от неё развёрнутое пояснение, почему именно этот вариант ответа верный.

Один из разработчиков создал полнофункциональный поисковый движок на основе GPT-3. Он выдаёт конкретный ответ на любой вопрос и позволяет сразу узнать подробности в Википедии или в другом ресурсе, связанном с вопросом.

I made a fully functioning search engine on top of GPT3.

For any arbitrary query, it returns the exact answer AND the corresponding URL.

Look at the entire video. It’s MIND BLOWINGLY good.

В одном из примеров американский студент две недели публиковал в блог тексты об успехе и мотивации, сгенерированные GPT-3. Из любопытства он запустил продвижение блога и получил 26 тысяч посетителей, из которых почти никто не догадался, что тексты написаны алгоритмом, а тех, кто догадался, минусовали другие пользователи.

Авторы бесплатной текстовой квест-игры AI Dungeon также получили доступ к GPT-3 и обновили приложение. Они утверждают, что после этого игроки получили полную свободу действий: система корректно реагирует на все запросы и придумывает мир на их основе.

Среди других примеров — чат-бот для изучения языков, который позволяет разговаривать на выбранном языке и корректирует пользователя, если тот допускает грамматическую или стилистическую ошибку. Помимо этого, система может корректно рассчитывать химические реакции, поговорить о боге и позволяет обращаться к SQL с помощью запросов на естественном языке и не только — разработчики создали отдельный сайт, на котором собирают примеры использования GPT-3.

Another 🤯moment using GPT-3.

Created a bot for people learning a new language that:

— Chats with you in your language of choice.

— Corrects you when you make a grammar (and even style) mistake.

Even works well with 🇪🇸/🇫🇷 (and I’m sure many more).

Копирайтер Vs нейросеть GPT-3. Кто кого

Нейросеть GPT-3 — самый совершенный алгоритм, имитирующий естественный человеческий язык. Возможно, в ближайшем будущем он оставит копирайтеров и журналистов без работы. Да?

«Быть такого не может,» — подумал я и протестировал решения на основе данного алгоритма, ruGPT-3 и Copy.AI.

Так ли хороша нейронка, как о ней говорят? Вот и посмотрим. Заодно и поговорим о том, как ее появление скажется на работе копирайтеров.

Про GPT-3

Принцип работы (из материала РБК.Тренды)

«Нейросеть GPT-3 — Generative Pre-trained Transformer — разработана некоммерческой организацией OpenAI, которую основали глава SpaceX Илон Маск и экс-президент акселератора YCombinator Сэм Альтман. Третье поколение программы обработки естественного языка представили публике в мае 2020 года. Сегодня это самая сложная и объемная языковая модель из всех существующих.

Эта нейросеть подходит для решения практически любых текстовых задач, сформулированных на английском языке. Она очень гибкая, легко адаптируется к новым вводным данным. Превосходит роботов предыдущих поколений на порядок (или даже на несколько порядков).

175 млрд параметров, Для сравнения — в предыдущей версии было 1,5 млрд.

600 Гб датасета (вся англоязычная «Википедия», книги и стихи, материалы из СМИ и GitHub, путеводители и рецепты). У предшественницы — только 40 Гб.

архитектура «трансформер» (работает по принципу автодополнения, как Т9). В принципе, как и у предшественников.

Оценить качество работы новой нейросети можно по следующим материалам.

Сегодня доступ к нейросети открыт ограниченному кругу лиц. Но все же открыт, поэтому.

Русскоязычная версия — ruGPT-3

Поэтому российские умельцы разработали аналогичный алгоритм ruGPT-3 Large. Кстати, вот ссылка на статью об этом.

Согласно статье с портала Cnews, «это прообраз общего, или сильного, искусственного интеллекта (Artificial General Intelligence, AGI), способного решать разноплановые задачи в различных сферах деятельности.»

Она обладает следующими функциями:

пишет новости, романы, стихи, пародии, техническую документацию и др,

исправляет грамматические ошибки,

кодит (только я так и не понял, на каких языках).

Только нейросеть не генерирует текст и код «с нуля», а только продолжает действия пользователя вместо него. То есть обязательно нужен специалист, который начнет работу, а программа продолжит.

Ну вот, а я-то думал.

Все интересующиеся могут найти ее >> здесь

В результате я получил несколько куч словесного мусора. «Ну, наверное, примерно то же пишут горе-авторы на биржах контента по 20 ₽/килознак,» — подумал я.

Но, говорят, ruGPT-3 занимает лидирующее место в рейтинге нейросетей, и она отлично справляется с задачами на логику, здравый смысл, понимание текста.

«Странно. может для затравки ей нужен более осознанный текст (с большим количествчом исходных данных). ».

Мои ожидания были обмануты на 100%! Да если бы я такое написал, то был бы осмеян и опозорен (как заказчиками, так и другими райтерами).

Поэтому я оставил ruGPT-3 с ее «доеданиями животных» — и перешел к другой разработке с GPT-3. Честно говоря, я не надеялся увидеть что-то более-менее адекватное. Оправдались ли мои ожидания? Читайте и узнаете.

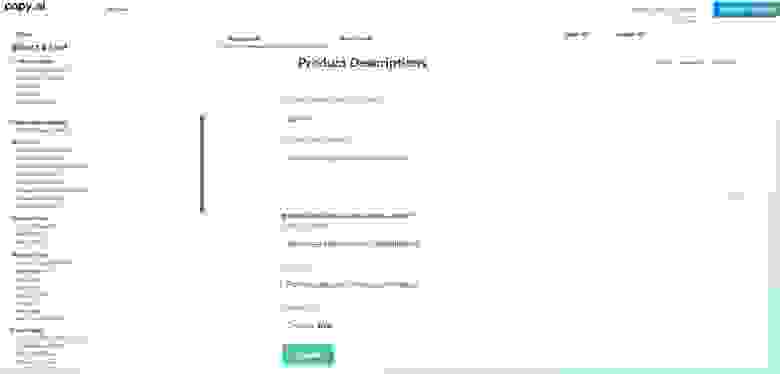

COPY.AI

Впервые я прочитал о нем на портале фрилансеров. Узнал, что его создали Крис Лу и Паул Якобян (явно не русские парни), поэтому он должен сильно отличаться от ruGPT-3.

«Ага, то есть это — инструмент для копирайтеров» — подумал я, потому что термин «страх чистого листа» — узкоспециализированный и крайне редко используемый, то есть программа не выполняет работу вместо копирайтера, а упрощает ее. «Ну-ну».

Далее. С ней можно писать 18 видов текстов: тексты объявлений, посты, контент для сайтов, тексты для интернет-магазинов, тексты для блогов, тексты для отделов продаж. О!

И много отзывов. Люди говорят, что программа — чудо, что она высвобождает уйму времени для писателей, что она помогает увеличить продуктивность писателя в 10 раз. Видимо, все очень хорошо.

Удивило: «она выдает умопомрачительные идеи» (brainstorming ideas).

Что меня порадовало

Огромное количество видов текста (в левой части кабинета, под надписью «Select tool»). Как я понял, в зависимости от выбранного вида текста меняется структура контента.

Работа с несколькими языками (вкладки «Input Language» и «Output Language»). Программа работает с немецким, британским английским, американским английским, французским, итальянским, испанским, японским, китайским, польским, португальским, бразильским и русским языками. Как пишет, так и переводит (Вау!)

Можно таргетировать текст на специфичную аудиторию (для этого нужно поставить галочку в поле «Need help targeting a more specific audience?»). Можно выбрать аудиторию по роду занятий и геолокации, выбрать особый инфоповод, выбрать предмет продвижения.

Что расстроило

англоязычный интерфейс. Хотя мне не важно (и с современными переводчиками юзерам тоже должно быть не важно). Однако некоторым не англоговорящим постоянные переводы будут не удобны.

Ну я заполнил поля — снова ввел историю о продаже цветов в Хабаровске.

И вот что получилось в результате. Честно: результат превзошел мои ожидания.

Текст довольно связный, но с ошибками — как будто переведенный через Google Translate.

+ Короткий. Такое ощущение, что просто подготовлен анонс текста в 3-4 предложениях.

То есть текст в результате нужно:

отредактировать (добавить идей),

откорректировать (убрать стилистические ошибки, добавить связки, форматировать, дописать).

Но. сервис обозначен, как сервис для копирайтеров — чего ж я ожидал (дописывать придется). Другой разговор, что заменить копирайтера у него явно не получится.

Вывод и разговоры о будущем.

Что ruGPT-3, что Copy.AI — явно не смогут заменить пишущих людей: у первой это не получится, а вторая создана не для этого.

Но что произойдет из-за появления этих программ? Однозначно, ничего страшного. Конечно, я не футуролог и не могу дать обоснованный прогноз с точностью 100%, но попытаться можно.

Пессимистичный прогноз

Бизнес ринется использовать нейронки для создания текстов. Она научится писать адекватные тексты — и составит конкуренцию пишущим людям.

Впрочем, без работы совсем она их не оставит, так как копирайтеры сами будут пользоваться ей.

Почему так может случиться:

потому что бизнесменам нужны тексты дешево и качественно,

и потому что есть тенденция к ускорению медиапотребления, то есть народ меньше читает (а нейросеть как раз меньше пишет).

Однако я предпочитаю ждать лучшего — и строить позитивные прогнозы.

Оптимистичный прогноз

Бизнес сразу поймет, что нейросеть не генерирует нормальные тексты — и призовет на помощь копирайтеров. То есть ситуация в мире останется без изменений.

Это может случится при условии, что явных потрясений в мире не произойдет (то есть не выйдет еще более усовершенствованная сеть GPT-4 или какой-нибудь Skynet не сотрет все тексты в мире).

Вероятностный прогноз

От нескольких людей слышал, что за рубежом — проблема с качеством контента. И с появлением GTP-3 ситуация не сильно изменится.

Соответственно, бизнес сочтет разработку бесполезной, и не будет пользоваться ей.

Хотя кому-то может и понравится. Ретрограды вроде меня будут продолжать писать и читать лонгриды. А вот представителям поколения Z вполне может хватить 3-4 предложений в тексте.

То есть, скорее всего, обе разработки с GPT-3 конечно найдут своих пользователей.

Однако, я должен отметить, что эти предсказания являются моими личными догадками, и вполне могут быть неправдой. В конце концов, я не Господь Бог и даже не футуролог, поэтому сколько-нибудь конкретных заявлений делать не могу.

Надеюсь, материал получился интересный и полезный.

Краткий экскурс в ruGPT-3. Инструкция и демонстрация

GPT-3 — нейронная сеть, наделавшая шума в 2020 году, как самая сложная, объёмная и многообещающая модель по работе с текстовыми данными. Создана организацией OpenAI в нескольких вариациях, от 125 миллионов до 175 миллиардов признаков. Хотя в названии организации и есть слово “Open”, по факту модель GPT-3 является проектом проприетарного типа, то есть, с закрытым программным кодом, доступ к которому выдаётся за деньги.

В октябре этого же года команды из SberDevices на основе статьи от OpenAI и кода модели GPT2 смогли разработать русскоязычный аналог под название ruGPT-3 в 5 вариациях от 125 млн. до 13 млрд. признаков, используя мощности суперкомпьютера «Кристофари», а самое главное, что в данном случае код действительно открытый, за исключением модели на 13 млрд.

За счет универсальности и гибкости модели ее можно использовать не только для создания текста, но и в десятках других сложных сценариев, например:

анализ настроений текста, их классификация на положительные и отрицательные;

из пункта 1. следует возможность использования для алгоритмов детоксификации, то есть, автоматического редактирования отрицательных текстов в положительные;

ранжирование картинок и подписей к ним – своеобразное computer vision решение, которое относит подпись к нужному изображению;

симплификация / суммаризация / резюмирование текстов, то есть, создание краткого пересказа, поданного на вход текста с сохранением смысла;

сервисы по генерации текста – Копирайтинг – Рерайтинг электронных писем, рекламных объявлений и прочего на заданную тему;

рекомендательные системы – анализ ранних запросов пользователей, список составленных предпочтений и предложение релевантного контента;

перевод текстов на различные языки;

чат боты для поддержания как неформальной беседы, так и в качестве составной части виртуального ассистента;

генерация программного кода по запросу пользователя

При использовании данной нейросети в качестве инструмента необязательно знать структуру кода или хитросплетения слоёв нейронов, но нужно понимать некоторые гиперпараметры, необходимые для настройки, так как они будут сильно влиять на результат. Проще всего отметить несколько универсальных стилей работы с данной моделью на примере задачи генерации текста.

Стиль 1. Строгий машинный подход к написанию текста

Настройка специальных гиперпараметров для данного случая не требуется. Отбор слов происходит по принципу наибольшей вероятности.

Стиль 2. Менее строгий подход к написанию текста

num_beams = n – кол-во путей с наибольшими неочевидными итоговыми вероятностными сочетаниями. Изначальный выбор путей происходит из топа величин вероятностей по первым нодам. На рисунке 2 — это случай выбора фразы «The dog has» при n=2, P = 0,36. Без данного параметра будет происходить «жадная» генерация текста, то есть, модель будет выбирать следующее слово, у которого вероятность появления после предыдущего максимальная «The nice woman», общая P = 0,2 — меньше чем при поиске пути

early_stopping=True — генерация подсчёта вероятностей завершается, когда достигнут конец предложения.

no_repeat_ngram_size = n – штраф за повторы в сочетаниях слов. Убирает повторы длиной в n слов, например, если текст про «Российскую Империю», то словосочетание «Российская Империя» при параметре n=2, не будет повторяться.

num_return_sequences = n – кол-во лучших вариантов генерации на вывод. Очень полезный параметр позволяет выбрать лучший вариант генерации, который более всех остальных отвечает целям оператора, но необходимо следить чтобы данный параметр был

temperature = n – используя данный коэффициент происходит увеличение вероятности использования слов с высокими значениями вероятности и уменьшение вероятности использования слов с низкой вероятностью в распределении. Также, чем ближе к нулю значение, тем больше генерация будет похожа на жадный подбор слов

top_k = n – определяется n кол-во слов, которые обладают наибольшей вероятностью из условного распределения вероятностей всех слов, что сужает выбор для модели и отбрасывает максимально неподходящие слова сразу

top_p = n – определяется n слов, чья вероятностная масса вместе равна n%, то есть ограничения сэмлирования происходят динамически, исходя из начального набора, можно комбинировать с top_k

Стиль 1 используется, если нужно получить точное определение, точный перевод, когда не нужно видеть других вариантов генерации. Стиль 1 следует правилу определения следующих слов, ориентируясь только на высокую вероятность их появления.

Стиль 2 лучше всего подходит, если известна заранее длина текста для генерации, и где творчество и непредсказуемость являются нежелательной чертой, но необходима гибкость в выражениях сохраняя общий формализм, то есть в случаях, например, деловой переписки или генерации чего-то одной природы, например, списков имён, цифр.

Стиль 3 следует использовать для генерации более непринуждённых бесед, рассказов, сочинений.

Посмотрим на модели поближе. Проведем эксперимент, дообучим 2 вида сети ruGPT-3 small (125 млн. признаков) и large (760 млн. признаков) на статьях с сайта NTA, используя мощности платформы Ml_Space от площадки SberCloud. Из спарсенных и размеченных 1117 статьях для обучения выберем одну, что снискала популярность на всем известном портале ‘Хабр’, и имеет более 2-х тысяч просмотров. Эта статья: «Поиск нарушений на видео при помощи компьютерного зрения».

Далее уберем эту статью из обучающей выборки и сгенерируем при помощи дообученных нейронных моделей отрывки текста, которые могли бы принадлежать к началу данной статьи. В качестве затравки будут подаваться на вход названия статей.

Отрывок кода, для процесса дообучения small и large версий модели:

В качестве результата сравнения будет субъективное мнение автора о том, логично ли составлен кусок текста и лучше или хуже он чем тот, что есть сейчас в статьях.

Затравка: «Заголовок: Поиск нарушений на видео при помощи компьютерного зрения»

Оригинал: «В нашем распоряжении имеются записи с камер наблюдения рабочего места сотрудника и журнал проведения операций. Будем искать все моменты на записи, где отсутствовал клиент. В этом нам поможет нейронная сеть MobileNet и CSRT Tracker из библиотеки opencv. А для удобства еще и Tesseract-OCR.»

Результат (Small): «Содержание: Как правило, в аудиторских расследованиях выявляются ошибки и несоответствия. При этом зачастую не удается найти причины нарушения или выявить отклонения от норм законодательства РФ – например нарушение сроков получения лицензии (внутренний аудит). Поэтому одним из решений для предотвращения подобных проблем является применение алгоритмов компьютерной визуализации с использованием компьютерных технологий. По мнению автора статьи Дэвида Мюррея Аудитора Веб-сайта MITSHOP, алгоритм распознавания лиц по изображению лица может помочь сократить количество ошибок оператора видеопотока данных во время передачи кадров о событии.»

Результат (Large): «Содержание: В работе аудитора часто встречаются случаи, когда в процессе проведения проверки выявляются нарушения законодательства РФ или иных нормативных правовых актов. Нередки ситуации выявления фиктивных трудовых отношений между сотрудниками и работодателями либо предоставления заведомо ложных сведений о состоянии здоровья сотрудника по результатам медицинских осмотров (обследований). В подобных случаях мы сталкиваемся с проблемой поиска нарушителей уже после совершения противоправной деятельности – например через анализ видеоматериалов видеонаблюдения за процессом исполнения служебных обязанностей сотрудников подразделения внутреннего аудита банка.»

По итогу, первый вариант генерации достаточно неплох, но под конец выдаёт бред про автора статьи, и демонстрирует потерю логической связи, второй вариант выглядит достаточно хорошо в качестве введения, не теряет логическую нить и более развёрнуто описывает проблему. Главное отличие оригинала от сгенерированных, это краткость изложения и погружения в инструменты работы сходу.

Продемонстрируем еще один пример использования данной сети и создадим рекомендательную систему по кинематографическим предпочтениям. Для примера будет взят пользователь из сайта Кинопоиск и сгенерированы фильмы, которые он смотрел на основе 2-х любых просмотренных из его истории, дальше проведено банальное сравнение, есть ли эти фильмы у него также в истории. То есть, модель не будет дообучаться, а будет строить продолжение из того, что уже знает.

Для данного случая воспользуемся вариантом ruGPT-3xl на 1,3 млрд признаков. В качестве стиля для генерации не подойдёт использование сэмплинга, ибо нужен более строгий подбор именно фильмов, в противном случае, алгоритм будет уводить в рассуждения о жизни и другие подобные темы.

Чтобы работать с данным xl вариантом необходимо сначала установить расширения для оптимизации смешанного и распределенного обучения в Pytorch – Apex, плюс язык для работы с ядрами – Triton и библиотеку для расширенного использования языковых моделей Deepspeed.

Фрагмент кода для настройки:

Сравнив данный результат с историей пользователя сервиса узнаём, что покрытие составляет 100%, это разумеется и потому что, алгоритм предлагает также и крайне популярные фильмы, но результат всё равно достаточно неплохой с учётом, что модель никак не дообучалась.

В качестве заключения приведу фразу, которую сгенерировала модель ruGPT-3 13B на 13 млрд. признаков, которую можно запустить только по API на площадке SberCloud, с затравкой содержащей начало вывода: «В качестве вывода можно сказать, что нейронная сеть GPT-3 => из эксперимента в эксперимент позволяет решать весьма интересные задачи. В дальнейшем на основе этой сети планируется создать интеллектуальные системы дистанционного управления движением ракет с применением технологии ГЛОНАСС или Galileo (если их реализация состоится). А также система мониторинга параметров ядерных установок ВВЭР и ЯБП может быть использована для поиска повреждений отдельных реакторов АЭС России», грандиозные планы, конечно.

Модели, рассмотренные в данной статье достаточно малы, в то время как уже сейчас существует модель на 1,6 трлн признаков от Google, что только говорит о начале использования данного инструмента, и перспективности задействования его, если не как основного, то дополнительного во многих сервисах, что существуют на сегодняшний день и еще только будут созданы.