Как настроить сетевой адаптер на Windows 7: самое важное

Иногда при подключении интернета или использовании ресурсов локальной сети возникают проблемы. Могут вылезать ошибки подключения, получения IP адресов или конфигурации сетевого оборудования. Внутри компьютера или ноутбука, функцией подключения к локальной или глобальной сети, занимается сетевой адаптер. В статье мы как раз и поговорим про настройку сетевого адаптера для улучшения связи в интернете. Инструкция будет ходовая для всех версий Windows 7, 8 и 10.

Более подробная настройка

Мне постоянно приходят письма с вопросами – как более детально настроить сетевой адаптер для меньшего пинга в играх, для лучшего просмотра кино и большей скорости скачивания. Поэтому я решил написать более детальную статью. Ну, поехали! По идее она настраивается автоматически под рациональное использование ресурсов системы и самого устройства. Но конфигурацию можно корректировать под свои нужды.

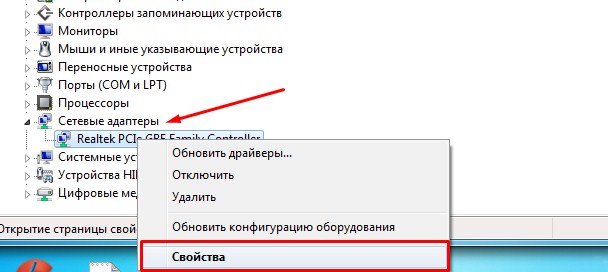

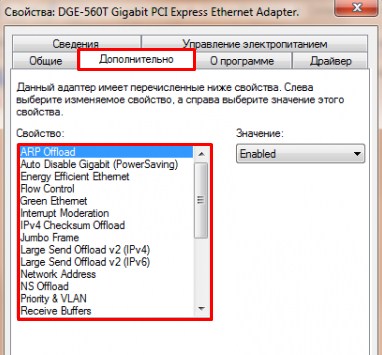

Переходим во вкладку «Дополнительно». И так смотрите, у нас есть определённые свойства, которые мы можем включать (Enebled) или выключать (Disable). На новых версиях «Виндовс» может быть написано «Вкл» или «Выкл». А теперь разбёрем каждое свойство:

ВНИМАНИЕ! Параметры адаптера могут в какой-то степени улучшить показатели, в каком-то моменте ухудшить. Изменяя установки сетевого адаптера, лучше возьмите листочек и выпишите – что именно вы изменили, чтобы в случаи чего вернуть параметры обратно. Также я рекомендую скачать последнюю версию драйвера для вашей сетевой карты или Wi-Fi модуля и установить его. Только после этого заходим в характеристики

После изменения, следует перезагрузить компьютер или ноутбук, чтобы некоторые изменения вступили в силу. Установки сетевого адаптера всегда можно откатить обратно, самое главное не потеряйте тот листок с настройками.

ПРОСЬБА! Если я что-то не указал, или написал что-то не так – пишите смело в комментариях свои исправления или замечания, буду рад поучиться чему-то у своих читателей.

Физика Ethernet для самых маленьких

Если не знаешь ответов на эти вопросы, а читать стандарты и серьезную литературу по теме лень — прошу под кат.

Кто-то считает, что это очевидные вещи, другие скажут, что скучная и ненужная теория. Тем не менее на собеседованиях периодически можно услышать подобные вопросы. Мое мнение: о том, о чем ниже пойдет речь, нужно знать всем, кому приходится брать в руки «обжимку» 8P8C (этот разъем обычно ошибочно называют RJ-45). На академическую глубину не претендую, воздержусь от формул и таблиц, так же за бортом оставим линейное кодирование. Речь пойдет в основном о медных проводах, не об оптике, т.к. они шире распространены в быту.

Технология Ethernet описывает сразу два нижних уровня модели OSI. Физический и канальный. Дальше будем говорить только о физическом, т.е. о том, как передаются биты между двумя соседними устройствами.

Технология Ethernet — часть богатого наследия исследовательского центра Xerox PARC. Ранние версии Ethernet использовали в качестве среды передачи коаксиальный кабель, но со временем он был полностью вытеснен оптоволокном и витой парой. Однако важно понимать, что применение коаксиального кабеля во многом определило принципы работы Ethernet. Дело в том, что коаксиальный кабель — разделяемая среда передачи. Важная особенность разделяемой среды: ее могут использовать одновременно несколько интерфейсов, но передавать в каждый момент времени должен только один. С помощью коаксиального кабеля можно соединит не только 2 компьютера между собой, но и более двух, без применения активного оборудования. Такая топология называется шина. Однако если хотябы два узла на одной шине начнут одновременно передавать информацию, то их сигналы наложатся друг на друга и приемники других узлов ничего не разберут. Такая ситуация называется коллизией, а часть сети, узлы в которой конкурируют за общую среду передачи — доменом коллизий. Для того чтоб распознать коллизию, передающий узел постоянно наблюдает за сигналов в среде и если собственный передаваемый сигнал отличается от наблюдаемого — фиксируется коллизия. В этом случае все узлы перестают передавать и возобновляют передачу через случайный промежуток времени.

Диаметр коллизионного домена и минимальный размер кадра

Теперь давайте представим, что будет, если в сети, изображенной на рисунке, узлы A и С одновременно начнут передачу, но успеют ее закончить раньше, чем примут сигнал друг друга. Это возможно, при достаточно коротком передаваемом сообщении и достаточно длинном кабеле, ведь как нам известно из школьной программы, скорость распространения любых сигналов в лучшем случае составляет C=3*10 8 м/с. Т.к. каждый из передающих узлов примет встречный сигнал только после того, как уже закончит передавать свое сообщение — факт того, что произошла коллизия не будет установлен ни одним из них, а значит повторной передачи кадров не будет. Зато узел B на входе получит сумму сигналов и не сможет корректно принять ни один из них. Для того, чтоб такой ситуации не произошло необходимо ограничить размер домена коллизий и минимальный размер кадра. Не трудно догадаться, что эти величины прямо пропорциональны друг другу. В случае же если объем передаваемой информации не дотягивает до минимального кадра, то его увеличивают за счет специального поля pad, название которого можно перевести как заполнитель.

Таким образом чем больше потенциальный размер сегмента сети, тем больше накладных расходов уходит на передачу порций данных маленького размера. Разработчикам технологии Ethernet пришлось искать золотую середину между двумя этими параметрами, и минимальным размером кадра была установлена величина 64 байта.

Витая пара и дуплексный режим рабты

Для соединения двух однотипных устройств, к примеру двух компьютеров, используется так называемый кроссовер-кабель(crossover), в котором одна пара соединяет контакты 1,2 одной стороны и 3,6 другой, а вторая наоборот: 3,6 контакты одной стороны и 1,2 другой. Это нужно для того, чтоб соединить приемник с передатчиком, если использовать прямой кабель, то получится приемник-приемник, передатчик-передатчик. Хотя сейчас это имеет значение только если работать с каким-то архаичным оборудованием, т.к. почти всё современное оборудование поддерживает Auto-MDIX — технология позволяющая интерфейсу автоматически определять на какой паре прием, а на какой передача.

Возникает вопрос: откуда берется ограничение на длину сегмента у Ethernet по витой паре, если нет разделяемой среды? Всё дело в том, первые сети построенные на витой паре использовали концентраторы. Концентратор (иначе говоря многовходовый повторитель) — устройство имеющее несколько портов Ethernet и транслирующее полученный пакет во все порты кроме того, с которого этот пакет пришел. Таким образом если концентратор начинал принимать сигналы сразу с двух портов, то он не знал, что транслировать в остальные порты, это была коллизия. То же касалось и первых Ethernet-сетей использующих оптику (10Base-FL).

Зачем же тогда использовать 4х-парный кабель, если из 4х пар используются только две? Резонный вопрос, и вот несколько причин для того, чтобы делать это:

Не смотря на это на практике часто используют 2х-парный кабель, подключают сразу 2 компьютера по одному 4х-парному, либо используют свободные пары для подключения телефона.

Gigabit Ethernet

Дальше — больше

10 Gigabit Ethernet уже во всю используется провайдерами, но в SOHO сегменте не применяется, т.к. судя по всему там вполне хватает Gigabit Ethernet. 10GBE качестве среды распространения использует одно- и многомодовое волокно, с или без уплотнением по длине волны, медные кабели с разъемом InfiniBand а так же витую пару в стандарте 10GBASE-T или IEEE 802.3an-2006.

40-гигабитный Ethernet (или 40GbE) и 100-гигабитный Ethernet (или 100GbE). Разработка этих стандартов была закончена в июле 2010 года. В настоящий момент ведущие производители сетевого оборудования, такие как Cisco, Juniper Networks и Huawei уже заняты разработкой и выпуском первых маршрутизаторов поддерживающих эти технологии.

В заключении стоит упомянуть о перспективной технологии Terabit Ethernet. Боб Меткалф, создатель предположил, что технология будет разработана к 2015 году, и так же сказал:

Чтобы реализовать Ethernet 1 ТБит/с, необходимо преодолеть множество ограничений, включая 1550-нанометровые лазеры и модуляцию с частотой 15 ГГц. Для будущей сети нужны новые схемы модуляции, а также новое оптоволокно, новые лазеры, в общем, все новое

UPD: Спасибо хабраюзеру Nickel3000, что подсказал, про то что разъем, который я всю жизнь называл RJ45 на самом деле 8P8C.

UPD2:: Спасибо пользователю Wott, что объяснил, почему используются контакты 1,2,3 и 6.

Качество сетей передачи данных. Программные и аппаратные измерения

Покупая продукт или услугу мы часто оперируем таким понятием как качество. Что же такое качество? Если мы обратимся к словарю Ожегова, то там увидим следующее: «совокупность существенных признаков, свойств, особенностей, отличающих предмет или явление от других и придающих ему определенность». Перенося определение на область сетей связи, приходим к выводу, что нам требуется определить «существенные признаки, свойства и особенности», позволяющие однозначно определить отличие одной линии или сети связи от другой. Перечисление всех признаков и свойств обобщаются понятием «метрика». Когда кто-то говорит о метриках сетей связи, он имеет в виду те характеристики и свойства, которые позволят точно судить о системе связи в целом. Потребность в оценке качества лежит большей частью в экономической области, хотя и техническая её часть не менее интересна. Я же попробую балансировать между ними, чтобы раскрыть все самые интересные аспекты этой области знаний.

Всех заинтересовавшихся прошу под кат.

Мониторинг и диагностика систем связи

Как я писал выше, метрики качества определяют экономическую составляющую владения сетью или системой связи. Т.е. стоимость аренды или сдачи в аренду линии связи напрямую зависит от качества этой самой линии связи. Стоимость, в свою очередь, определяется спросом и предложением на рынке. Дальнейшие закономерности описаны у Адама Смита и развиты Милтоном Фридманом. Даже во времена СССР, когда была плановая экономика, а о «рынке» думали, как о преступлении против власти и народа, существовал институт госприемки, как для военных, так и гражданских целей, призванный обеспечить надлежащее качество. Но вернемся в наше время и попробуем определить эти метрики.

Рассмотрим сеть на основе Ethernet, как самой популярной технологии на данный момент. Не будем рассматривать метрики качества среды передачи данных, поскольку они мало интересуют конечного потребителя (разве что материал самой среды иногда бывает интересен: радио, медь или оптика). Самая первая метрика, которая приходит в голову — пропускная способность (bandwidth), т.е. сколько данных мы можем передать в единицу времени. Вторая, связанная с первой,- пакетная пропускная способность (PPS, Packets Per Second), отражающая сколько фреймов может быть передано в единицу времени. Поскольку сетевое оборудование оперирует фреймами, метрика позволяет оценить, справляется ли оборудование с нагрузкой и соответствует ли его производительность заявленной.

Третья метрика — это показатель потери фреймов (frame loss). Если невозможно восстановить фрейм, либо восстановленный фрейм не соответствует контрольной сумме, то принимающая, либо промежуточная система его отвергнет. Здесь имеется ввиду второй уровень системы OSI. Если рассматривать подробнее, то большинство протоколов не гарантируют доставку пакета получателю, их задача лишь переслать данные в нужном направлении, а те кто гарантирует (например, TCP) могут сильно терять в пропускной способности как раз из-за перепосылок фреймов (retransmit), но все они опираются на L2 фреймы, потерю которых учитывает эта метрика.

Четвертая — задержка (delay, latency),- т.е. через сколько пакет отправленный из точки A оказаться в точке B. Из этой характеристики можно выделить еще две: односторонняя задержка (one-trip) и круговая (round-trip). Фишка в том, что путь от A к B может быть один, а от B к A уже совсем другим. Просто поделить время не получится. А еще задержка время от времени может меняться, или “дрожать”,- такая метрика называется джиттером (jitter). Джиттер показывает вариацию задержки относительно соседних фреймов, т.е. девиацию задержки первого пакета относительно второго, или пятого относительно четвертого, с последующим усреднением в заданный период. Однако если требуется анализ общей картины или интересует изменение задержки в течении всего времени теста, а джиттер уже не отражает точно картину, то используется показатель вариации задержки (delay variation). Пятая метрика — минимальный MTU канала. Многие не придают важности этому параметру, что может оказаться критичным при эксплуатации “тяжелых” приложений, где целесообразно использовать jumbo-фреймы. Шестой, и малоочевидный для многих параметр — берстность — нормированная максимальная битовая скорость. По этой метрике можно судить о качестве оборудования, составляющего сеть или систему передачи данных, позволяет судить о размере буфера оборудования и вычислять условия надежности.

Об измерениях

Поскольку с метриками определились, стоит выбрать метод измерения и инструмент.

Задержка

Известный инструмент, поставляемый в большинстве операционных систем — утилита ping (ICMP Echo-Request). Многие ее используют по нескольку раз на дню для проверки доступности узлов, адресов, и т.п. Предназначена как раз для измерения RTT (Round Trip Time). Отправитель формирует запрос и посылает получателю, получатель формирует ответ и посылает отправителю, отправитель замеряя время между запросом и ответом вычисляет время задержки. Все понятно и просто, изобретать ничего не нужно. Есть некоторые вопросы точности и они рассмотрены в следующем разделе.

Но что, если нам надо измерить задержку только в одном направлении? Здесь все сложнее. Дело в том, что помимо просто оценки задержки пригодится синхронизировать время на узле отправителе и узле-получателе. Для этого придуман протокол PTP (Precision Time Protocol, IEEE 1588). Чем он лучше NTP описывать не буду, т.к. все уже расписано здесь, скажу лишь то, что он позволяет синхронизировать время с точностью до наносекунд. В итоге все сводится к ping-like тестированию: отправитель формирует пакет с временной меткой, пакет идет по сети, доходит до получателя, получатель вычисляет разницу между временем в пакете и своим собственным, если время синхронизировано, то вычисляется корректная задержка, если же нет, то измерение ошибочно.

Если накапливать информацию об измерениях, то на основании исторических данных о задержке можно без труда построить график и вычислить джиттер и вариацию задержки — показатель важный в сетях VoIP и IPTV. Важность его связана, прежде всего, с работой энкодера и декодера. При “плавающей” задержке и адаптивном буфере кодека повышается вероятность не успеть восстановить информацию, появляется “звон” в голосе (VoIP) или “перемешивание” кадра (IPTV).

Потери фреймов

Проводя измерения задержки, если ответный пакет не был получен, то предполагается, что пакет был потерян. Так поступает ping. Вроде тоже все просто, но это только на первый взгляд. Как написано выше, в случае с ping отправитель формирует один пакет и отправляет его, а получатель формирует свой собственный о отправляет его в ответ. Т.е. имеем два пакета. В случае потери какой из них потерялся? Это может быть не важно (хотя тоже сомнительно), если у нас прямой маршрут пакетов соответствует обратному, а если это не так? Если это не так, то очень важно понять в каком плече сети проблема. Например, если пакет дошел до получателя, то прямой путь нормально функционирует, если же нет, то стоит начать с диагностики этого участка, а вот если пакет дошел, но не вернулся, то точно не стоит тратить время на траблшутинг исправного прямого сегмента. Помочь в идентификации могла бы порядковая метка, встраиваемая в тестовый пакет. Если на обоих концах стоят однотипные измерители, то каждый из них в любой момент времени знает количество отправленных и полученных им пакетов. Какие именно из пакетов не дошли до получателя можно получить сравнением списка отправленных и полученных пакетов.

Минимальный MTU

Измерение этой характеристики не то чтобы сложно, скорее оно скучно и рутинно. Для определения минимального размера MTU (Maximum transmission unit) следует лишь запускать тест (тот же ping) с различными значениями размеров кадра и установленным битом DF (Don’t Fragmentate), что приведет к непрохождению пакетов с размером кадра больше допустимого, ввиду запрета фрагментации.

Например, так не проходит:

А так уже проходит:

Не часто используемая метрика с коммерческой точки зрения, но актуальная в некоторых случаях. Опять же, стоит отметить, что при асимметричном пути следования пакетов, возможен различный MTU в разных направлениях.

Пропускная способность

Наверняка многим известен факт, что количество переданной полезной информации в единицу времени зависит от размера фрейма. Связано это с тем, что фрейм содержит довольно много служебной информации — заголовков, размер которых не меняется при изменении размера фрейма, а изменяется поле “полезной” части (payload). Это значит, что несмотря на то, что даже если мы передаем данные на скорости линка, количество полезной информации переданной за тот же период времени может сильно варьироваться. Поэтому несмотря на то, что существуют утилиты для измерения пропускной способности канала (например iperf), часто невозможно получить достоверные данные о пропускной способности сети. Все дело в том, что iperf анализирует данные о трафике на основе подсчета той самой «полезной» части, окруженной заголовками протокола (как правило UDP, но возможен и TCP), следовательно нагрузка на сеть (L1,L2) не соответствует подсчитанной (L4). При использовании аппаратных измерителей скорость генерации трафика устанавливается в величинах L1, т.к. иначе было бы не очевидно для пользователя почему при измерении размера кадра меняется и нагрузка, это не так заметно, при задании ее в %% от пропускной способности, но очень бросается в глаза при указании в единицах скорости (Mbps, Gbps). В результатах теста, как правило, указывается скорость для каждого уровня (L1,L2,L3,L4). Например, так (можно переключать L2, L3 в выводе):

Пропускная способность в кадрах в секнду

Если говорить о сети или системе связи как о комплексе линий связи и активного оборудования, обеспечивающего нормальное функционирование, то эффективность работы такой системы зависит от каждого составляющего ее звена. Линии связи должны обеспечивать работу на заявленных скоростях (линейная скорость), а активное оборудование должно успевать обрабатывать всю поступающую информацию.

У всех производителей оборудования заявляется параметр PPS (packets per second), прямо указывающий сколько пакетов способно «переварить» оборудование. Ранее этот параметр был очень важен, поскольку подавляющее число техники просто не могло обработать огромное количество “мелких” пакетов, сейчас же все больше производители заявляют о wirespeed. Например, если передаются малые пакеты, то времени на обработку тратится, как правило, столько же, сколько и на большие. Поскольку содержимое пакета оборудованию не интересно, но важна информация из заголовков — от кого пришло и кому передать.

Сейчас все большее распространение в коммутирующем оборудовании получают ASIC (application-specific integrated circuit) — специально спроектированные для конкретных целей микросхемы, обладающие очень высокой производительностью, в то время как раньше довольно часто использовались FPGA (field-programmable gate array) — подробнее об их применении можно прочитать у моих коллег здесь и послушать здесь.

Бёрстность

Стоит отметить, что ряд производителей экономит на компонентах и использует малые буферы для пакетов. Например заявлена работа на скорости линка (wirespeed), а по факту происходят потери пакетов, связанные с тем, что буфер порта не может вместить в себя больше данных. Т.е. процессор еще не обработал скопившуюся очередь пакетов, а новые продолжают идти. Часто такое поведение может наблюдаться на различных фильтрах или конвертерах интерфейсов. Например предполагается, что фильтр принимает 1Gbps поток и направляет результаты обработки в 100Mbps интерфейс, если известно, что отфильтрованный трафик заведомо меньше 100Mbps. Но в реальной жизни случается так, что в какой-то момент времени может возникнуть «всплеск» трафика более 100Mbps и в этой ситуации пакеты выстраиваются в очередь. Если величина буфера достаточна, то все они уйдут в сеть без потерь, если же нет, то просто потеряются. Чем больше буфер, тем дольше может быть выдержана избыточная нагрузка.

Погрешности измерения

Четвертушка Ethernet-а: старая скорость, новые возможности

5 февраля этого года был утверждён новый стандарт на 10-мегабитный Ethernet. Да, вы верно прочитали: десять мегабит в секунду.

Для чего в 21-м веке нужна такая «маленькая» скорость? Для замены того зоопарка, который скрывается под ёмким названием «полевая шина» — Profibus, Modbus, CC-Link, CAN, FlexRay, HART и т.д. Их слишком много, они несовместимы между собой и относительно сложны в настройке. А хочется просто воткнуть кабель в коммутатор, и всё. Как с обычным Ethernet.

И вскоре это станет возможным! Знакомьтесь: «802.3cg-2019 — IEEE Standard for Ethernet — Amendment 5:Physical Layer Specifications and Management Parameters for 10 Mb/s Operation and Associated Power Delivery over a Single Balanced Pair of Conductors».

Чем же интересен этот новый Ethernet? Прежде всего – он работает по одной витой паре, а не по четырём. Поэтому у него меньше разъёмы и тоньше кабели. И можно использовать уже проложенную витую пару, идущую к датчикам и исполнительным механизмам.

Вы можете возразить, что Ethernet работает до 100 метров, а датчики расположены гораздо дальше. Действительно, раньше это было проблемой. Но 802.3cg работает на расстоянии до 1 км! По одной паре! Неплохо?

На самом деле, ещё лучше: по этой же паре может подаваться и электропитание. Вот с него и начнём.

IEEE 802.3bu Power over Data Lines (PoDL)

Думаю, многие из вас слышали о PoE (Power over Ethernet) и знают, что для передачи питания нужны 2 пары проводов. Ввод/вывод питания сделан в средних точках трансформаторов каждой пары. Используя одну пару такое сделать невозможно. Поэтому пришлось делать по-другому. Как именно – показано на рисунке внизу. Для примера добавлен и классический PoE.

Здесь:

PSE – power sourcing equipment (источник питания)

PD – powered device (устройство на дальнем конце, потребляющее электричество)

Изначально 802.3bu имел 10 классов электропитания:

Цветом выделены три условных градации напряжения источника: 12, 24 и 48В.

Обозначения:

Vpse — напряжение источника питания, В

Vpd min — минимальное напряжение на PD, В

I max — максимальный ток в линии, А

Ppd max — максимальная потребляемая мощность PD, Вт

С появлением протокола 802.3cg добавилось ещё 6 классов:

Разумеется, при таком многообразии PSE и PD должны согласовывать класс электропитания перед подачей полного напряжения. Делается это с помощью SCCP ( Serial Communications Classification Protocol). Это низкоскоростной протокол (333 бит/с), основанный на 1-Wire. Он работает только тогда, когда в линию не подано основное питание (в т.ч. в спящем режиме).

На блок-схеме показано, как выполняется подача питания:

Согласование класса питания можно не делать, если он заранее известен. Такой вариант называется Fast Startup Mode. Применяется, например, в автомобилях, т.к. там нет необходимости менять конфигурацию подключенного оборудования.

Инициировать переход в спящий режим может как PSE, так и PD.

Теперь перейдём к описанию передачи данных. Там тоже интересно: в стандарте определены два режима работы – дальнобойный и для небольших расстояний.

10BASE-T1L

Это вариант для большой дальности (long reach). Основные характеристики следующие:

Стоит упомянуть, что 10BASE-T1 только один из стандартов Single Pair Ethernet (SPE). Есть ещё 100BASE-T1 (802.3bw) и 1000BASE-T1 (802.3bp). Правда, они разрабатывались для автомобильных применений, поэтому там дальность только 15 (UTP) или 40 метров (STP). Однако, в планах уже есть и дальнобойный 100BASE-T1L. Так что в будущем добавят автосогласование скорости.

А пока согласование не используется – заявлен «быстрый старт» интерфейса: меньше 100мс от подачи питания до начала обмена данными.

Ещё одна опция (необязательная) – увеличение амплитуды передачи с 1 до 2.4В для улучшения отношения сигнал/шум, уменьшения количества ошибок, противодействия индустриальным помехам.

Ну и, разумеется, EEE. Это способ экономить электричество за счёт отключения передатчика, если в данный момент нет данных для передачи. На диаграмме показано, как это выглядит:

Нет данных – отсылаем сообщение “я ушла спать” и отключаемся. Изредка просыпаемся и отсылаем сообщение “я ещё здесь”. Когда появляются данные, противоположной стороне выдаётся предупреждение “я просыпаюсь” и начинается передача. То есть, постоянно работают только приёмники.

Теперь посмотрим, что придумали со вторым вариантом стандарта.

10BASE-T1S

Уже по последней букве понятно, что это протокол для коротких расстояний (short reach). Но зачем он нужен, если на коротких расстояниях и T1L работает? Читаем характеристики:

Но у режима мультипоинт есть недостатки. Основной из них – разделяемая среда передачи данных. Конечно, коллизии разрешаются с помощью CSMA/CD. Но неизвестно, какая при этом будет задержка. А для некоторых применений это критично. Поэтому в новом стандарте дополнили мультипоинт специальным режимом PLCA RS (см. следующий раздел).

Второй недостаток – в мультипоинте не работает PoDL. То есть питание придётся подавать по отдельному кабелю или брать где-то на месте.

Впрочем, в режиме точка-точка PoDL работает и на T1S.

PLCA RS

Работает этот режим следующим образом:

Результат использования PLCA – внизу на графиках. Первый – задержка в зависимости от загрузки, второй – пропускная способность в зависимости от количества передающих узлов. Хорошо заметно, что задержка стала гораздо более предсказуемой. И она в худшем случае на 2 порядка меньше, чем в худшем случае CSMA/CD:

И пропускная способность канала в случае PLCA выше, т.к. не расходуется на разрешение коллизий:

Разъёмы

Изначально выбирали из 6-ти вариантов разъёмов, предложенных разными фирмами. В результате остановились на этих двух вариантах:

Для обычных условий эксплуатации был выбран LC разъём IEC 63171-1 компании CommScope.

Для суровых условий эксплуатации – семейство разъёмов IEC 63171-6 (бывший 61076-3-125) компании HARTING. Эти разъёмы рассчитаны на степени защиты от IP20 до IP67.

Разумеется, разъёмы и кабели могут быть как UTP, так и STP.

Прочее

Можно применять обычный четырёхпарный кабель Ethernet, используя каждую пару для отдельного канала SPE. Чтобы не тянуть куда-то вдаль четыре отдельных кабеля. Или использовать однопарный кабель, а на дальнем конце поставить коммутатор однопарного Ethernet.

А можно подключить этот коммутатор прямо в локальную сеть предприятия, если в дальние дали уже протянута сеть по оптоволокну. Воткнуть там в него датчики, а показания с них смотреть здесь. Прямо по сети. Без конвертеров интерфейсов и шлюзов.

И ведь это не обязательно должны быть датчики. Могут быть видеокамеры, домофоны или «умные» лампочки. Приводы каких-нибудь клапанов или турникеты на проходных.

Так что перспективы открываются интересные. Вряд ли, конечно, SPE заменит все полевые шины. Но изрядный кусок он у них откусит. Уж в автомобилях-то точно.

PS Я не нашёл текст стандарта в открытом доступе. Приведенная выше информация собиралась по кусочкам из разных презентаций и доступных в интернете материалов. Так что в ней могут быть неточности.