Что такое отравление данных и есть ли антидот

Спирос Потамитис

Отравление данных (data poisoning) может стать угрозой для инфраструктуры, если машинное обучение (МО) должным образом не контролируется. Спирос Потамитис, старший специалист по аналитическим данным направления глобальной технологической практики SAS, обсуждает на портале Information Age, к каким последствиям оно может привести и как их избежать.

Все больше организаций обращаются к моделям МО для развития своих технологий искусственного интеллекта (ИИ). Однако угрозу для надежности этих систем может представлять другая тенденция: отравление данных. Ключ к успешному противодействию заключается не только в том, чтобы просто устранить проблему после ее возникновения. Чтобы защитить от нее ценные данные, компании должны полностью осознать серьезность угрозы, понять, почему происходит отравление данных и как защититься от него на протяжении всего процесса создания ИИ-систем.

Возвращение к основам МО

Прежде чем разобраться с тем, что такое отравление данных, стоит вернуться к рассмотрению того, как работают модели МО. Их обучают делать прогнозы, «скармливая» им исторические данные. Само применение этих данных предполагает заведомо ожидаемый результат и характеристики, которые определяют его получение. Эти данные «учат» модель обучаться на прошлом. Затем она может использовать полученные знания для прогнозирования будущего. Как правило, если для обучения модели доступно больше данных, то ее прогнозы будут более точными и стабильными.

Системы ИИ, включающие модели МО, обычно разрабатываются опытными специалистами по аналитической обработке данных. Они тщательно изучают и исследуют их, удаляют отклонения и проводят несколько проверок на целостность и валидность до, во время и после процесса разработки модели. Это означает, что, насколько это возможно, данные, используемые для обучения, действительно соответствуют целям, которых хотят достичь разработчики.

Отравители данных атакуют автоматизацию

Однако что происходит, если процесс обучения автоматизирован? Во время разработки это случается не так часто, но есть много случаев, когда нужно, чтобы модели постоянно обучались на новых оперативных данных: обучение «на рабочем месте». На этом этапе для кого-то не составит труда создать «ложные» данные, которые будут напрямую поступать в системы ИИ и заставлять их выдавать ошибочные прогнозы.

Другая проблема заключается в том, что отравление данных может быть долгим и медленным процессом. Хакеры могут не торопиться с изменением данных, вводя по несколько за раз. Более того, зачастую это более эффективно, поскольку порционное изменение труднее обнаружить, чем разовый массированный приток данных, и его значительно труднее отменить.

Как предотвратить отравление данных: четыре этапа

Чтобы предотвратить отравление, организации могут предпринять следующее:

Настоящее противоядие? Человеческий контроль

Злоумышленники, желающие нарушить целостность результатов МО, уже действуют, и их методы компрометации данных чрезвычайно изощренны. Компании должны уделять пристальное внимание этим четырем пунктам, если они дорожат целостностью своих моделей МО. Однако одним из наиболее эффективных способов предотвращения таких атак является обеспечение контроля над всем процессом МО со стороны человека. Чтобы предотвратить необъективный результат, интеллектуальные машины и люди должны работать вместе. В конечном итоге это приведет к пресечению ультрасовременных попыток манипулирования данными.

Игры искусственного разума: безопасность систем машинного обучения

Зародившееся в середине XX в. направление искусственного интеллекта объединяет широкий спектр научных областей, таких как представление знаний, обработка естествен ных языков, машинное обучение и др.

Наибольшее внимание со стороны разработчиков в настоящее время привлекают именно системы машинного обучения. В отличие от классических алгоритмических методов машинное обучение основывается не на решении конкретной задачи, а на обучении при решении сходных задач и уже последующем решении требуемой задачи. Спектр используемых методов при этом чрезвычайно широк: методы оптимизации, математической статистики и теории вероятностей, теории графов, искусственных нейронных сетей.

Сейчас на первый план выходят именно нейронные сети. Несмотря на то что, как и искусственный интеллект в целом, нейронные сети развиваются с середины прошлого века, только в последние годы они стали действительно активно использоваться. Это связано, с одной стороны, с наличием доступных для обработки и обучения нейронных сетей больших объемов данных, а с другой – с появлением достаточных вычислительных мощностей, которые позволяют такие объемы дан ных обрабатывать, прежде всего с использованием графических ускорителей и нейроморфных процессоров типа IBM TrueNorth.

Как и при использовании любой другой технологии, относящейся к сфере обработки информации, перед специалистом в области информационной безопасности встает вопрос о возможных угрозах и мерах по противодействию таким угрозам при использовании систем искусственного интеллекта.

В информационной безопасности использование искусственного интеллекта обычно принято рассматривать в контексте противодействия существующим кибератакам, таким, например, как фишинг, DDoS- атаки и др., или как средство, которое может обеспечить качественно новый уровень реализации таких атак при использовании злоумышленниками.

Безопасность системы ИИ и как ее обеспечить

Отмеченный выше принцип предварительного обучения при обработке данных методами искусственного интеллекта приводит к тому, что конечное решение зависит не только от алгоритма принятия решения, но и от обработанных ранее и обрабатываемых в данный момент данных. В результате возникают два совершенно новых типа атак на системы рассматриваемого типа в дополнение к классическим, характерным для любой информационной системы:

Отравление ARP: что это такое и как предотвратить ARP-спуфинг

«Отравление» ARP (ARP Poisoning) — это тип кибератаки, которая использует слабые места широко распространенного протокола разрешения адресов (Address Resolution Protocol, ARP) для нарушения или перенаправления сетевого трафика или слежения за ним. В этой статье мы вкратце рассмотрим, зачем нужен ARP, проанализируем его слабые места, которые делают возможным отравление ARP, а также меры, которые можно принять для обеспечения безопасности организации.

Что такое ARP?

ARP предназначен для определения MAC-адреса по IP-адресу другого компьютера. ARP позволяет подключенным к сети устройствам запрашивать, какому устройству в настоящее время назначен конкретный IP-адрес. Устройства также могут сообщать об этом назначении остальной части сети без запроса. В целях эффективности устройства обычно кэшируют эти ответы и создают список текущих назначений MAC-IP.

Что такое отравление ARP?

«Отравление» (подмена) ARP заключается в использовании слабых сторон ARP для нарушения назначений MAC-IP для других устройств в сети. В 1982 году, когда был представлен протокол ARP, обеспечение безопасности не было первостепенной задачей, поэтому разработчики протокола никогда не использовали механизмы аутентификации для проверки сообщений ARP. Любое устройство в сети может ответить на запрос ARP, независимо от того, является ли оно адресатом данного запроса. Например, если компьютер A запрашивает MAC-адрес компьютера B, ответить может злоумышленник на компьютере C, и компьютер A примет этот ответ как достоверный. За счет этой уязвимости было проведено огромное количество атак. Используя легкодоступные инструменты, злоумышленник может «отравить» кэш ARP других хостов в локальной сети, заполнив его неверными данными.

Этапы отравления ARP

Этапы отравления ARP могут различаться, но обычно их минимальный перечень таков:

Типы атак ARP Poisoning

Имеется два основных способа отравления ARP: злоумышленник может либо дождаться запроса ARP в отношении конкретной цели и дать на него ответ, либо использовать самообращённые запросы (gratuitous ARP). Первый вариант ответа будет менее заметен в сети, но его потенциальное влияние также будет меньшим. Cамообращенные запросы ARP могут быть более эффективными и затронуть большее количество жертв, но они имеют обратную сторону — генерирование большого объема сетевого трафика. При любом подходе поврежденный кэш ARP на устройствах-жертвах может быть использован для дальнейших целей:

Атаки Man-in-the-Middle

Атаки MiTM, вероятно, являются наиболее распространенной и потенциально наиболее опасной целью отравления ARP. Злоумышленник отправляет ложные ответы ARP по заданному IP-адресу (обычно это шлюз по умолчанию для конкретной подсети). Это заставляет устройства-жертвы заполнять свой кэш ARP MAC-адресом машины злоумышленника вместо MAC-адреса локального маршрутизатора. Затем устройства-жертвы некорректно пересылают сетевой трафик злоумышленнику. Такие инструменты, как Ettercap, позволяют злоумышленнику выступать в роли прокси-сервера, просматривая или изменяя информацию перед отправкой трафика по назначению. Жертва при этом может не заметить каких-либо изменений в работе.

Одновременное отравление ARP и отравление DNSможет значительно повысить эффективность атаки MiTM. В этом сценарии пользователь-жертва может ввести адрес легитимного сайта (например, google.com) и получить IP-адрес машины злоумышленника вместо корректного адреса.

Отказ в обслуживании (Denial of Service, DoS)

DoS-атака заключается в том, что одной или нескольким жертвам отказывается в доступе к сетевым ресурсам. В случае ARP, злоумышленник может отправить ответ ARP, который ложно назначает сотни или даже тысячи IP-адресов одному MAC-адресу, что потенциально может привести к перегрузке целевого устройства. Атака этого типа, иногда называемая «лавинной рассылкой ARP» (ARP-флудингом), также может быть нацелена на коммутаторы, что потенциально может повлиять на производительность всей сети.

Перехват сеанса

Перехват сеанса по своей природе похож на MiTM за исключением того, что злоумышленник не будет напрямую перенаправлять трафик с машины жертвы на целевое устройство. Вместо этого он захватывает подлинный порядковый номер TCP или файл cookie жертвы и использует его, чтобы выдавать себя за жертву. Так он может, к примеру, получить доступ к учетной записи данного пользователя в соцсети, если тот в нее вошел.

Какова цель отравления ARP?

У хакеров всегда самые разные мотивы, в том числе при осуществлении отравления ARP, начиная от шпионажа высокого уровня и заканчивая азартом создания хаоса в сети. В одном из возможных сценариев злоумышленник может использовать ложные сообщения ARP, чтобы взять на себя роль шлюза по умолчанию для данной подсети, эффективно направляя весь трафик на свое устройство вместо локального маршрутизатора. Затем он может следить за трафиком, изменять или сбрасывать его. Такие атаки являются «громкими», поскольку оставляют за собой улики, но при этом не обязательно влияют на работу сети. Если целью атаки является шпионаж, машина злоумышленника просто перенаправляет трафик изначальному адресату, не давая ему оснований подозревать, что что-то изменилось.

Другой целью может быть значительное нарушение работы сети. Например, довольно часто DoS-атаки выполняются не очень опытными хакерами просто для получения удовольствия от созданных проблем.

Опасным типом отравления ARP являются инсайдерские атаки. Поддельные сообщения ARP не выходят за пределы локальной сети, поэтому атака должна исходить от локального устройства. Внешнее устройство также потенциально может инициировать ARP-атаку, но сначала ему нужно удаленно скомпрометировать локальную систему другими способами, в то время как инсайдеру требуется только подключение к сети и некоторые легкодоступные инструменты.

ARP-спуфинг vs отравление ARP

Термины «ARP-спуфинг» и «отравление ARP» обычно используются как синонимы. Технически под спуфингом понимается выдача злоумышленником своего адреса за MAC-адрес другого компьютера, в то время как отравлением (подменой) называют повреждение ARP-таблиц на одной или нескольких машинах-жертвах. Однако на практике это элементы одной и той же атаки. Также эту атаку иногда называют «отравлением кэша ARP» или «повреждением ARP-таблицы».

Последствия атак ARP Poisoning

Основной эффект отравления ARP заключается в том, что трафик, предназначенный для одного или нескольких хостов в локальной сети, вместо этого направляется на устройство, выбранное злоумышленником. Конкретные последствия атаки зависят от ее специфики. Трафик может направляться на машину злоумышленника или в несуществующее место. В первом случае заметного эффекта может не быть, в то время как во втором может быть заблокирован доступ к сети.

Само по себе отравление кэша ARP не оказывает длительного воздействия. Записи ARP кэшируются от нескольких минут на конечных устройствах до нескольких часов на коммутаторах. Как только злоумышленник перестает активно заражать таблицы, поврежденные записи просто устаревают, и вскоре возобновляется нормальный поток трафика. Само по себе отравление ARP не оставляет постоянной инфекции или «точек опоры» на машинах-жертвах. Однако нередко хакеры совершают ряд атак по цепочке, и отравление ARP может быть элементом более масштабной атаки.

Как обнаружить отравление кэша ARP

Существует множество платных программ и программ с открытым исходным кодом для обнаружения отравления кэша ARP, однако проверить ARP-таблицы на своем компьютере можно даже без установки специального ПО. В большинстве систем Windows, Mac и Linux ввод команды arp-a в терминале или командной строке отобразит текущие назначения IP-адресов и MAC-адресов машины.

Такие инструменты, как arpwatch и X-ARP, позволяют осуществлять непрерывный мониторинг сети и могут предупредить администратора о выявлении признаков отравления кэша ARP. Однако достаточно высока вероятность ложных срабатываний.

Как предотвратить отравление ARP

Cуществует несколько методов предотвращения отравления ARP:

Статические ARP-таблицы

Можно статически назначить все MAC-адреса в сети соответствующим IP-адресам. Это очень эффективно для предотвращения отравления ARP, но требует огромных трудозатрат. Любое изменение в сети потребует ручного обновления ARP-таблиц на всех хостах, в связи с чем для большинства крупных организаций использование статических ARP-таблиц является нецелесообразным. Но в ситуациях, когда безопасность имеет первостепенное значение, выделение отдельного сегмента сети для статических ARP-таблиц может помочь защитить критически важную информацию.

Защита коммутатора

Большинство управляемых коммутаторов Ethernet оснащены функциями предотвращения атак ARP Poisoning. Эти функции, известные как динамическая проверка ARP (Dynamic ARP Inspection, DAI), оценивают достоверность каждого сообщения ARP и отбрасывают пакеты, которые выглядят подозрительными или вредоносными. С помощью DAI также можно ограничить скорость прохождения сообщений ARP через коммутатор, эффективно предотвращая DoS-атаки.

DAI и аналогичные функции когда-то были доступны исключительно для высокопроизводительного сетевого оборудования, но теперь они представлены практически на всех коммутаторах бизнес-класса, в том числе используемых в небольших компаниях. Обычно рекомендуется включать DAI на всех портах, кроме подключенных к другим коммутаторам. Эта функция не оказывает значительного влияния на производительность; при этом, вместе с ней может понадобиться включение других функций, например DHCP Snooping.

Включение защиты порта на коммутаторе также может помочь минимизировать последствия отравления кэша ARP. Защиту порта можно настроить таким образом, чтобы разрешить использование только одного MAC-адреса на порте коммутатора, что лишает злоумышленника возможности применять несколько сетевых идентификаторов.

Физическая защита

Предотвратить атаки ARP Poisoning также поможет надлежащий контроль физического доступа к рабочему месту пользователей. Сообщения ARP не выходят за пределы локальной сети, поэтому потенциальные злоумышленники должны находиться в физической близости к сети жертвы или уже иметь контроль над машиной в сети. Обратите внимание, что в случае беспроводной сети территориальная близость не обязательно означает прямой физический доступ: может быть достаточно сигнала, который достигает двора или парковки. Независимо от типа соединения (проводное или беспроводное), использование технологии наподобие 802.1x может гарантировать подключение к сети только доверенных и/или управляемых устройств.

Сетевая изоляция

Хорошо сегментированная сеть может быть менее восприимчива к отравлению кэша ARP в целом, поскольку атака в одной подсети не влияет на устройства в другой. Концентрация важных ресурсов в выделенном сегменте сети с более строгими мерами безопасности может значительно снизить потенциальное влияние атаки ARP Poisoning.

Шифрование

Хотя шифрование не предотвращает ARP-атаку, оно может снизить потенциальный ущерб. Раньше популярной целью атак MiTM было получение учетных данных для входа в систему, которые когда-то передавались в виде обычного текста. Благодаря распространению шифрования SSL/TLS совершать такие атаки стало сложнее.

Насколько неуязвим искусственный интеллект?

Сегодня искусственные нейронные сети лежат в основе многих методов «искусственного интеллекта». При этом процесс обучения новых нейросетевых моделей настолько поставлен на поток (благодаря огромному количеству распределенных фреймворков, наборов данных и прочих «заготовок»), что исследователи по всему миру с легкостью строят новые «эффективные» «безопасные» алгоритмы, порой даже не вдаваясь в то, что в результате получилось. В отдельных случаях это может приводить к необратимым последствиям на следующем шаге, в процессе использования обученных алгоритмов. В сегодняшней статье мы разберем ряд атак на искусственный интеллект, как они устроены и к каким последствиям могут приводить.

Как вы знаете, мы в Smart Engines с трепетом относимся к каждому шагу процесса обучения нейросетевых моделей от подготовки данных (см. здесь, здесь и здесь) до разработки архитектуры сетей (см. здесь, здесь и здесь). На рынке решений с использованием искусственного интеллекта и систем распознавания мы являемся проводниками и пропагандистами идей ответственной разработки технологий. Месяц назад даже мы присоединились к глобальному договору ООН.

Так почему же так страшно «спустя рукава» учить нейронные сетки? Разве плохая сетка (которая будет просто плохо распознавать) реально может серьезно навредить? Оказывается, дело тут не столько в качестве распознавания полученного алгоритма, сколько в качестве полученной системы в целом.

В качестве простого понятного примера, давайте представим, чем может быть плоха операционная система. Действительно, совсем не старомодным пользовательским интерфейсом, а тем, что она не обеспечивает должного уровня безопасности, совершенно не держит внешних атак со стороны хакеров.

Подобные размышления справедливы и для систем искусственного интеллекта. Сегодня давайте поговорим об атаках на нейронные сети, приводящих к серьезным неисправностям целевой системы.

Отравление данных (Data Poisoning)

Как видите, отравление данных – крайне опасный вид атак, использование которого, в прочем, всерьез ограничено одной важной особенностью: необходим непосредственный доступ к данным. Если исключить случаи корпоративного шпионажа и порчи данных сотрудниками, остается следующие сценарии, когда это может произойти:

Атаки уклонения (Evasion Attack)

Следующий тип атак, который мы рассмотрим – это атаки на уклонение. Такие атаки возникают на этапе применения нейронных сетей. При этом цель остается прежней: заставить сеть выдавать неверные ответы в определенных ситуациях.

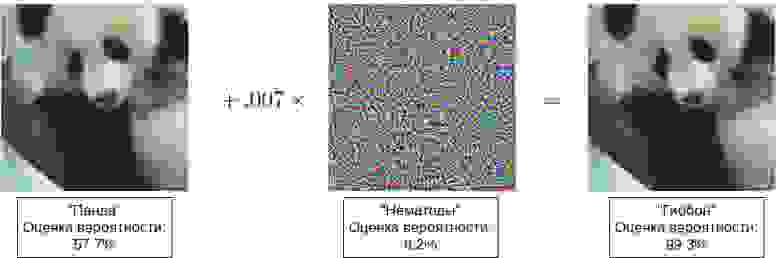

Изначально, под ошибкой уклонения подразумевались ошибки II рода, но сейчас так называют любые обманы работающей сети [8]. Фактически, злоумышленник пытается создать у сети оптическую (слуховую, смысловую) иллюзию. Нужно понимать, что восприятие изображения (звука, смысла) сетью существенном образом отличается от его восприятия человеком, поэтому часто можно увидеть примеры, когда два очень похожих изображения – неразличимых для человека, распознаются по-разному. Первые такие примеры были показаны в работе [4], а в работе [5] появился популярный пример с пандой (см. титульную иллюстрацию к данной статье).

Как правило, для атак уклонения используются «состязательные примеры» (adversarial examples). У этих примеров есть пара свойств, которые ставят под угрозу многие системы:

Теперь о немного других атаках на сети

За время нашего рассказа мы несколько раз упоминали обучающую выборку, показывали, что иногда именно она, а не обученная модель, является целью злоумышленников.

Большинство исследований показывают, что распознающие модели лучше всего учить на настоящих репрезентативных данных, а значит часто модели таят в себе много ценной информации. Вряд ли кому-то интересно красть фотографии котов. Но ведь алгоритмы распознавания используются в том числе в медицинских целях, системах обработки персональной и биометрической информации и т. п., где «обучающие» примеры (в виде живой персональной или биометрической информации) представляют собой огромную ценность.

Итак, рассмотрим два вида атак: атаку на установление принадлежности и атаку путем инверсии модели.

Атака установления принадлежности

При данной атаке злоумышленник пытается определить, использовались ли конкретные данные для обучения модели. Хотя с первого взгляда кажется, что ничего страшного в этом нет, как мы говорили выше, можно выделить несколько нарушений конфиденциальности.

Во-первых, зная, что часть данных о каком-то человеке использовалась при обучении, можно попробовать (и иногда даже успешно) вытащить другие данные о человеке из модели. Например, если у вас есть система распознавания лиц, хранящая в себе еще и персональные данные человека, можно по имени попробовать воспроизвести его фотографию.

Во-вторых, возможно непосредственное раскрытие врачебной тайны. Например, если у вас есть модель, следящая за передвижениями людей с болезнью Альцгеймера и вы знаете, что данные о конкретном человека использовались при обучении, вы уже знаете, что этот человек болен [9].

Атака путем инверсии модели

Под «инверсией модели» понимают возможность получения обучающих данных из обученной модели. При обработке естественного языка, а в последнее время и при распознавании изображений, часто используются сети, обрабатывающие последовательности. Наверняка все сталкивались с автодополнение в Google или Яндекс при вводе поискового запроса. Продолжение фраз в подобных системах выстраивается исходя из имеющейся обучающей выборки. В результате, если в обучающей выборке были какие-то персональные данные, то они могут внезапно появиться в автодополнении [10, 11].

Вместо заключения

С каждым днем системы искусственного интеллекта разного масштаба все плотнее «оседают» в нашей повседневной жизни. Под красивые обещания об автоматизации рутинных процессов, повышении общей безопасности и другого светлого будущего, мы отдаем системам искусственного интеллекта различные области человеческой жизнедеятельности одну за другой: ввод текстовой информации в 90-х, системы помощи водителю в 2000-х, обработка биометрии в 2010-х и т. д. Пока что во всех этих областях системам искусственного интеллекта предоставлена только роль ассистента, но благодаря некоторым особенностям человеческой природы (прежде всего, лени и безответственности), компьютерный разум часто выступает в качестве командира, приводя порой к необратимым последствиям.

У всех на слуху истории, как врезаются автопилоты, ошибаются системы искусственного интеллекта в банковской сфере, возникают проблемы обработки биометрии. Совсем недавно, из-за ошибки системы распознавания лиц россиянина едва не посадили на 8 лет в тюрьму.

Пока это все цветочки, представленные единичными случаями.

Ягодки ждут впереди. Нас. В ближайшем будущем.

Data Poisoning: When Attackers Turn AI and ML Against You

Stopping ransomware has become a priority for many organizations. So, they are turning to artificial intelligence (AI) and machine learning (ML) as their defenses of choice. However, threat actors are also turning to AI and ML to launch their attacks. One specific type of attack, data poisoning, takes advantage of this.

Why AI and ML Are at Risk

Like any other tech, AI is a two-sided coin. AI models excel at processing lots of data and coming up with a “best guess,” says Garret Grajek, CEO of YouAttest, in an email interview.

“Hackers have used AI to attack authentication and identity validation, including voice and visualization hacking attempts,” he says. “The ‘weaponized AI’ works to derive the key for access.”

“Adversarial data poisoning is an effective attack against machine learning and threatens model integrity by introducing poisoned data into the training dataset,” researchers from Cornell University explain.

What makes attacks through AI and ML different from typical ‘bug in the system’ attacks? There are inherent limits and weaknesses in the algorithms that can’t be fixed, says Marcus Comiter in a paper for Harvard University’s Belfer Center for Science and International Affairs.

“AI attacks fundamentally expand the set of entities that can be used to execute cyberattacks,” Comiter adds. “For the first time, physical objects can be now used for cyberattacks. Data can also be weaponized in new ways using these attacks, requiring changes in the way data is collected, stored, and used.”

Human Error

To better understand how threat actors use AI and ML as an attack vector for data poisoning and other attacks, we need to have a clearer picture of the role they play in protecting data and networks.

Ask a chief information security officer what the greatest threat to an organization’s data is, and more often than not they’ll tell you it’s human nature.

Employees don’t plan to be a cyber risk, but they are human. People are distractible. They miss a threat today they would have easily avoided yesterday. An employee rushing to make a deadline and expecting an important document may end up clicking on an infected attachment, mistaking it for the one they need. Or, employees simply may not be aware, as their security awareness training is too inconsistent to have made an impression. Threat actors know this, and like any good criminal, they are looking to find the easiest way into a network and to the data. Phishing attacks are so common because they work so well.

Using Outlier Behavior as a Risk Factor

This is where AI and ML malware detection comes to the rescue. These technologies find patterns and analyze user behavior, sniffing out strange behavior before it turns into a problem. By applying the generated algorithms, ML recognizes outlier behavior that a human can’t possibly. It can, for example, detect the normal work day of an employee or the rhythm of their keystrokes and set up alerts for something out of the ordinary.

It’s not perfect, of course. Someone could be working outside of their normal hours or have an injury that impacts the way they type. But these tools are designed to catch something out of the ordinary, such as a threat actor using stolen credentials.

At best, we can use AI to better protect networks from ransomware attacks by telling the difference between real and malicious files on unsupervised computers and networks, blocking access to the bad files. AI could sniff out shadow IT, telling authorized connections from threatening ones and giving insight into the number of endpoints the workforce uses.

For AI and ML to be successful in fighting cyber threats, they rely on data and the algorithms created over a specified period of time. That’s what allows them to find the problems efficiently (and frees up the security team for other tasks). And it is also the threat. The rise in AI and ML is leading directly to the sleeper threat of data poisoning.

Understanding Data Poisoning

There are two ways to poison data. One is to inject information into the system so it returns incorrect classifications.

At the surface level, it doesn’t look that difficult to poison the algorithm. After all, AI and ML only know what people teach them. Imagine you’re training an algorithm to identify a horse. You might show it hundreds of pictures of brown horses. At the same time, you teach it to recognize cows by feeding it hundreds of pictures of black-and-white cows. But when a brown cow slips into the data set, the machine will tag it as a horse. To the algorithm, a brown animal is a horse. A human would be able to recognize the difference, but the machine won’t unless the algorithm specifies that cows can also be brown.

If threat actors access the training data, they can then manipulate that information to teach AI and ML anything they want. They can make them see good software code as malicious code, and vice versa. Attackers can reconstruct human behavior data to launch social engineering attacks or to determine who to target with ransomware.

The second way threat actors could take advantage of the training data to generate a back door.

“Hackers may use AI to help choose which is the most likely vulnerability worth exploiting. Thus, malware can be placed in enterprises where the malware itself decides upon the time of attack and which the best attack vector could be. These attacks, which are, by design, variable, make it harder and longer to detect.” says Grajek.

How Attackers Use Data Poisoning

An important thing to note with data poisoning is that the threat actor needs to have access to the data training program. So you may be dealing with an insider attack, a business rival or a nation-state attack.

The Department of Defense, for example, is looking at how to best defend its networks and data from a data poisoning attack.

“Current research on adversarial AI focuses on approaches where imperceptible perturbations to ML inputs could deceive an ML classifier, altering its response,” Dr. Bruce Draper wrote about a DARPA research project, Guaranteeing AI Robustness Against Deception. “Although the field of adversarial AI is relatively young, dozens of attacks and defenses have already been proposed, and at present a comprehensive theoretical understanding of ML vulnerabilities is lacking.”

Attackers can also use data poisoning to make malware smarter. Threat actors use it to compromise email by cloning phrases to fool the algorithm. It has now even moved into biometrics, where attackers can lock out legitimate users and sneak in themselves.

Data Poisoning and Deepfakes

Deepfakes are a level of data poisoning that many expect to be the next big wave of digital crime. Attackers edit videos, pictures and voice recordings to make realistic-looking images. Because they can be mistaken for real photographs or videos by many eyes, they’re a ripe technique for blackmail or embarrassment. Wielded at corporate level, a variant of this can also lead to physical dangers, as Comiter pointed out.

“[A]n AI attack can transform a stop sign into a green light in the eyes of a self-driving car by simply placing a few pieces of tape on the stop sign itself,” he wrote.

Fake news also falls under data poisoning. Algorithms in social media are corrupted to allow for incorrect information to rise to the top of a person’s news feed, replacing authentic news sources.

Stopping Data Poisoning Attacks

Data poisoning is still in its infancy, so cyber defense experts are still learning how to best defend against this threat. Pentesting and offensive security testing may lead to finding vulnerabilities that give outsiders access to data training models. Some researchers are also considering a second layer of AI and ML designed to catch potential errors in data training. And of course, ironically, we need a human to test the AI algorithms and check that a cow is a cow and not a horse.

“AI is just one more weapon in the attacker’s arsenal,” says Grajek. “The hackers will still want to move across the enterprise, escalate their privileges to perform their task. Constant and real-time privilege escalation monitoring is crucial to help mitigate attacks, caused by AI or not.”